深度学习是机器学习的一个领域

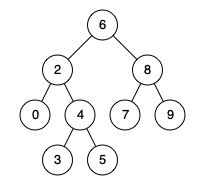

神经网络构造

一个神经元有n个输入,每一个输入对应一个权值w,神经元内会对输入与权重做乘法后求和。

感知器

由两层神经元组成的神经网络--“感知器”(Perceptron),感知器只能线性划分数据。

公式是线性代数方程组,因此可以用矩阵乘法来表达这两个公式

多层感知器(非线性建模)

多层感知器 --- 偏置(引入非线性)

在神经网络中需要默认增加偏置神经元(节点),这些节点是默认存在的。 它本质上是一个只含有存储功能,且存储值永远为1的单元。 在神经网络的每个层次中,除了输出层以外,都会含有这样一个偏置单元。

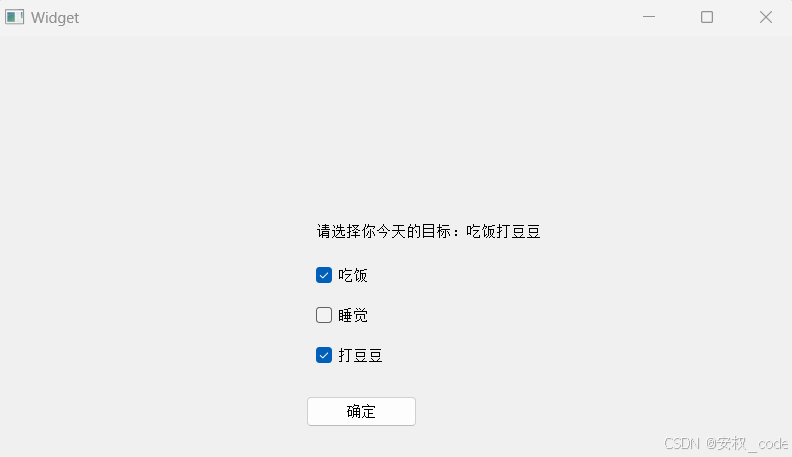

神经网络构造要点

需要记忆:

1、设计一个神经网络时,输入层与输出层的节点数往往是固定的,中间层则可以自由指定;

2、神经网络结构图中的拓扑与箭头代表着预测过程时数据的流向,跟训练时的数据流有一定的区别;

3、结构图里的关键不是圆圈(代表“神经元”),而是连接线(代表“神经元”之间的连接)。每个连接线对应一个不同的权重(其值称为权值),这是需要训练得到的。

中间层该如何确定呢?

输入层的节点数:与特征的维度匹配

输出层的节点数:与目标的维度匹配。

中间层的节点数:目前业界没有完善的理论来指导这个决策。一般是根据经验来设置。较好的方法就是预先设定几个可选值,通过切换这几个值来看整个模型的预测效果,选择效果最好的值作为最终选择。

损失函数

模型训练的目的:使得参数尽可能的与真实的模型逼近。

具体做法:

1、首先给所有参数赋上随机值。我们使用这些随机生成的参数值,来预测训练数据中的样本。 2、计算预测值为yi,真实值为y。那么,定义一个损失值loss,损失值用于判断预测的结果和真实值的误差,误差越小越好

常用的损失函数: 0-1损失函数 均方差损失 平均绝对差损失 交叉熵损失 合页损失

多分类的情况下,如何计算损失值

正则化惩罚

输入为[1,0,0,0]现有2种不同的权重值

w1 = [1,0,0,0]

w2 = [0.25,0.25,0.25,0.25]

w1和w2与输入的乘积都为1,但w2 与每一个输入数据进行计算后都有数据,使得w2会学习到每一个特征信息。而w1只和第1个输入信息有关系,容易出现过拟合现象,因此w2的效果会比w1 好

正则化惩罚的功能:主要用于惩罚权重参数w,一般有L1和L2正则化。

梯度下降

1. 偏导数

我们知道一个多变量函数的偏导数,就是它关于其中一个变量的导数而保持其他变量恒定。该函数的整个求导: 例如:计算像 f(b0,b1)=b0x1²* b1x2 这样的多变量函数的过程可以分解如下:

2. 梯度

梯度可以定义为一个函数的全部偏导数构成的向量,梯度向量的方向即为函数值增长最快的方向

3、梯度下降法

一个一阶最优化算法,通常也称为最陡下降法 ,要使用梯度下降法找到一个函数的局部极小值

步长(学习率):梯度可以确定移动的方向。学习率将决定我们采取步长的大小。不易过小和过大 如何解决全局最小的问题?产生多个随机数在不同的位置分别求最小值。

BP神经网络

BP(Back-propagation,反向传播)前向传播得到误差,反向传播调整误差,再前向传播,再反向传播一轮一轮得到最优解的。