由于对视频单目标跟踪并不是很熟悉,所以首先得对该领域有个大致的了解。

视频目标跟踪是计算机视觉领域重要的基础性研究问题之一,是指在视频序列第一帧指定目标 后,在后续帧持续跟踪目标,即利用边界框(通常用矩形框表示)标定目标,实现目标的定位与尺度估计(目标跟踪问题通常分为单目标跟踪和多目标跟踪,这里主要关注单目标跟踪问题)。视觉跟踪技术是计算机视觉领域(人工智能分支)的一个重要课题,有着重要的研究意义;且在军事制导、视频监控、机器人视觉导航、人机交互、以及医疗诊断等许多方面有着广泛的应用前景。

单目标跟踪任务,给定初始目标的位置和尺寸,要求跟踪器持续地对目标进行定位。不同于多目标跟踪,单目标跟踪要求可以处理任意的物体,而多目标跟踪通常是固定类别的物体,如行人、车辆等。单目标跟踪算法的这种“物体不定性”,一方面,待跟踪物体包罗万象,各种奇奇怪怪的物体为该任务带来诸多挑战;另一方面,不限制目标类别,又为跟踪任务的建模和训练带来无限可能。

视频目标跟踪中的挑战

对于视频目标跟踪问题,主要面临的挑战表现在视频目标前背景在跟踪过程中发生的复杂变化。这些变化包括:目标消失、目标形变、 背景干扰以及目标移动等情形。上述情况往往导致 视频序列中跟踪目标所依赖的特征,如外观、形状 或背景等信息,随时间变化存在较大的不一致性, 使得跟踪器在后续视频帧中无法准确识别和跟踪目标。

(1) 目标消失:目标消失是视频目标跟踪中最 具挑战性的问题之一,主要包括在某段时间内目标 (或部分目标)被其他物体遮挡或移出相机视野范 围,当目标重新出现时如何继续跟踪目标,如图a。影响此类问题的因素主要包括遮挡范围 和遮挡时间,若目标全部被遮挡或长时间被遮挡, 往往会造成跟踪器无法有效更新,从而跟踪失败。

(2) 目标变化:目标变化是视频目标跟踪中最 常见的问题之一,主要包括目标形变,目标旋转等 情形。通常来说,非刚性物体在跟踪过程中都会发 生不同程度的形变。左侧图b显示视频中目标(运动员)在执行动作过程中随时间发生了严重的形变,长宽比例变化明显。目标旋转通常包含两方面内容,一是平面内旋转,另一类是平面外旋转。前者是指目标旋转轴垂直于目标图像所在的平面,后者则表示旋转轴与图像平面不垂直的情 形,图 b 右图展示了目标平面外旋转的例子。

(3) 背景干扰:背景干扰也是目标跟踪问题经 常出现的问题,主要表现是背景杂乱和光照变化等 情形。图 c 分别展示了目标受杂乱背景干扰和 光照严重变化的情形。如何有效地进行前背景分离,从而精确地抓取前景抑制背景也是目标跟踪的根本问题。而光照变化不仅对背景造成干扰,也使 得目标前景本身的外观特征发生一定程度的变化。 强烈的光照变化通常造成不同帧序列之间目标外观差异增大,而同一帧之内目标前背景差异减小, 从而加大跟踪的难度。

(4) 目标移动:视频目标跟踪所研究的对象主体往往是运动的目标,目标移动对目标跟踪造成的 困难主要包括目标快速运动和目标运动模糊等情 形。由于目标跟踪通常采取在目标前一帧所处位置 周围区域进行搜索的策略,因此目标快速运动可能 造成目标与前序帧位置差异较大,甚至超出搜索区域。另一方面,目标移动本身造成的运动模糊也会 造成目标前景虚化,从而影响目标特征表达。同样 的,相机移动甚至会造成整幅图像的模糊,也是影响目标跟踪效果的挑战之一。

视频目标跟踪方法

近十年来最主流的两类方法是基于相关滤波 CF (Correlation Filter) 和孪生网络 (Siamese Network) 框架的方法。相关滤波目标跟踪算法自 2010 年提出之后,由于其在跟踪精度和算法速度 取得良好的平衡性,迅速发展成为目标跟踪的主流 方法之一。基于孪生网络的目标跟踪算法相比 相关滤波方法出现较晚,开创性工作是 2016 年出 现的 SiameseFC算法。

基于相关滤波的目标跟踪方法

相关滤波理论用于目标 跟踪问题表现良好主要得益于以下两方面原因:1) CF 目标跟踪方法隐式地利用了循环平移操作对训 练样本进行扩增,从而极大丰富了训练样本的多样 性,使得算法的鲁棒性和精度提升;2)快速傅利 叶变换 FFT (Fast Fourier Transform) 使得复杂的卷 积操作在频域内加速计算,计算量降低,模型求解 效率增加。

相关滤波目标跟踪框架

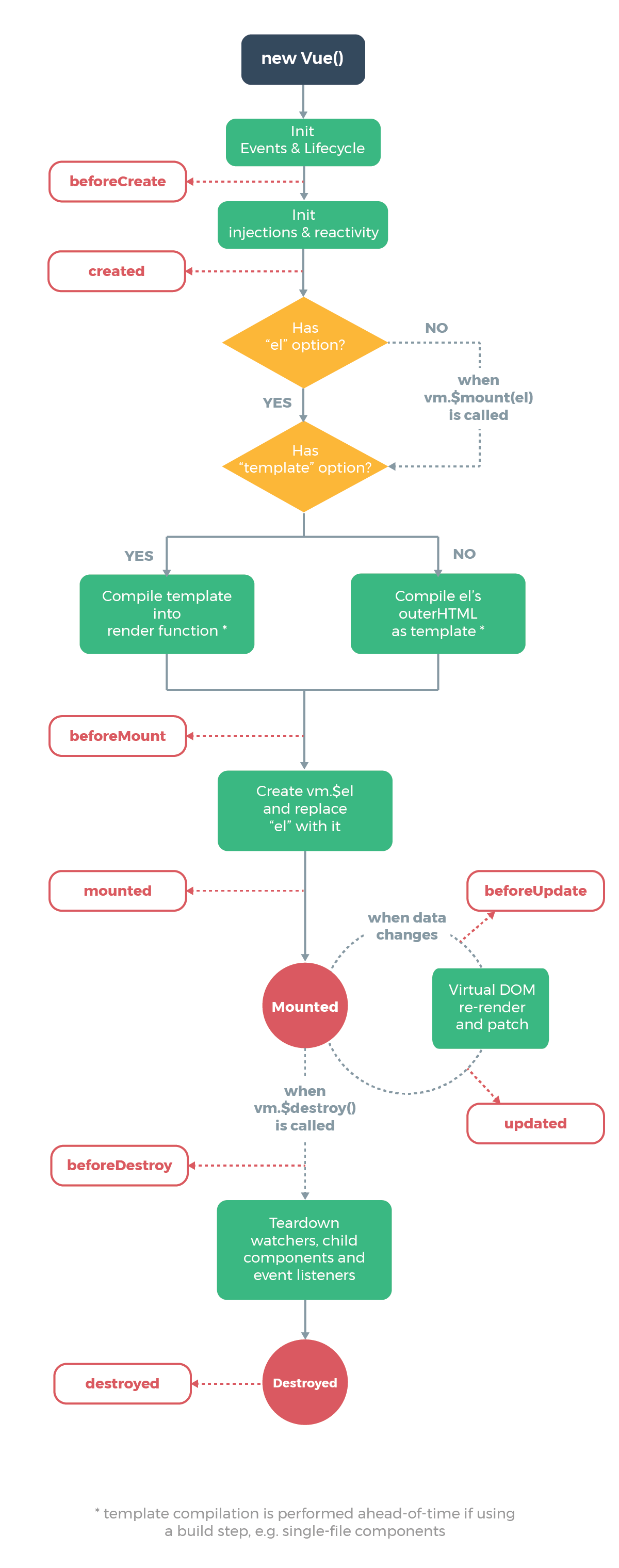

目标跟踪算法的输入是一段连续的视频序列, 以及视频第一帧指定的跟踪目标(以矩形标定框 B1 的形式给出),目标跟踪算法的输出是在后续 视频 t > 1 中估计目标的位置以及大小,同样以标 定框 Bt的形式给出。相关滤波目标跟踪算法的主 要思想是,在当前帧更新相关滤波器(记作 F ), 在下一帧利用所得的 F 通过循环卷积的操作实现 目标中心点定位。考虑相关滤波 目标跟踪算法在 t - 1 到第 t 帧的算法流程。如图 所示,相关滤波视频目标跟踪算法主要包含以下 5 个步骤:

步骤 1 (搜索区域):由于相邻两帧目标移 动范围有限,利用第 t - 1 帧的跟踪结果 Bt-1,通 过适当扩大Bt−1 得到目标搜索区域,并在视频第 t 帧图像的上述搜索区域内进行目标定位搜索。

步骤 2(特征提取):用步骤 1 得到的第 t 帧 的搜索区域,对该区域内的图像进行特征提取,得 到特征图 H。

步骤 3 (目标定位):相关滤波器 F作用于 提取的特征图 H,利用公式 得到响应图 C= H ∗ F, 式中 * 为循环卷积,计算响应图C的最大值所在 位置的坐标,即可得到当前帧图像上的目标中心位 置,Bt的大小可由Bt−1 进行缩放得到。

步骤 4(滤波更新):利用当前跟踪结果,如图下半栏所示,以目标为中心点截取子图像, 类似步骤 2 提取特征图 H,然后通过最小化公式 ,求解相关滤波器

这里 Y 是以空间中心点为最高值的 2-D 高斯分布图。上述优化问题可以利用快速傅里叶变换 (FFT)方法得到闭合解。

步骤 5(交替迭代):令 t = t + 1,返回步骤 1 进行交替迭代。在视频每一帧重复上述步骤,可以 逐帧得到滤波器以及每帧目标的位置及尺寸,完成视频目标跟踪任务。

离散傅里叶变换

假设有离散序列x,长度为N。用x^表示该离散序列的离散傅里叶变换。x^中的第m个元素可以通过下式进行计算:

令![]()

数据集

评价指标

多模态目标跟踪

基于 RGB-D 视频的目标跟踪

一些研究者开始关注 基于 RGB 图像和深度图像结合的视频目标跟踪算法。如图 所示,相比于颜色信息,深度信息 可以有效地帮助视频实现前景背景分离,同时为目标遮挡判定提供有效的指导.

基于 RGB-T 视频的目标跟踪

红外图像和 RGB 图像对于视频目标跟踪来说可 以提供互补的信息,例如 RGB 图像可以提供丰富 的目标外观颜色纹理信息,但在光照变化,雨雾场 景下受到较大的影响,而红外图像往往不受此类情 形的影响,如图 所示。与深度图像视频相似, 红外图像信息往往也能帮助指导视频中目标的前 背景分离。这是因为前景目标和背景通常具有不同 的热力值.

目标跟踪交叉领域研究

视频目标分割又可以帮助跟 踪更好地完成前背景分离,从而学习目标前景特征.