没办法,我还是很多基础的、底层的模块不通透,读论文难免会受到阻碍,而且这现在科研任务很急了,必须要马上动手实验,全给我弄明白、特别是算法!

空洞卷积-可变形卷积-这一个个我都要。

空洞卷积据说在语义分割中用得多,我看看怎么个事情。

参考文章1:总结-空洞卷积(Dilated/Atrous Convolution) - 知乎 (zhihu.com)

(一)使用推荐:

语义分割由于需要获得较大的分辨率图,因此在Network结构的最后2个stage取消了downsample(比如pooling)的操作,直接采用dilated convolution弥补缺失的感受野。

(二)注意事项

其实就是要防止空洞效应,所谓的空洞效应就是 不同层的卷积结果都是 重叠计算了相同的位置,这里的相同的位置是指最初的 HxW 中的位置

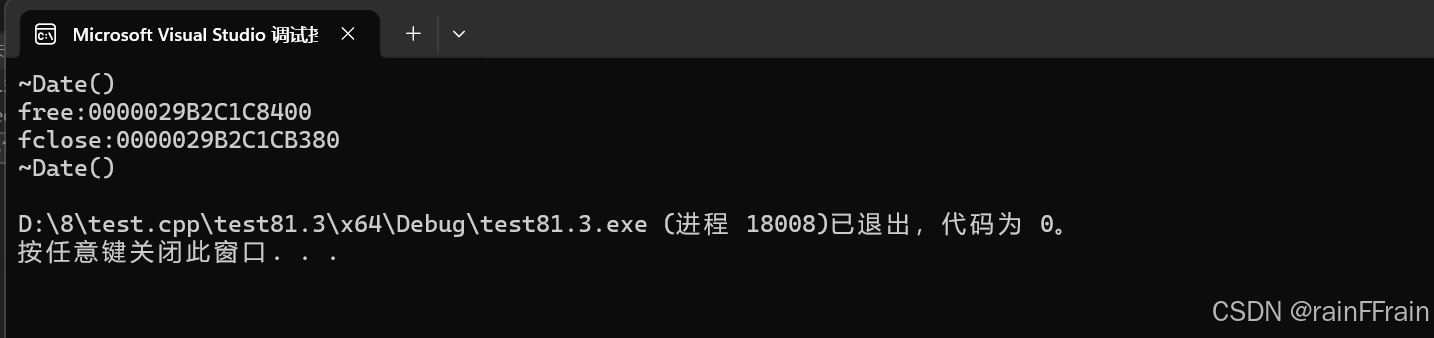

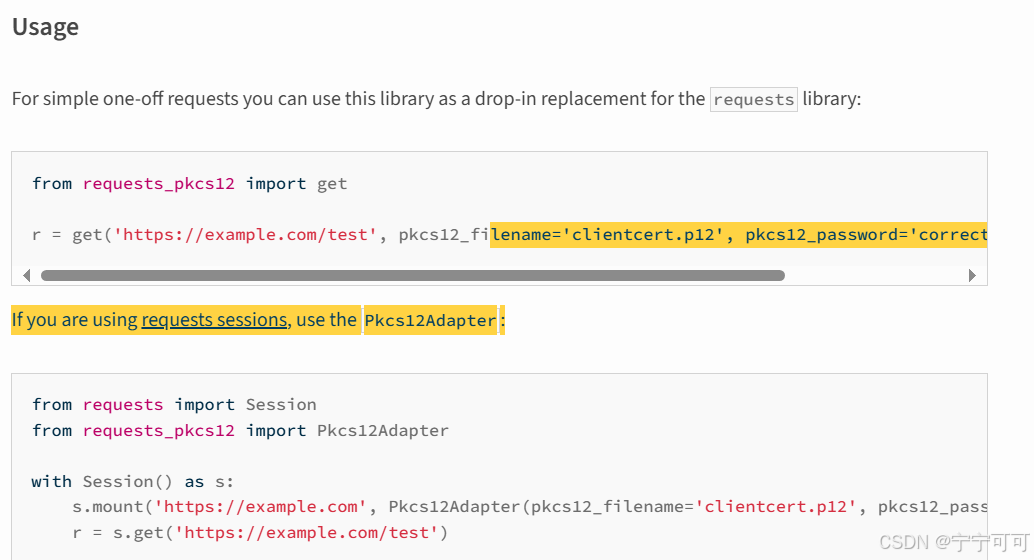

(三)实践

未完待续。。。