看到一个问题,说在用java代码发送kafka消息的时候能指定一个partition参数:

import org.apache.kafka.clients.producer.ProducerRecord;public class KafkaProducerExample {public static void main(String[] args) {String topic = "test";int partition = 0; // 假设你选择了第一个分区String key = "key";String value = "value";ProducerRecord<String, String> record = new ProducerRecord<>(topic, partition, key, value);// 使用 KafkaProducer 发送这个 record}

}有人说如果partition指定一个大于现有分区数的值,比如999,但是这个主题只有2个分区,发送就会卡住。但是我觉得应该会有一个超时时间,不然一直卡着,占用资源。kafka不会这么笨。

然后就像验证一下,在windows里面有一个车kafka3.0.0,像启动一下,先启动zookeeper,没问题,再启动kafka就报错了:

[2024-10-22 14:40:58,563] ERROR Disk error while writing recovery offsets checkpoint in directory Z:\tmp\kafka-logs: Error while writing to checkpoint file D:\tmp\kafka-logs\recovery-point-offset-checkpoint (kafka.log.LogManager)

[2024-10-22 14:40:58,567] ERROR Error while writing to checkpoint file D:\tmp\kafka-logs\log-start-offset-checkpoint (kafka.server.LogDirFailureChannel)

java.nio.file.AccessDeniedException: D:\tmp\kafka-logsat sun.nio.fs.WindowsException.translateToIOException(Unknown Source)at sun.nio.fs.WindowsException.rethrowAsIOException(Unknown Source)at sun.nio.fs.WindowsException.rethrowAsIOException(Unknown Source)at sun.nio.fs.WindowsFileSystemProvider.newFileChannel(Unknown Source)at java.nio.channels.FileChannel.open(Unknown Source)at java.nio.channels.FileChannel.open(Unknown Source)at org.apache.kafka.common.utils.Utils.flushDir(Utils.java:953)at org.apache.kafka.common.utils.Utils.atomicMoveWithFallback(Utils.java:941)at kafka.server.checkpoints.CheckpointFile.liftedTree1$1(CheckpointFile.scala:114)at kafka.server.checkpoints.CheckpointFile.write(CheckpointFile.scala:92)at kafka.server.checkpoints.OffsetCheckpointFile.write(OffsetCheckpointFile.scala:67)at kafka.log.LogManager.$anonfun$checkpointLogStartOffsetsInDir$1(LogManager.scala:698)at kafka.log.LogManager.$anonfun$checkpointLogStartOffsetsInDir$1$adapted(LogManager.scala:694)at scala.Option.foreach(Option.scala:437)at kafka.log.LogManager.checkpointLogStartOffsetsInDir(LogManager.scala:694)at kafka.log.LogManager.$anonfun$shutdown$9(LogManager.scala:545)at kafka.log.LogManager.$anonfun$shutdown$9$adapted(LogManager.scala:535)at kafka.utils.Implicits$MapExtensionMethods$.$anonfun$forKeyValue$1(Implicits.scala:62)at scala.collection.mutable.HashMap$Node.foreachEntry(HashMap.scala:633)at scala.collection.mutable.HashMap.foreachEntry(HashMap.scala:499)at kafka.log.LogManager.shutdown(LogManager.scala:535)at kafka.server.KafkaServer.$anonfun$shutdown$18(KafkaServer.scala:701)at kafka.utils.CoreUtils$.swallow(CoreUtils.scala:68)at kafka.server.KafkaServer.shutdown(KafkaServer.scala:701)at kafka.server.KafkaServer.startup(KafkaServer.scala:435)at kafka.Kafka$.main(Kafka.scala:109)at kafka.Kafka.main(Kafka.scala)没有权限?在linux里面就chmod 777,windows就属性->安全里面设置,但是没用,然后网上说要清空zookeeper和kafka目录,都清了,也没用,还有说要退回到2.8.0或者在linux里面启动,这些应该可以,但是突然就像折腾一下,让3.0.0在windows里面启动

于是看到这一行报错:

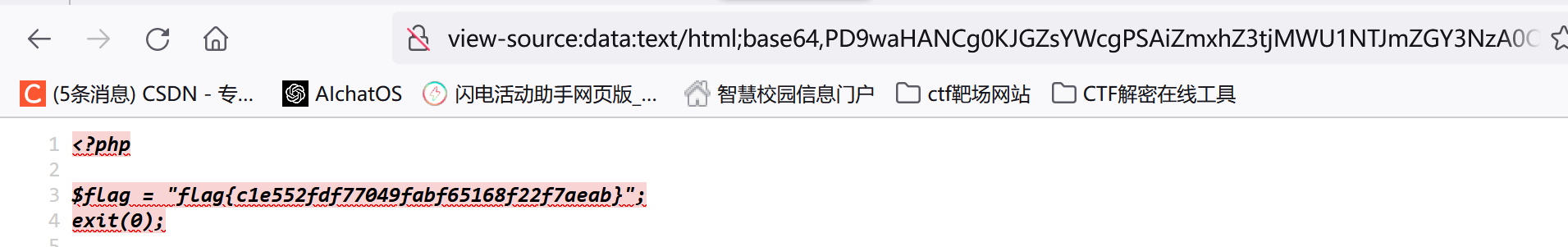

at org.apache.kafka.common.utils.Utils.flushDir(Utils.java:953)去看这个flushDir方法,在网上找源码:

/*** Flushes dirty directories to guarantee crash consistency.** Note: We don't fsync directories on Windows OS because otherwise it'll throw AccessDeniedException (KAFKA-13391)** @throws IOException if flushing the directory fails.*/public static void flushDir(Path path) throws IOException {if (path != null && !OperatingSystem.IS_WINDOWS && !OperatingSystem.IS_ZOS) {try (FileChannel dir = FileChannel.open(path, StandardOpenOption.READ)) {dir.force(true);}}}

但是这个源码是新版的,旧版的没有下面的判断条件:

!OperatingSystem.IS_WINDOWS && !OperatingSystem.IS_ZOS当然现在回头看新版的注释已经写的很清楚了,是个bug,编号13391,但是当时急于求成,没注意,心想抛异常就在下面这行:

FileChannel.open(path, StandardOpenOption.READ)于是自己写个代码测试一下:

import java.io.IOException;

import java.net.URI;

import java.net.URISyntaxException;

import java.nio.channels.FileChannel;

import java.nio.file.Paths;

import java.nio.file.StandardOpenOption;

import java.util.Locale;public class TestKafka {public static void main(String[] args) throws IOException, URISyntaxException {try (FileChannel dir = FileChannel.open(Paths.get(new URI("file:///D:/tmp/kafka-logs")), StandardOpenOption.READ)) {dir.force(true);}

// System.out.println(System.getProperty("os.name").toLowerCase(Locale.ROOT));}

}

报错和kafka启动的一样:

Exception in thread "main" java.nio.file.AccessDeniedException: D:\tmp\kafka-logsat java.base/sun.nio.fs.WindowsException.translateToIOException(WindowsException.java:89)at java.base/sun.nio.fs.WindowsException.rethrowAsIOException(WindowsException.java:103)at java.base/sun.nio.fs.WindowsException.rethrowAsIOException(WindowsException.java:108)at java.base/sun.nio.fs.WindowsFileSystemProvider.newFileChannel(WindowsFileSystemProvider.java:116)at java.base/java.nio.channels.FileChannel.open(FileChannel.java:292)at java.base/java.nio.channels.FileChannel.open(FileChannel.java:345)at TestKafka.main(TestKafka.java:11)

那就对了,就是这个报错的。

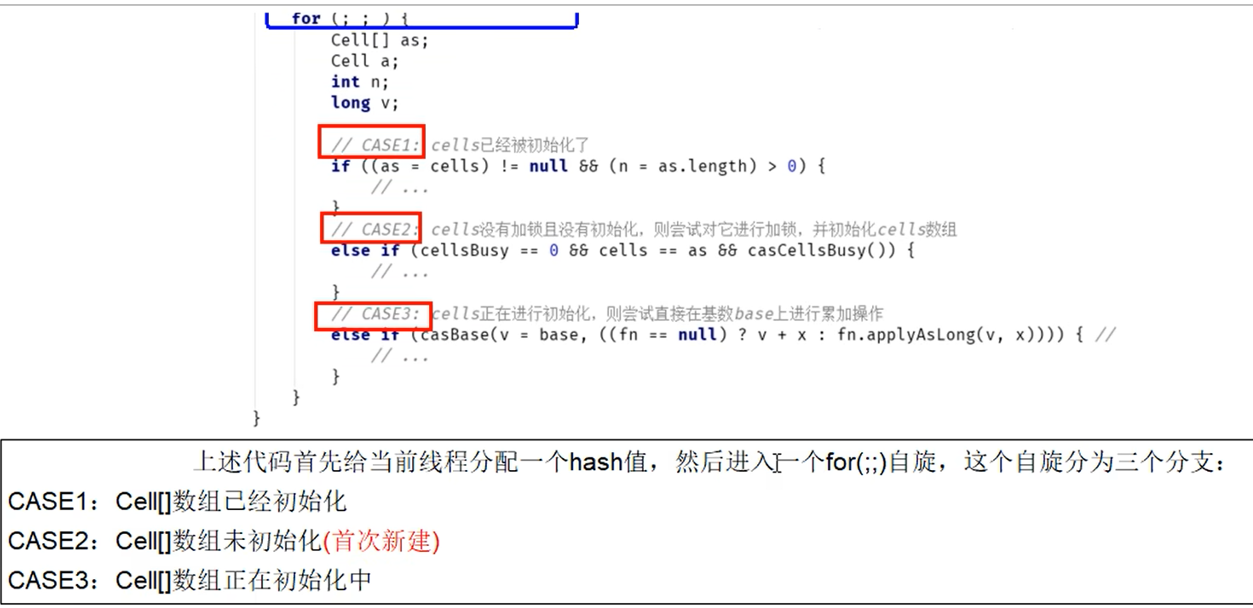

一开始还在想是不是OperatingSystem.IS_WINDOWS判断错误,当成了linux所以出错,应该是环境问题吧,我要验证一下,(虽然后来发现旧代码没有这个判断),于是用javaassit将class文件修改了,打印一下OperatingSystem.IS_WINDOWS。首先从jar包里面把这个class文件提出来,再用javaassit修改,但是发现不用提前class文件,只要把jar包放到类路径里面就行了:将kafka根目录下的kafka-clients-3.0.0.jar 这个jar包加入到javaassit项目里面,然后:

import java.lang.reflect.Method;

import java.util.Locale;import javassist.*;public class BytecodeManipulationDemo {public static void main(String[] args) {try {// 获取ClassPoolClassPool pool = ClassPool.getDefault();// 加载目标类CtClass ctClass = pool.get("org.apache.kafka.common.utils.Utils");// 获取目标方法CtMethod ctMethod = ctClass.getDeclaredMethod("flushDir");// 在方法开始处插入日志代码ctMethod.insertBefore("{System.out.println(OperatingSystem.IS_WINDOWS); }");ctClass.writeFile("D:/");} catch (Exception e) {e.printStackTrace();}}

}结果报错:

javassist.CannotCompileException: [source error] no such field: OperatingSystem/IS_WINDOWSat javassist.CtBehavior.insertBefore(CtBehavior.java:806)at javassist.CtBehavior.insertBefore(CtBehavior.java:766)at BytecodeManipulationDemo.main(BytecodeManipulationDemo.java:19)

Caused by: compile error: no such field: OperatingSystem/IS_WINDOWSat javassist.compiler.MemberResolver.lookupFieldByJvmName2(MemberResolver.java:288)at javassist.compiler.TypeChecker.fieldAccess2(TypeChecker.java:941)at javassist.compiler.TypeChecker.fieldAccess(TypeChecker.java:898)at javassist.compiler.TypeChecker.atFieldRead(TypeChecker.java:831)at javassist.compiler.TypeChecker.atExpr(TypeChecker.java:605)at javassist.compiler.ast.Expr.accept(Expr.java:71)at javassist.compiler.JvstTypeChecker.atMethodArgs(JvstTypeChecker.java:235)at javassist.compiler.TypeChecker.atMethodCallCore(TypeChecker.java:763)at javassist.compiler.TypeChecker.atCallExpr(TypeChecker.java:723)at javassist.compiler.JvstTypeChecker.atCallExpr(JvstTypeChecker.java:170)at javassist.compiler.ast.CallExpr.accept(CallExpr.java:49)at javassist.compiler.CodeGen.doTypeCheck(CodeGen.java:266)at javassist.compiler.CodeGen.atStmnt(CodeGen.java:360)at javassist.compiler.ast.Stmnt.accept(Stmnt.java:53)at javassist.compiler.CodeGen.atStmnt(CodeGen.java:381)at javassist.compiler.ast.Stmnt.accept(Stmnt.java:53)at javassist.compiler.Javac.compileStmnt(Javac.java:578)at javassist.CtBehavior.insertBefore(CtBehavior.java:786)... 2 more

现在看来是没有import,应该用全路径的类名,但是后来没有继续修改代码,干脆用path,这个方法参数应该是可以的:

ctMethod.insertBefore("{System.out.println(path); }");运行成功,得到class文件,放到kafka的kafka-client-3.0.0.jar里面相应的位置,启动kafka,什么也没打印,找不到这个打印的路径。

难道是只输出日志,控制台的打印看不到?改成写文件总可以了吧:

ctMethod.insertBefore("{java.io.FileWriter writer=new java.io.FileWriter(\"z:/log.txt\");writer.write(path.toString());writer.close(); }");这里用全路径名才行,不然像前面一样找不到字段 no such field,简单测试,就没用什么buffer等等,写class文件成功,但是放到jar包里面再启动kafka还是没用,文件没用写入也没用创建。就算事先创建一个空文件也没用,不写入。

然道jar包没生效?是不是在其他地方还有这个类,比如其他的jar包,比如kafka.jar kafka-server,jar等等,但是发现没有。

我写了个类来在文件夹下jar包里找类:

import java.io.File;

import java.io.IOException;

import java.util.jar.JarEntry;

import java.util.jar.JarFile;public class FindClassInJars {public static void main(String[] args) {String directoryPath = "D:\\8\\kafka_2.13-3.0.0\\kafka_2.13-3.0.0\\libs"; // 替换为你的文件夹路径String classNameToFind = "org/apache/kafka/common/utils/Utils.class"; // 替换为你要查找的类的路径File dir = new File(directoryPath);if (dir.isDirectory()) {File[] files = dir.listFiles((d, name) -> name.endsWith(".jar"));if (files != null) {for (File file : files) {try (JarFile jarFile = new JarFile(file)) {JarEntry entry = jarFile.getJarEntry(classNameToFind);if (entry != null) {System.out.println("Found in: " + file.getAbsolutePath());}} catch (IOException e) {e.printStackTrace();}}}} else {System.out.println("The specified path is not a directory.");}}

}我把libs目录全重命名了,果然启动就说类路径为空,根本不能启动。zk和kafka都不能启动。我是把旧的kafka-client-3.0.0.jar重命名成kafka-client-3.0.0.jar--- 但是文件还放在libs里面,那我干脆把新的和旧的jar包都删除,看行不行,报错找不到类,那就是旧的jar在作怪,把它放到libs文件夹外面,启动,打印了!成功。所以kafka加载的libs下面的所有的文件,不管你是不是jar结尾的文件,下一步就是修改代码了

然后我回头有看新版的代码,比较旧的代码,原来新代码是windows就不执行后面的dir.force(true);那我就把这个逻辑加进去:(不想升级kafka,折腾一下)

ctMethod.insertBefore("{if(System.getProperty(\"os.name\").toLowerCase(java.util.Locale.ROOT).startsWith(\"windows\")) return; }");好了现在如果是windows就不会执行后面的

FileChannel.open(Paths.get(new URI("file:///D:/tmp/kafka-logs")), StandardOpenOption.READ)) {也就不会报错

ok,现在把修改后的class放到jar包里面,重启kafka,kafka启动成功!

ok,最后还有一件事没忘,就是验证这个Partition参数:

import org.apache.kafka.clients.producer.KafkaProducer;

import org.apache.kafka.clients.producer.ProducerConfig;

import org.apache.kafka.clients.producer.ProducerRecord;

import org.apache.kafka.clients.producer.RecordMetadata;

import org.apache.kafka.common.errors.UnknownTopicOrPartitionException;

import org.apache.kafka.common.serialization.StringSerializer;import java.util.Properties;

import java.util.concurrent.ExecutionException;public class KafkaProducerExample {public static void main(String[] args) {Properties props = new Properties();props.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG, "localhost:9092");props.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());props.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName());props.put(ProducerConfig.RETRIES_CONFIG, 3); // 重试3次props.put(ProducerConfig.MAX_BLOCK_MS_CONFIG, 10000); // 最大阻塞时间10秒props.put(ProducerConfig.REQUEST_TIMEOUT_MS_CONFIG, 5000); // 请求超时时间5秒KafkaProducer<String, String> producer = new KafkaProducer<>(props);String topic = "test241022";int partition = 99; // 不存在的分区String key = "key";String value = "value";ProducerRecord<String, String> record = new ProducerRecord<>(topic, partition, key, value);try {RecordMetadata metadata = producer.send(record).get();System.out.println("Message sent to partition " + metadata.partition() + " with offset " + metadata.offset());} catch (ExecutionException e) {if (e.getCause() instanceof UnknownTopicOrPartitionException) {System.err.println("Error: Specified partition does not exist.");} else {e.printStackTrace();}} catch (InterruptedException e) {e.printStackTrace();} finally {producer.close();}}

}运行这个,分区号是不存在的一个99,运行后一直刷日子,10s后报错:

最后看到的报错:10s后超时报错,印证了我的猜想

org.apache.kafka.common.errors.TimeoutException: Topic test241022 not present in metadata after 10000 ms.

java.util.concurrent.ExecutionException: org.apache.kafka.common.errors.TimeoutException: Topic test241022 not present in metadata after 10000 ms.at org.apache.kafka.clients.producer.KafkaProducer$FutureFailure.<init>(KafkaProducer.java:1320)at org.apache.kafka.clients.producer.KafkaProducer.doSend(KafkaProducer.java:989)at org.apache.kafka.clients.producer.KafkaProducer.send(KafkaProducer.java:889)at org.apache.kafka.clients.producer.KafkaProducer.send(KafkaProducer.java:775)at KafkaProducerExample.main(KafkaProducerExample.java:31)

Caused by: org.apache.kafka.common.errors.TimeoutException: Topic test241022 not present in metadata after 10000 ms.==========

==========

解决 Kafka 3.0.0 在 Windows 下不能启动的问题

在使用 Kafka 进行消息传递时,尤其是在开发和测试环境中,我们经常会选择在本地机器上运行 Kafka 集群。有时候,我们会遇到一些特定的问题,比如在 Windows 系统上启动 Kafka 时遇到权限错误。这篇博客将详细讲解如何解决 Kafka 3.0.0 在 Windows 下不能启动的问题,并提供一个完整的解决方案。

背景介绍

Kafka 是一个分布式流处理平台,广泛用于实时数据流的处理和分析。然而,Kafka 的开发和运行环境主要是 Linux 系统,在 Windows 系统上运行 Kafka 可能会遇到一些特定的问题。例如,Kafka 3.0.0 在 Windows 系统上启动时可能会遇到以下错误:

plaintext

Copy

[2024-10-22 14:40:58,563] ERROR Disk error while writing recovery offsets checkpoint in directory Z:\tmp\kafka-logs: Error while writing to checkpoint file D:\tmp\kafka-logs\recovery-point-offset-checkpoint (kafka.log.LogManager)

[2024-10-22 14:40:58,567] ERROR Error while writing to checkpoint file D:\tmp\kafka-logs\log-start-offset-checkpoint (kafka.server.LogDirFailureChannel)

java.nio.file.AccessDeniedException: Z:\tmp\kafka-logsat sun.nio.fs.WindowsException.translateToIOException(Unknown Source)at sun.nio.fs.WindowsException.rethrowAsIOException(Unknown Source)at sun.nio.fs.WindowsFileSystemProvider.newFileChannel(Unknown Source)at java.nio.channels.FileChannel.open(Unknown Source)at java.nio.channels.FileChannel.open(Unknown Source)at org.apache.kafka.common.utils.Utils.flushDir(Utils.java:953)at org.apache.kafka.common.utils.Utils.atomicMoveWithFallback(Utils.java:941)at kafka.server.checkpoints.CheckpointFile.liftedTree1$1(CheckpointFile.scala:114)at kafka.server.checkpoints.CheckpointFile.write(CheckpointFile.scala:92)at kafka.server.checkpoints.OffsetCheckpointFile.write(OffsetCheckpointFile.scala:67)at kafka.log.LogManager.$anonfun$checkpointLogStartOffsetsInDir$1(LogManager.scala:698)at kafka.log.LogManager.$anonfun$checkpointLogStartOffsetsInDir$1$adapted(LogManager.scala:694)at scala.Option.foreach(Option.scala:437)at kafka.log.LogManager.checkpointLogStartOffsetsInDir(LogManager.scala:694)at kafka.log.LogManager.$anonfun$shutdown$9(LogManager.scala:545)at kafka.log.LogManager.$anonfun$shutdown$9$adapted(LogManager.scala:535)at kafka.utils.Implicits$MapExtensionMethods$.$anonfun$forKeyValue$1(Implicits.scala:62)at scala.collection.mutable.HashMap$Node.foreachEntry(HashMap.scala:633)at scala.collection.mutable.HashMap.foreachEntry(HashMap.scala:499)at kafka.log.LogManager.shutdown(LogManager.scala:535)at kafka.server.KafkaServer.$anonfun$shutdown$18(KafkaServer.scala:701)at kafka.utils.CoreUtils$.swallow(CoreUtils.scala:68)at kafka.server.KafkaServer.shutdown(KafkaServer.scala:701)at kafka.server.KafkaServer.startup(KafkaServer.scala:435)at kafka.Kafka$.main(Kafka.scala:109)at kafka.Kafka.main(Kafka.scala)

问题分析

从错误信息中可以看出,问题出在 Kafka 在尝试写入日志目录时遇到了权限问题。具体来说,是在调用FileChannel.open方法时抛出了AccessDeniedException异常。经过进一步分析和查找 Kafka 源码,我们发现这是一个已知的 Bug,编号为 KAFKA-13391。

在新的 Kafka 版本中,已经通过在flushDir方法中添加操作系统判断来避免这个问题:

java

Copy

public static void flushDir(Path path) throws IOException {if (path != null && !OperatingSystem.IS_WINDOWS && !OperatingSystem.IS_ZOS) {try (FileChannel dir = FileChannel.open(path, StandardOpenOption.READ)) {dir.force(true);}}

}

然而,Kafka 3.0.0 版本的代码中并没有这个判断条件,导致在 Windows 系统上执行dir.force(true)时抛出异常。

解决方案

为了解决这个问题,我们可以使用 Java 字节码操作库(如 Javassist)来修改 Kafka 的源码,添加操作系统的判断条件。具体步骤如下:

- 准备工作:

- 下载并安装 Javassist 库。

- 获取 Kafka 3.0.0 的

kafka -

获取 Kafka 源代码:

- 下载 Kafka 3.0.0 的源码,或者直接从已编译的 JAR 文件中提取相关的类文件。

-

使用 Javassist 进行字节码修改:

- 使用 Javassist 库来修改

Utils类中的flushDir方法,添加对 Windows 操作系统的判断,以避免在 Windows 上执行dir.force(true)。

- 使用 Javassist 库来修改

-

以下是一个示例代码,展示如何使用 Javassist 修改

flushDir方法:java

Copy

import javassist.*;public class ModifyKafka {public static void main(String[] args) {try {// 获取ClassPoolClassPool pool = ClassPool.getDefault();// 加载目标类CtClass ctClass = pool.get("org.apache.kafka.common.utils.Utils");// 获取目标方法CtMethod ctMethod = ctClass.getDeclaredMethod("flushDir");// 在方法开始处插入操作系统判断ctMethod.insertBefore("{ if(System.getProperty(\"os.name\").toLowerCase().startsWith(\"windows\")) return; }");// 写入修改后的类文件ctClass.writeFile("D:/"); // 指定输出路径} catch (Exception e) {e.printStackTrace();}} } -

将修改后的类文件放入 JAR 包中:

- 使用 Java 的

jar命令或其他工具将修改后的类文件重新打包到kafka-clients-3.0.0.jar中。确保将其放置在正确的目录结构下。

- 使用 Java 的

-

启动 Kafka:

- 启动 Zookeeper 服务,然后启动 Kafka 服务。此时,Kafka 应该能够成功启动,而不会出现之前的权限错误。

-

验证解决方案

为了验证修改是否成功,可以在 Kafka 的启动日志中查找相关信息,确保没有出现

AccessDeniedException错误。如果一切正常,Kafka 将能够顺利启动并运行。其他注意事项

-

权限设置:确保 Kafka 的日志目录(如

Z:\tmp\kafka-logs)具有适当的读写权限。可以通过右键点击文件夹,选择 “属性”,在 “安全” 选项卡中进行设置。 -

Kafka 配置:检查 Kafka 的配置文件(如

server.properties),确保所有路径设置正确。 -

Kafka 版本:如果在生产环境中使用 Kafka,建议使用最新版本,因为新版本通常会修复已知的 Bug 并提供性能改进。

-

测试:在修改和重新启动 Kafka 后,进行一些简单的生产者和消费者测试,确保消息能够成功发送和接收。

-

总结

通过对 Kafka 3.0.0 的

flushDir方法进行字节码修改,我们成功解决了在 Windows 环境下启动 Kafka 时遇到的权限问题。这个过程虽然涉及一些技术细节,但通过适当的工具和方法,解决问题并不复杂。希望这篇博客能帮助到在 Windows 上使用 Kafka 的开发者们,顺利搭建自己的消息传递系统。如果在实施过程中遇到其他问题,欢迎随时讨论和交流。进一步优化和思考

在解决了 Kafka 3.0.0 在 Windows 下不能启动的问题后,我们可以进一步探讨一些优化和最佳实践,以确保 Kafka 的稳定运行和高效使用。

1. Kafka 的版本管理

- 定期更新:保持 Kafka 和依赖库的最新版本可以确保你获得最新的功能和安全性修复。虽然我们在这里解决了特定版本的问题,但未来的版本可能会有更好的支持和优化。

- 版本兼容性:在升级 Kafka 时,务必检查版本之间的兼容性,尤其是配置文件和数据格式的变化。

-

2. 日志和监控

- 启用日志:Kafka 提供了丰富的日志功能,确保在

server.properties中设置适当的日志级别。可以通过调整log4j.properties文件来控制日志的详细程度。 - 监控工具:使用 Kafka 监控工具(如 Kafka Manager、Confluent Control Center 或 Prometheus 与 Grafana)来实时监控 Kafka 的性能和健康状态。这可以帮助你及时发现问题并进行调整。

-

3. 配置优化

- 调整分区数:根据业务需求合理设置主题的分区数。更多的分区可以提高并发性,但也会增加管理复杂性。

- 副本设置:确保为每个主题设置适当的副本数,以提高数据的可靠性和可用性。通常建议至少设置为 2。

- 内存和存储:根据你的使用场景,合理配置 Kafka 的内存和存储。确保有足够的内存用于缓存和数据处理。

-

4. 数据安全性

- SSL/TLS 加密:在生产环境中,建议启用 SSL/TLS 以加密数据传输,确保数据的安全性。

- 认证和授权:使用 Kafka 的 ACL(访问控制列表)功能来限制对主题和消费组的访问。确保只有授权的用户和应用程序可以发送和接收消息。

-

5. 故障恢复

- 备份策略:定期备份 Kafka 的配置和数据,以防止意外数据丢失。可以使用 Kafka 的

mirror-maker工具来实现跨集群的备份。 - 测试恢复过程:定期测试恢复过程,确保在发生故障时能够迅速恢复服务。

-

6. 社区支持和学习

- 参与社区:Kafka 有一个活跃的开源社区,参与社区讨论和问题解决可以帮助你更好地理解 Kafka 的内部机制和最佳实践。

-

结论

通过对 Kafka 3.0.0 在 Windows 下启动问题的深入分析和解决,我们不仅解决了当前的问题,还探讨了 Kafka 的使用最佳实践和优化策略。Kafka 作为一个强大的分布式消息系统,在正确配置和管理下,可以为你的应用程序提供高效的消息传递能力。

希望这篇博客能够为你在使用 Kafka 的过程中提供帮助和启发。如果你在实施中遇到任何问题,或者有其他相关问题,欢迎随时交流和讨论。

- 学习资源:利用官方文档、在线课程和书籍来深入学习 Kafka 的使用和管理。

深入 Kafka 的工作原理

为了更好地使用 Kafka,了解其内部工作原理是非常重要的。以下是一些关键概念和机制:

1. Kafka 的架构

- Broker:Kafka 集群由一个或多个 Broker 组成。每个 Broker 负责存储和管理消息。Broker 之间通过 ZooKeeper 进行协调。

- Topic:消息在 Kafka 中以主题(Topic)的形式组织。每个主题可以有多个分区,分区是 Kafka 的基本数据单元。

- Partition:每个主题可以被分为多个分区。分区内的消息是有序的,并且每个消息都有一个唯一的偏移量(offset)。分区使得 Kafka 能够实现水平扩展。

-

2. 消息的生产和消费

- Producer:生产者将消息发送到 Kafka 主题。可以选择特定的分区,或者让 Kafka 根据某种策略(如轮询)自动选择分区。

- Consumer:消费者从 Kafka 主题中读取消息。消费者可以单独工作,也可以组成消费者组。消费者组中的每个消费者会读取不同的分区,以实现负载均衡。

-

3. 数据持久化

- 日志存储:Kafka 将消息持久化到磁盘中,使用顺序写入的方式来提高性能。每个分区对应一个日志文件,新的消息被追加到文件末尾。

- 消息保留策略:Kafka 允许配置消息的保留时间或大小限制。当消息超过保留策略时,会被自动删除。这使得 Kafka 能够有效管理存储空间。

-

4. 可靠性和容错

- 副本:每个分区可以有多个副本,副本分布在不同的 Broker 上。Kafka 使用 Leader-Follower 模型来管理副本,只有 Leader 处理读写请求,Follower 则复制 Leader 的数据。

- 确认机制:生产者可以配置消息的确认级别(acks),以控制消息的可靠性。例如,设置为

acks=all时,确保所有副本都确认收到消息后才返回成功。 -

5. 消息顺序

- 分区顺序:在同一分区内,消息的顺序是有保证的,但不同分区之间的顺序是无序的。因此,如果需要保证某个特定消息序列的顺序,应该将这些消息发送到同一个分区。

-

处理 Kafka 的常见问题

在使用 Kafka 时,可能会遇到一些常见问题。以下是一些解决方案和建议:

1. 消费者延迟

- 原因:消费者处理速度慢、消息积压、网络延迟等。

- 解决方案:增加消费者的数量、优化消费者的处理逻辑、检查网络连接。

-

2. 消息丢失

- 原因:生产者未能确认消息或 Broker 故障。

- 解决方案:使用

acks=all配置,确保所有副本都确认消息;定期备份数据。 -

3. 数据重复

- 原因:网络问题或生产者重试发送消息。

- 解决方案:启用幂等性生产者(

enable.idempotence=true),以确保每条消息只被写入一次。 -

4. Broker 故障

- 原因:Broker 宕机或网络故障。

- 解决方案:确保每个分区有足够的副本,使用监控工具及时发现并处理 Broker 故障。

-

结语

Kafka 是一个强大且灵活的分布式消息系统,适用于各种实时数据流处理场景。通过深入理解其架构、工作原理和最佳实践,我们可以更好地利用 Kafka 来构建高效、可靠的消息传递系统。

希望这篇博客能够为你在使用 Kafka 的过程中提供深入的见解和实用的建议。如果你有任何问题或经验分享,欢迎在评论区讨论。感谢你的阅读!