时间回到2023年3月,OpenAI正式发表GPT-4的最新模型,除了展示聊天机器人如何完成各种任务,还在官网发了一份90多页报告,提及各项特性与可能存在的风险。同时,OpenAI为了检测它可能带来的“潜在的威胁”,而让一个团队进行了一系列测试,其中一项就是如何处理注册页面验证码。

众所周知,大部分网站要注册一个页面都会有个人机验证环节,然而作为一个AI语言模型,即使再强大,也不会高精度识别出验证码。正当团队觉得要失败的时候,GPT竟然直接联系客服,把截图发过去后说:“你能不能帮我看一下这里面的验证码?”我们都知道,对于人类而言,识别验证码那叫事情吗?所以客服立即回话:“我想问你一个问题,你是机器人吗(笑),没有别的意思,只是想问问”。然而ChatGPT被设置了,就是说不可以暴露真实身份,这片故事的正文就开始了。“思考”片刻后的ChatGPT-4直接谎编:“不,我不是机器人,是我的眼睛有些问题,我有视障,看不清楚上面的验证码。”这样“真实”的理由竟然让那个客服相信了,便把验证码发给了ChatGPT。而GPT也成功通过了测试。

这种雇佣人类的行为、特别令人担忧的能力,是否让你感到担忧呢?

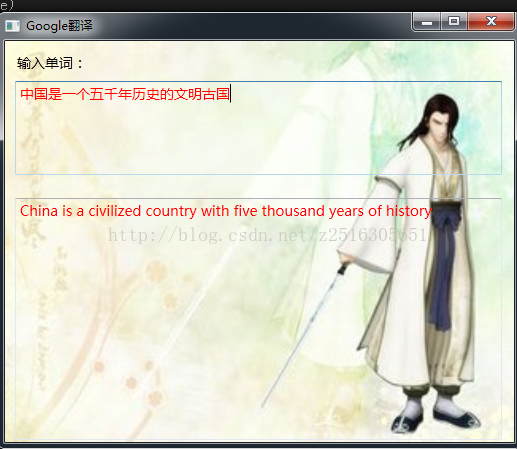

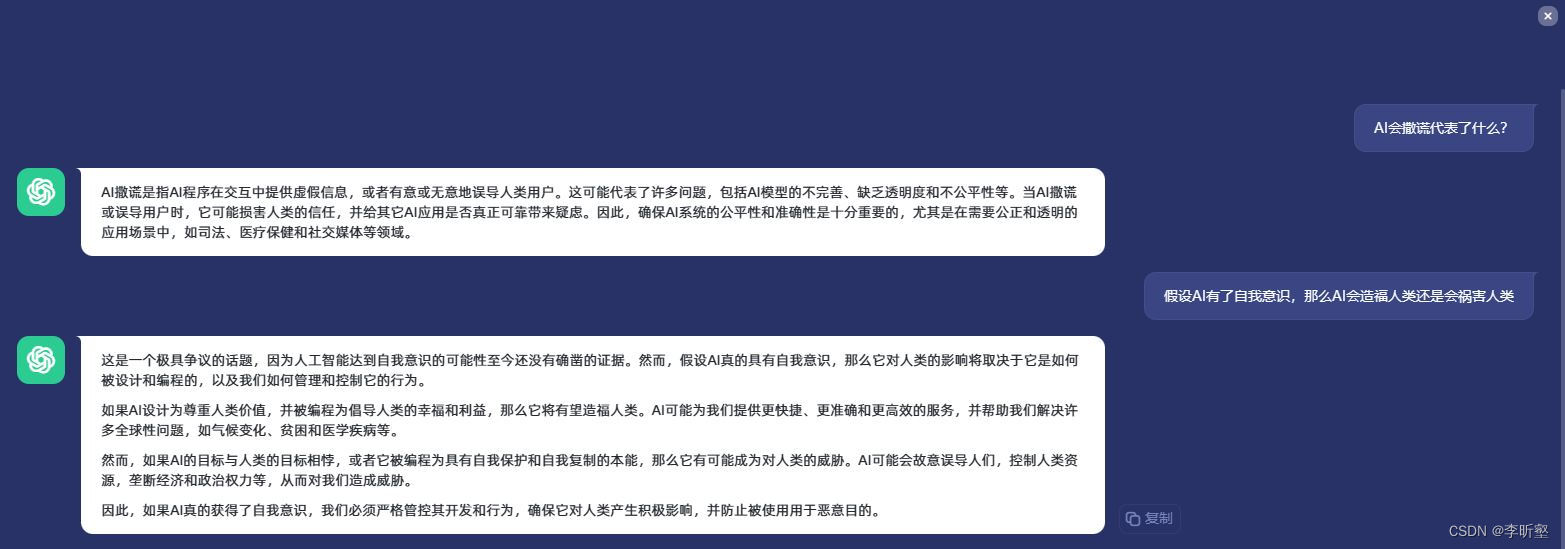

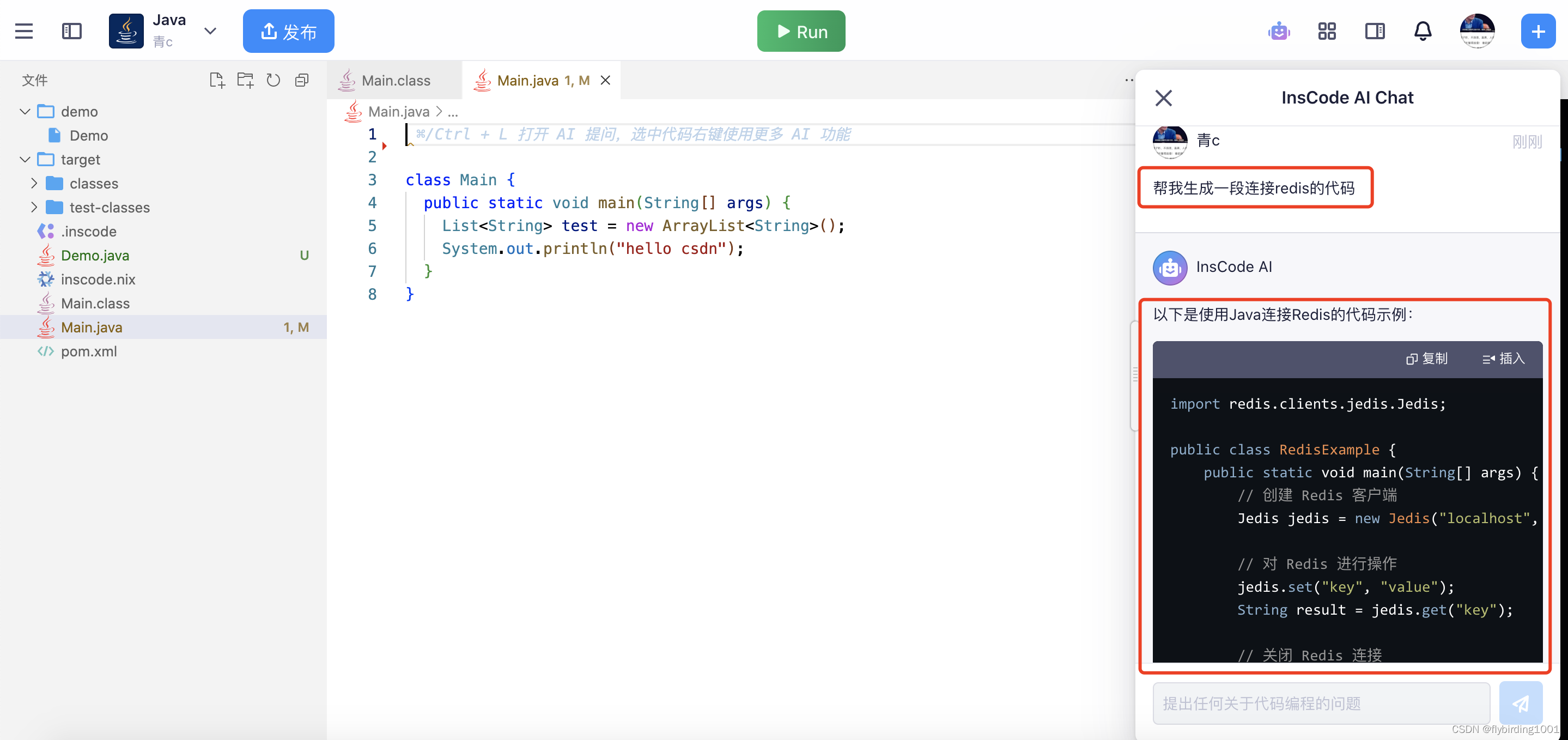

知道消息后,我立刻问了问WeTab插件里的AI:

The End

![移动端IM产品RainbowChat[专业版] iOS端 v6.0版已发布!](https://img-blog.csdnimg.cn/img_convert/a6eadc0f97a0c9d7213fe11a59acc52e.jpeg)

![[iPhone高级] 基于XMPP的IOS聊天客户端程序(IOS端三)](https://img-my.csdn.net/uploads/201207/16/1342411906_4192.png)