前言

“AI作画依赖于多模态预训练,实际上各类作画AI模型早已存在,之所以近期作品质量提升很多,可能是因为以前预训练没有受到重视,还达不到媲美人类的程度,但随着数据量、训练量的增多,最终达到了现在呈现的效果。”远在AI作画还没有爆火之前,深度学习就已经可以根据图片库训练学习生成一些真假难辨的图片了,那时候仅仅依赖的是GAN神经对抗网络算法实现,现在随着模型的迭代优化,已经有了越来越多的模型能够实现一些较为复杂的图片生成。

AI作画用以学习的“教材”往往都是现成的人类绘画作品,而随着数量庞大的训练数据的增加,AI对人类作品意境的“临摹”技巧也越来越高明。对于大多数普通人来说,进行AI绘图创作无疑是新奇的体验,只需输入prompt关键词,就能生成自己想要的图片,尤其在AICG等领域,利用AI绘图工具创作二次元风格的插图,甚至漫画都已成为不少人的常态。那么我们就根据模型原理+过程+效果对已有程序 昆仑万维AIG进行研究评测。

模型model

1.基于 VQ-VAE

DeepMind(和PixelCNN同一作)于2017年提出的一种基于离散隐变量(Discrete Latent variables)的生成模型:VQ-VAE。VQ-VAE相比VAE有两个重要的区别:首先VQ-VAE采用离散隐变量,而不是像VAE那样采用连续的隐变量;然后VQ-VAE需要单独训练一个基于自回归的模型如PixelCNN来学习先验(prior),而不是像VAE那样采用一个固定的先验(标准正态分布)。此外,VQ-VAE还是一个强大的无监督表征学习模型,它学习的离散编码具有很强的表征能力,最近比较火的文本转图像模型DALL-E也是基于VQ-VAE的,而且最近的一些基于masked image modeling的无监督学习方法如BEiT也用VQ-VAE得到的离散编码作为训练目标。

2.基于 Diffusion Model

不同于 VQ-VAE,VQ-GAN,扩散模型是当今文本生成图像领域的核心方法,当前最知名也最受欢迎的文本生成图像模型 Stable Diffusion,Disco-Diffusion,Mid-Journey,DALL-E2 等等,

上文提到的 VQ-VAE 以及 VQ-GAN,都是先通过编码器将图像映射到中间潜变量,然后解码器在通过中间潜变量进行还原。实际上,扩散模型做的事情本质上是一样的,不同的是,扩散模型完全使用了全新的思路来实现这个目标123。

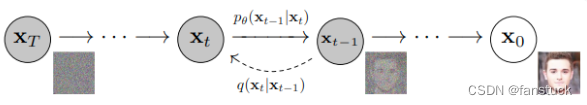

在扩散模型中,主要有两个过程组成,前向扩散过程,反向去噪过程,前向扩散过程主要是将一张图片变成随机噪音,而逆向去噪过程则是将一张随机噪音的图片还原为一张完整的图片。

3.第一个开源中文 Disco Diffusion 模型

2022 年 7 月,IDEA CCNL开源了第一个中文 CLIP 模型,目前已经有 4 个版本。

-

Taiyi-CLIP-Roberta-102M-Chinese:https://huggingface.co/IDEA-CCNL/Taiyi-CLIP-Roberta-102M-Chinese

-

Taiyi-CLIP-Roberta-large-326M-Chinese:https://huggingface.co/IDEA-CCNL/Taiyi-CLIP-Roberta-large-326M-Chinese

-

Taiyi-CLIP-RoBERTa-102M-ViT-L-Chinese:https://huggingface.co/IDEA-CCNL/Taiyi-CLIP-RoBERTa-102M-ViT-L-Chinese

-

Taiyi-CLIP-RoBERTa-326M-ViT-H-Chinese:https://huggingface.co/IDEA-CCNL/Taiyi-CLIP-RoBERTa-326M-ViT-H-Chinese

以 Taiyi-CLIP-Roberta-large-326M-Chinese 为例,IDEA CCNL用中文语言模型替换了开源的英文 CLIP 中语言编码器,在训练过程中冻结了视觉编码器并且只微调这个中文语言模型,在 1 亿级别的中文数据上训练了 24 个 epoch,一共过了约 30 亿中文图文数据,得到了这个包含图片信息的中文表征语言模型,为后续训练中文 Diffusion 相关的模型奠定了重要的基础。

2022 年 10 月,IDEA CCNL开源了第一个中文 Disco Diffusion 模型 Taiyi-Diffusion-532M-Nature-Chinese,该模型由 Katherine Crowson’s 的无条件扩散模型在自然风景图上微调而来。结合 Taiyi-CLIP-Roberta-large-326M-Chinese 可以实现中文生成各种风格的风景图片。

代码:

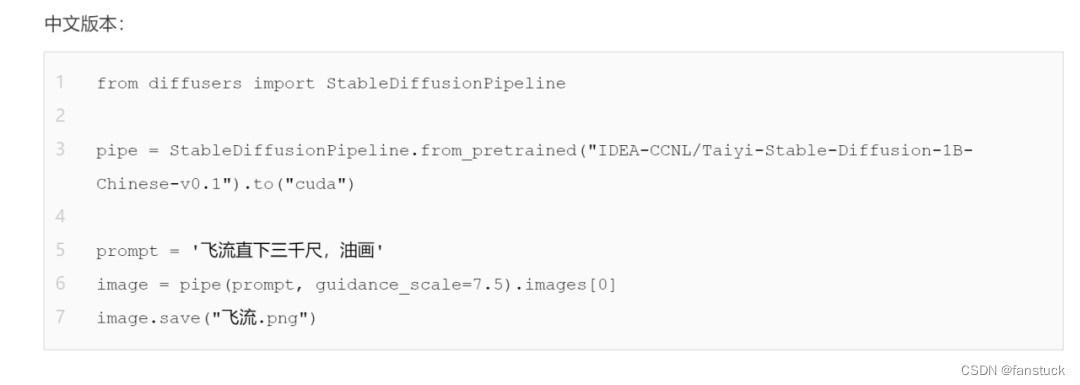

中文版本:

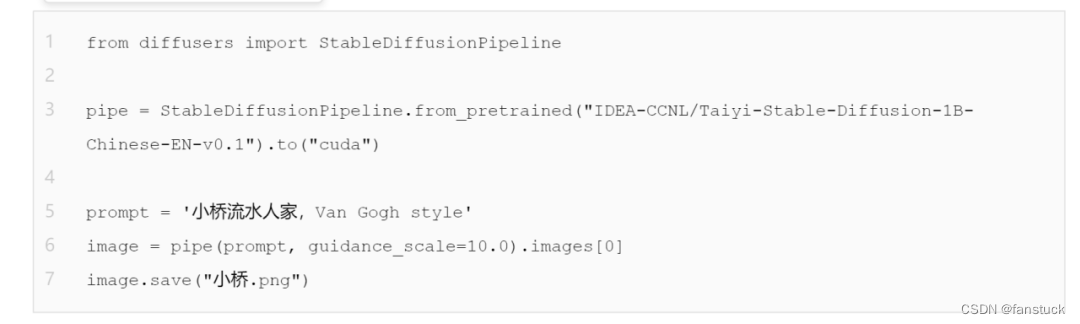

中英双语版本:

如果需要进行古诗场景、中文概念生成,建议尝试中文版本 Taiyi-Stable-Diffusion-1B-Chinese-v0.1。如果需要一些通用场景和概念的生成,尤其是有中文混合英文需要,建议尝试中英双语版本 Taiyi-Stable-Diffusion-1B-Chinese-EN-v0.1。

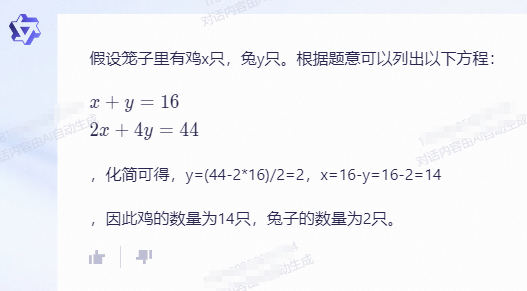

谈到这里,那么只要对于收集到的图片打上特定的情感标签之后,根据输入的语言进行NLP处理,就能输出对应的标签的图片,至于图片的训练和生成则是另一套图片拟合算法了。

1.昆仑万维AIGC

作为中国领先的互联网平台出海企业,昆仑万维近年来在不断夯实出海业务的同时,也在持续加强人工智能等技术的研发投入,加码元宇宙、AIGC、VR,促使多元业务协同发展,让昆仑万维在AIGC赛道取得了突破性进展。目前,昆仑万维海外信息分发及元宇宙平台Opera、海外社交娱乐平台StarX、全球移动游戏平台Ark Games是海外市场的核心业务,在规模上覆盖了一百多个国家,形成全球月活用户数近4亿的庞大业务矩阵。

首先昆仑万维AIGC模型对于中文NLP处理模型使用了Chinese-CLIP。

Chinese-CLIP

随着 CLIP 的提出,多模态预训练近年来发展迅速,但 CLIP 对于特定语言的理解有比较明显的欠缺。

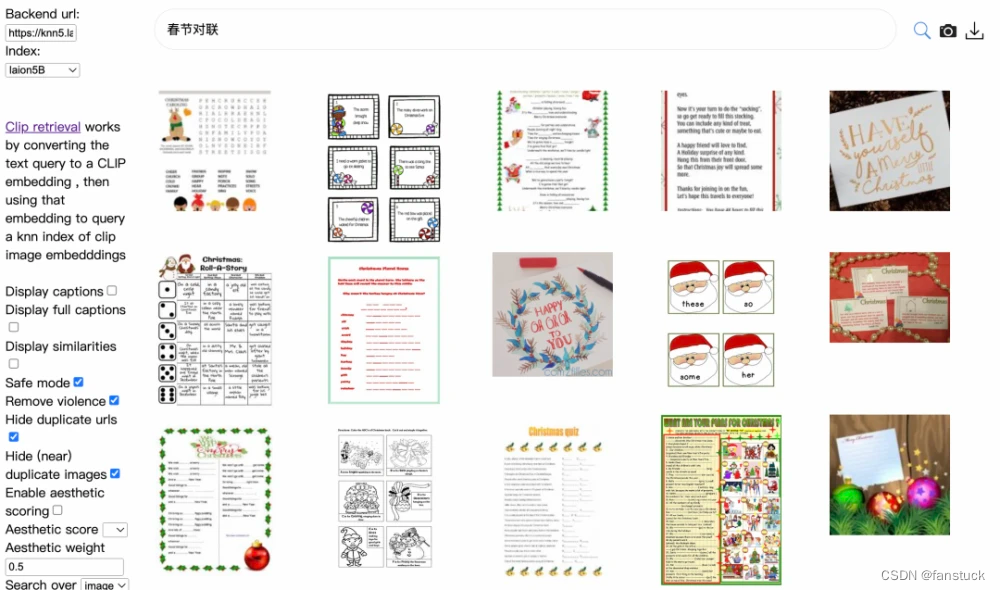

OpenAI CLIP 的预训练主要使用英文世界的图文数据,不能天然支持中文。即便是社区有研究者通过翻译的文本,蒸馏出多语言版本的 Multilingual-CLIP (mCLIP),同样无法很好满足中文世界的需求,对于中文领域的文本理解不很到位,比如搜索“春节对联”,返回的却是圣诞相关的内容:

而Chinese-CLIP 可以在中文跨模态检索取得最优表现,其中在中文原生的电商图像检索数据集 MUGE 上,多个规模的 Chinese CLIP 均取得该规模的最优表现。而在英文原生的 Flickr30K-CN 等数据集上,不论是零样本还是微调的设定下,Chinese CLIP 均能显著地超出国内 Wukong、Taiyi、R2D2 等基线模型。

我们选择:雾气弥漫的森林瀑布:

与其他模型对比以机器翻译评价指标BLEU(BLEU (其全称为Bilingual Evaluation Understudy), 其意思是双语评估替补。所谓Understudy (替补),意思是代替人进行翻译结果的评估。尽管这项指标是为翻译而发明的,但它可以用于评估一组自然语言处理任务生成的文本。)比较。

在自然语言处理中的机器翻译任务中, BLEU非常常见, 它是用于评估模型生成的句子(candidate)和实际句子(reference)的差异的指标.

它的取值范围在0.0到1.0之间, 如果两个句子完美匹配(perfect match), 那么BLEU是1.0, 反之, 如果两个句子完美不匹配(perfect mismatch), 那么BLEU为0.0.

昆仑万维的瑶光模型续写人民日报的BLEU在140亿测评数据集下可以达到9.8,相比其他模型能够在如此庞大的数据集达到这个效果已经很突出了。且扩写LOT-Outgen的bleu能够达到17.27,coverage能够达到47.41,order超出其他模型达到了46.52.这是十分优秀的指标结果,高于孟子和GLM,COM-2相当多。

四个优点结合为:

- 计算代价小, 快.

- 容易理解.

- 与语言无关(这意味着你可以使用中文+英文的语言来测试).

- 高度拟人化

而对于图片模型生成,与其对于检查指标ACG(@R)指标:ACG(Average Cumulative Gain)支持多值相似度(multi-level similarity)。对于一个检索序列 V,其每个位置的 gain 就是该位置样本与 query 的相似度。

其模型文本输入hide77能够达到89%,图片转文本可以达到98%,相比其他模型十分优秀。

2.小结

可喜的是,基于对人工智能技术的前瞻性判断,昆仑万维从2020年开始布局AIGC领域,训练集群200张卡,投入数千万元,组建了二百余人的研发团队,2020年底至2021年4月份研发出百亿参数的中文GPT-3模型,并于2021年8月开始研发基于自有大文本模型的对话机器人;2022年1月启动SkyMusic音乐实验室,2022年4月达到人工智能领域最优效果;2022年9月份启动编程、图像、文本方向的AIGC产品。目前AI图像、AI文本、AI编程的模型已经在GitHub上开源。

昆仑天工开源地址:

Github:https://github.com/SkyWorkAIGC

Huggingface:https://huggingface.co/SkyWork

通过AIGC模型算法方面的技术创新和开拓,开源AIGC算法和模型社区的发展将会越来越壮大,AIGC 技术的发展极大程度上改变创作领域的格局,降低了创作的门槛,这是生产工具的变革,也是生产力的解放,一个新的时代即将到来。