第二次

7.假设有人做了如下的回归:

y i = β 0 ^ + β 1 ^ x i + e i y_i=\widehat{\beta_0}+\widehat{\beta_1}x_i+e_i yi=β0 +β1 xi+ei

其中, y i , x i y_i,x_i yi,xi分别为 Y i , X i Y_i,X_i Yi,Xi关于各自均值的离差。问 β 0 ^ 和 β 1 ^ \widehat{\beta_0}和\widehat{\beta_1} β0 和β1 将分别取何值?

8.记样本回归模型为 Y i = β 0 ^ + β 1 ^ X i + e i Y_i=\widehat{\beta_0}+\widehat{\beta_1}X_i+e_i Yi=β0 +β1 Xi+ei,试证明普通最小二乘法估计的如下数值特征:

(1)估计的Y的均值等于实测的Y的均值: Y ^ = Y ˉ \widehat{Y}=\bar{Y} Y =Yˉ;

(2)点( X ˉ \bar{X} Xˉ, Y ˉ \bar{Y} Yˉ)总在样本回归线上;

(3)残差和为0,从而残差的均值为0: Σ e i \Sigma e_i Σei=0, e ˉ \bar{e} eˉ=0;

(4)残差与X不相关: Σ e i X i = 0 \Sigma e_i {X_i}=0 ΣeiXi=0;

(5)残差与估计的Y不相关: Σ e i Y i ^ = 0 \Sigma e_i \widehat{Y_i}=0 ΣeiYi =0;

(6)残差项与Y离差的估计不相关: Σ e i y i ^ = 0 \Sigma e_i \widehat{y_i}=0 Σeiyi =0;

10.试证明:Y关于X的普通最小二乘回归,其可决系数 R 2 R^2 R2就是X与Y之间线性相关系数r的平方。

7

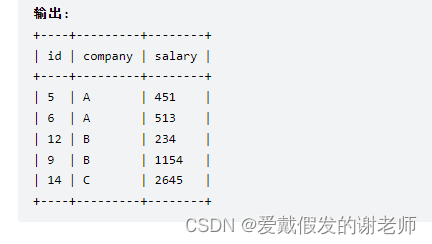

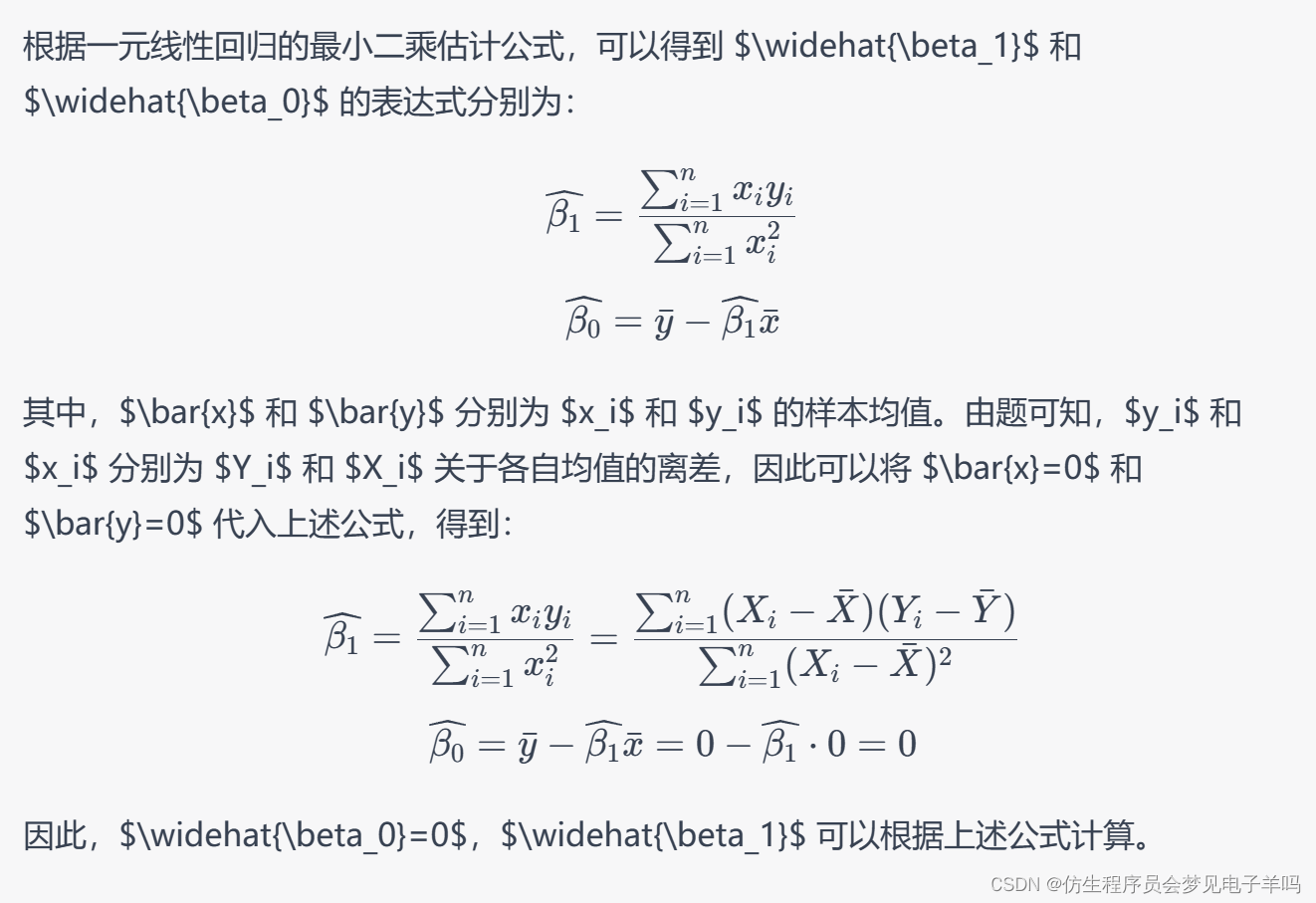

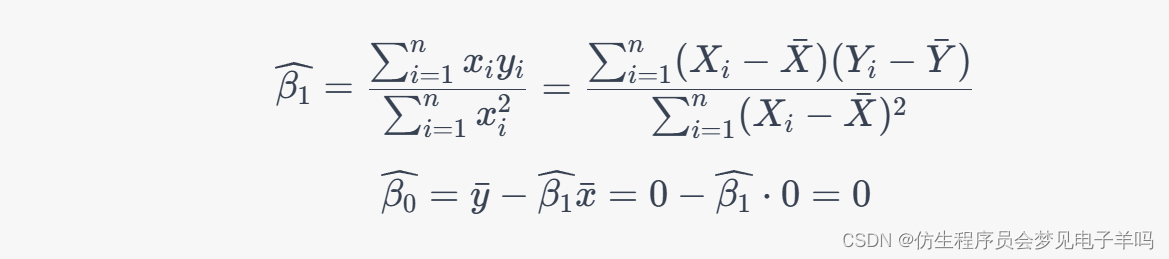

根据一元线性回归的最小二乘估计公式,可以得到 β 1 ^ \widehat{\beta_1} β1 和 β 0 ^ \widehat{\beta_0} β0 的表达式分别为:

其中, x ˉ \bar{x} xˉ 和 y ˉ \bar{y} yˉ 分别为 x i x_i xi 和 y i y_i yi 的样本均值。由题可知, y i y_i yi 和 x i x_i xi 分别为 Y i Y_i Yi 和 X i X_i Xi 关于各自均值的离差,因此可以将 x ˉ = 0 \bar{x}=0 xˉ=0 和 y ˉ = 0 \bar{y}=0 yˉ=0 代入上述公式,得到:

因此, β 0 ^ = 0 \widehat{\beta_0}=0 β0 =0, β 1 ^ \widehat{\beta_1} β1 可以根据上述公式计算。

8

(1)估计的Y的均值等于实测的Y的均值: Y ^ = Y ˉ \widehat{Y}=\bar{Y} Y =Yˉ

根据样本回归模型,我们有:

Y ^ = β 0 ^ + β 1 ^ X \widehat{Y}=\widehat{\beta_0}+\widehat{\beta_1}X Y =β0 +β1 X

其中, β 0 ^ \widehat{\beta_0} β0 和 β 1 ^ \widehat{\beta_1} β1 是通过最小化残差平方和来进行估计的。因此,我们有:

∑ i = 1 n e i 2 = ∑ i = 1 n ( Y i − β 0 ^ − β 1 ^ X i ) 2 \sum_{i=1}^n e_i^2=\sum_{i=1}^n(Y_i-\widehat{\beta_0}-\widehat{\beta_1}X_i)^2 i=1∑nei2=i=1∑n(Yi−β0 −β1 Xi)2

将 Y ^ \widehat{Y} Y 代入上式,得到:

∑ i = 1 n e i 2 = ∑ i = 1 n ( Y i − Y ^ ) 2 \sum_{i=1}^n e_i^2=\sum_{i=1}^n(Y_i-\widehat{Y})^2 i=1∑nei2=i=1∑n(Yi−Y )2

由于 Y ^ \widehat{Y} Y 是通过最小化残差平方和来估计的,因此它是使得 ∑ i = 1 n ( Y i − Y ^ ) 2 \sum_{i=1}^n(Y_i-\widehat{Y})^2 ∑i=1n(Yi−Y )2最小的值。这意味着 Y ^ \widehat{Y} Y 是实际Y的均值 Y ˉ \bar{Y} Yˉ,因为 Y ˉ \bar{Y} Yˉ也是使得 ∑ i = 1 n ( Y i − Y ˉ ) 2 \sum_{i=1}^n(Y_i-\bar{Y})^2 ∑i=1n(Yi−Yˉ)2最小的值。

因此,我们有 Y ^ = Y ˉ \widehat{Y}=\bar{Y} Y =Yˉ。

(2)点( X ˉ \bar{X} Xˉ, Y ˉ \bar{Y} Yˉ)总在样本回归线上

样本回归线可以表示为 Y = β 0 ^ + β 1 ^ X Y=\widehat{\beta_0}+\widehat{\beta_1}X Y=β0 +β1 X。将 X X X替换为 X ˉ \bar{X} Xˉ, Y Y Y替换为 Y ^ \widehat{Y} Y ,得到:

Y ^ = β 0 ^ + β 1 ^ X ˉ \widehat{Y}=\widehat{\beta_0}+\widehat{\beta_1}\bar{X} Y =β0 +β1 Xˉ

由(1)可知, Y ^ = Y ˉ \widehat{Y}=\bar{Y} Y =Yˉ,因此:

Y ˉ = β 0 ^ + β 1 ^ X ˉ \bar{Y}=\widehat{\beta_0}+\widehat{\beta_1}\bar{X} Yˉ=β0 +β1 Xˉ

这意味着点( X ˉ \bar{X} Xˉ, Y ˉ \bar{Y} Yˉ)在样本回归线上。

(3)残差和为0,从而残差的均值为0: Σ e i \Sigma e_i Σei=0, e ˉ \bar{e} eˉ=0

样本回归模型可以表示为 Y i = β 0 ^ + β 1 ^ X i + e i Y_i=\widehat{\beta_0}+\widehat{\beta_1}X_i+e_i Yi=β0 +β1 Xi+ei。将 Y ^ \widehat{Y} Y 代入得到:

e i = Y i − Y ^ = ( Y i − Y ˉ ) − ( Y ^ − Y ˉ ) e_i=Y_i-\widehat{Y}=(Y_i-\bar{Y})-(\widehat{Y}-\bar{Y}) ei=Yi−Y =(Yi−Yˉ)−(Y −Yˉ)

因为 Y ^ = Y ˉ \widehat{Y}=\bar{Y} Y =Yˉ,所以:

e i = ( Y i − Y ˉ ) − ( Y ˉ − Y ^ ) = Y i − Y ˉ e_i=(Y_i-\bar{Y})-(\bar{Y}-\widehat{Y})=Y_i-\bar{Y} ei=(Yi−Yˉ)−(Yˉ−Y )=Yi−Yˉ

因此,

∑ i = 1 n e i = ∑ i = 1 n ( Y i − Y ˉ ) = 0 \sum_{i=1}^n e_i=\sum_{i=1}^n(Y_i-\bar{Y})=0 i=1∑nei=i=1∑n(Yi−Yˉ)=0

这意味着残差的和为0,从而残差的均值为0,即 e ˉ = 0 \bar{e}=0 eˉ=0。

(4)残差与X不相关: Σ e i X i = 0 \Sigma e_i {X_i}=0 ΣeiXi=0

样本回归模型可以表示为 Y i = β 0 ^ + β 1 ^ X i + e i Y_i=\widehat{\beta_0}+\widehat{\beta_1}X_i+e_i Yi=β0 +β1 Xi+ei。将 e i e_i ei代入得到:

Y i − β 0 ^ − β 1 ^ X i = e i Y_i-\widehat{\beta_0}-\widehat{\beta_1}X_i=e_i Yi−β0 −β1 Xi=ei

左右两边同时乘以 X i X_i Xi:

X i Y i − β 0 ^ X i − β 1 ^ X i 2 = X i e i X_iY_i-\widehat{\beta_0}X_i-\widehat{\beta_1}X_i^2=X_ie_i XiYi−β0 Xi−β1 Xi2=Xiei

对所有的 i i i进行求和:

∑ i = 1 n X i Y i − β 0 ^ ∑ i = 1 n X i − β 1 ^ ∑ i = 1 n X i 2 = ∑ i = 1 n X i e i \sum_{i=1}^n X_iY_i-\widehat{\beta_0}\sum_{i=1}^n X_i-\widehat{\beta_1}\sum_{i=1}^n X_i^2=\sum_{i=1}^n X_ie_i i=1∑nXiYi−β0 i=1∑nXi−β1 i=1∑nXi2=i=1∑nXiei

因为最小化残差平方和的条件是 ∑ i = 1 n X i e i = 0 \sum_{i=1}^n X_ie_i=0 ∑i=1nXiei=0,所以:

∑ i = 1 n X i Y i − β 0 ^ ∑ i = 1 n X i −