ChatGPT,作为OpenAI开发的预训练语言模型,主要用于生成自然语言文本的任务。然而,通过一些技巧和策略,我们可以将ChatGPT与图像处理模型结合,实现一定程度上的图像优化和处理。本文将详细介绍如何使用ChatGPT高效处理图片,内容精炼,层次分明,让读者在阅读后有所收获。

一、ChatGPT与图像处理的结合方式

ChatGPT本身并没有直接处理图像的功能,但可以通过以下几种方式结合图像处理技术,实现图像的优化和处理:

-

图像转换为文本描述

使用图像标注工具,如图像描述网络(Image Captioning Networks),将图像转换为与之相关的文本描述。然后,将这些文本描述输入到ChatGPT中,利用其自然语言处理能力对图像进行优化或生成相关的文本描述。

-

生成对抗网络(GANs)或风格迁移

使用GANs或风格迁移方法,将图像转换为另一个风格或样式。再将经过转换的图像输入到ChatGPT中,结合ChatGPT的文本生成能力,实现图像风格的优化或创新。

-

调用外部图像处理库

通过ChatGPT编写脚本,调用外部图像处理库(如OpenCV)中的算法,对图像进行处理。例如,使用Image.ANTIALIAS算法改善画质,或使用AI超分辨率技术将低分辨率图片放大至高分辨率。

二、ChatGPT在图片处理中的具体应用

虽然ChatGPT不是专门用于图像处理的模型,但通过一些技巧,我们仍然可以在图片处理中高效利用ChatGPT的能力。以下是一些具体的应用场景和技巧:

-

AI绘画

ChatGPT可以通过与DALL-E等AI绘画模型的结合,实现一键生成图像的功能。以下是一些使用技巧:

- Prompt(文本描述):通过输入一段详细的文本描述,如“一头奶牛孤零零地站在月球上”,AI模型会根据描述生成相应的图像。

- 分辨率(px):指定生成图像的分辨率,分辨率越高,图像的细节越丰富。

- 风格(Style):通过指定风格,如印象派、超现实主义或某具体艺术家的风格,引导模型生成具有特定美学特征的图像。

- 图像特征(Image Features):可以指定颜色、形状、纹理等图像特征,使生成的图像更符合预期。

- Seed值:提供相同的Seed值和文本描述,可以重现相同的图像,常用于调整细节。

- 纵横比(Aspect Ratio):根据应用场景的需要,指定不同的宽高比。

- 温度参数:控制图像生成的随机性,温度值越高,创新性越大;温度值越低,越稳定,但可能缺乏创意。

- 局部重绘:在图像生成后,可以指定任意一个位置,让ChatGPT修改它,实现图像的局部调整。

-

图像编辑与批量处理

ChatGPT的Code Interpreter是一个强大的数据分析与图像处理工具,用户无需具备专业的编程知识,即可通过自然语言指令实现对图片的批量处理。以下是一些常用的图像编辑功能:

- 批量缩放:根据需要调整图片大小,适用于网站优化、社交媒体分享等场景。

- 批量旋转:统一图片方向,确保图片集合的外观一致性。

- 批量模糊:柔化图片细节,减少噪点,增强艺术效果。

- 图像降噪:改善低质量图片的画质,使图像更加清晰。

使用ChatGPT进行图像编辑的步骤:

- 登录ChatGPT并激活Code Interpreter功能。

- 通过自然语言指令上传图片或指定图片文件夹。

- 输入编辑指令,如“将所有图片放大2倍并保持纵横比”。

- 等待处理完成并下载结果。

对于存储在云端或服务器上的图片,ChatGPT的Image Editor插件提供了更为便捷的编辑方式。该插件支持多种编辑功能,如裁剪、调整亮度对比度、添加滤镜等。

- 在ChatGPT中选择Image Editor插件。

- 输入图片链接或选择已上传的图片。

- 使用插件提供的编辑工具进行编辑。

- 保存并分享编辑后的图片。

-

画质改善

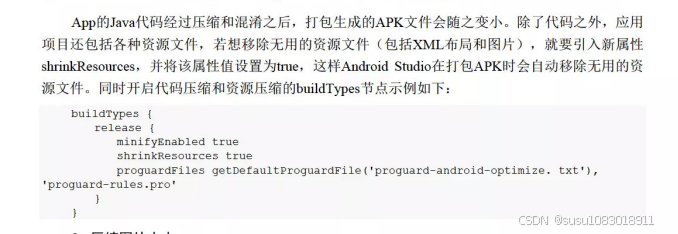

通过调用外部图像处理库(如OpenCV)中的算法,或使用AI超分辨率技术,ChatGPT可以实现画质的改善。

- Image.ANTIALIAS算法:通过平滑处理和细节保留步骤,减少图像的锯齿感和模糊效应。使用ChatGPT编写脚本调用OpenCV库中的Image.ANTIALIAS算法,对需要改善画质的图片进行处理。

- AI超分辨率技术:利用深度学习模型将低分辨率图片放大至高分辨率,同时保持图像的清晰度和细节。将低分辨率图片上传至ChatGPT或指定存储位置,通过ChatGPT调用AI超分辨率服务进行画质提升。

三、图像优化与处理的其他技巧

除了结合ChatGPT进行图像处理外,还有一些通用的图像优化与处理技巧,可以帮助提高图像质量和处理效率:

-

图像大小调整

调整图像的大小是常见的优化方法。通过减少图像的分辨率,可以在保持图像质量的同时减少图像的文件大小,提高网站的加载速度。

-

图像压缩

图像压缩是一种减少图像文件大小的方法。有损压缩会丢失一些图像细节,但可以显著减小文件大小;无损压缩可以保持图像质量,但压缩比可能不如有损压缩高。

-

图像格式选择

选择正确的图像格式也可以帮助优化图片。JPEG适用于复杂的图像,可以提供较好的压缩比;PNG适用于透明图像,保留图像细节;GIF适用于动画图像。

-

图像缓存

使用浏览器缓存可以加速图像的加载速度。当用户首次访问网站时,浏览器会下载图像并将其缓存到本地。在下一次访问相同页面时,浏览器可以直接从缓存中加载图像,减少加载时间。

-

图像优化工具

有许多图像优化工具可用于帮助优化图片,如Photoshop、GIMP和TinyPNG。这些工具可以自动调整图像大小、压缩图像、优化图像格式等。

四、总结

ChatGPT作为一款先进的自然语言处理模型,在图片编辑与画质改善方面展现出了巨大的潜力。通过合理利用ChatGPT的Code Interpreter、Image Editor插件以及结合外部图像处理算法和技术,非专业用户也能轻松实现图片的批量编辑与画质改善。这不仅提高了工作效率,还为图像处理领域带来了更多的可能性和创意空间。

然而,需要注意的是,ChatGPT主要是用于处理自然语言任务的,其对于图像处理的能力相对有限。如果需要更专业、更精确的图像优化结果,建议使用专门的图像处理算法和工具。

通过本文的介绍,读者可以了解到如何利用ChatGPT结合图像处理技术,实现高效的图片处理与优化。希望这些内容能够帮助读者更好地利用ChatGPT的这一功能,提高工作效率,满足工作和生活的需求。