又到每天一期学习爬虫的时间了,作为一名专业的爬虫程序员,今天要跟你们分享一个超实用的技巧,就是利用HTTP爬虫ip来提升高并发数据抓取的速度。听起来有点高大上?别担心,我会用通俗易懂的话来和你们说,让你们秒懂怎么操作的。

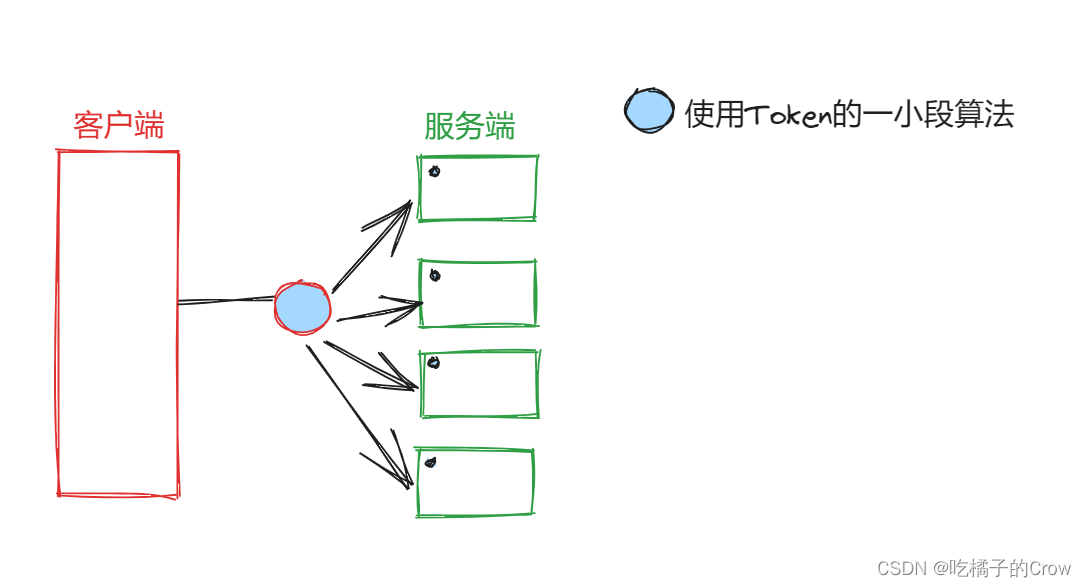

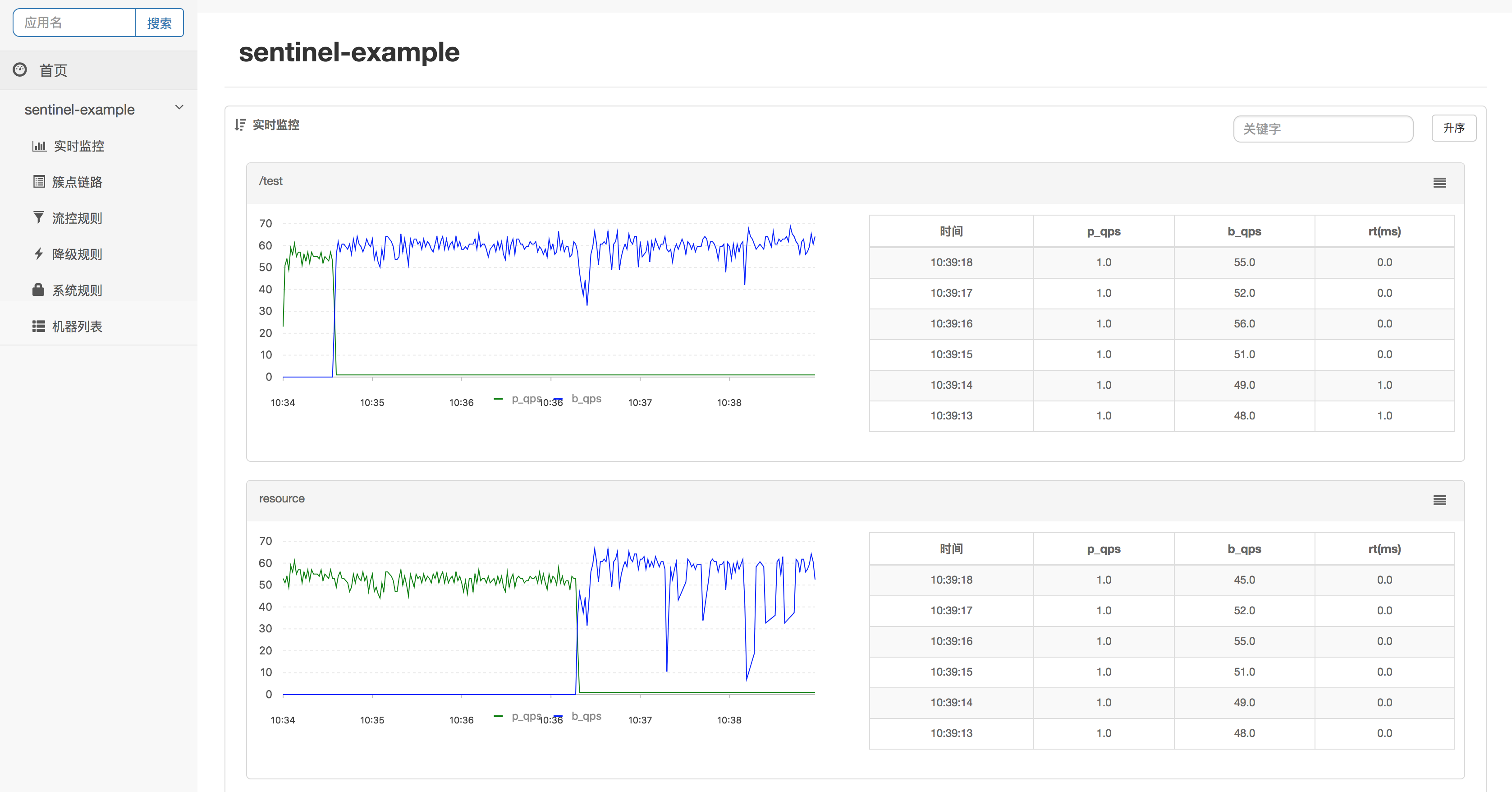

首先,咱们得理解一下为什么HTTP爬虫ip可以加速数据抓取。抓取数据的时候,我们要频繁地发起很多HTTP请求,但网站会对单个IP的请求做限制,这样就影响了抓取的速度。所以,使用HTTP爬虫ip就能绕开这个限制,实现更多请求的并发访问。而且,爬虫ip服务器一般都分布在不同地区,能够减少网络延迟,提高抓取速度。

下面,我要教你们一些使用HTTP爬虫ip来加速抓取的技巧。首先,我们得选一个好的爬虫ip服务器。选爬虫ip服务器要考虑稳定性、速度和地理位置等因素。看下面这个用Python的requests库和random库来随机选爬虫ip的例子:

import requests

import randomproxy_list = [{"http": "http://proxy1.example.com:8080"},{"http": "http://proxy2.example.com:8080"},{"http": "http://proxy3.example.com:8080"},

]url = "http://example.com/data"def send_request(url):proxy = random.choice(proxy_list) # 随机选一个爬虫ipresponse = requests.get(url, proxies=proxy)# 处理响应数据send_request(url)

通过随机选爬虫ip服务器,我们就能够实现请求在多个爬虫ip服务器间平衡分配,从而加快抓取速度。

除了随机选爬虫ip,我们还可以使用连接池来复用爬虫ip连接,进一步加速抓取。看下面这个用Python的requests库和requests_toolbelt库来实现爬虫ip连接池的例子:

import requests

from requests_toolbelt.adapters import HTTPAdapterproxy = "http://proxy.example.com:8080"

url = "http://example.com/data"session = requests.Session()

adapter = HTTPAdapter(max_retries=3, pool_connections=10, pool_maxsize=100) # 设置连接池大小

session.mount("http://", adapter)

session.mount("https://", adapter)response = session.get(url, proxies={"http": proxy})# 处理响应数据

通过使用连接池,我们可以复用爬虫ip连接,减少连接的建立和关闭时间,进一步提升抓取速度。

至此,我们就学会了使用HTTP爬虫ip来加速高并发数据抓取。通过选择好的爬虫ip服务器、随机选用和使用爬虫ip连接池等技巧,我们就能够实现更高效的数据抓取,获得更好的结果。

希望这些技巧能够对你们有用,如果还有其他关于数据抓取的问题,随时提出来,我会尽力为大家解答。祝大家在抓取数据的过程中成功快捷!