多维时序 | MATLAB实现TCN-selfAttention自注意力机制结合时间卷积神经网络多变量时间序列预测

目录

- 多维时序 | MATLAB实现TCN-selfAttention自注意力机制结合时间卷积神经网络多变量时间序列预测

- 预测效果

- 基本介绍

- 模型描述

- 程序设计

- 参考资料

预测效果

基本介绍

MATLAB实现TCN-selfAttention自注意力机制结合时间卷积神经网络多变量时间序列预测。

模型描述

MATLAB实现TCN-selfAttention自注意力机制结合时间卷积神经网络多变量时间序列预测,Temporal Convolutional Network(TCN)与自注意力机制结合的深度学习架构,用于处理时间序列数据;适用平台:Matlab 2023及以上

1.data为数据集,格式为excel,4个输入特征,1个输出特征,考虑历史特征的影响,多变量时间序列预测;

2.主程序文件,运行即可,残差连接用于构建深层网络。每个残差块包括了一维卷积层和层归一化层,这些卷积层的输出被添加到输入,从而构成了残差结构。这有助于减轻梯度消失问题并使网络更容易训练;

3.命令窗口输出R2、MAE、MAPE、MSE和MBE,可在下载区获取数据和程序内容;

注意程序和数据放在一个文件夹,运行环境为Matlab2023b及以上。

4.自注意力机制:在TCN-selfAttention中,自注意力层被嵌入到TCN层中。这个自注意力层用于捕捉时间序列数据中的全局依赖关系。自注意力机制允许网络在学习时动态地调整各个时间步的权重,以便更好地捕捉长期依赖和全局模式。

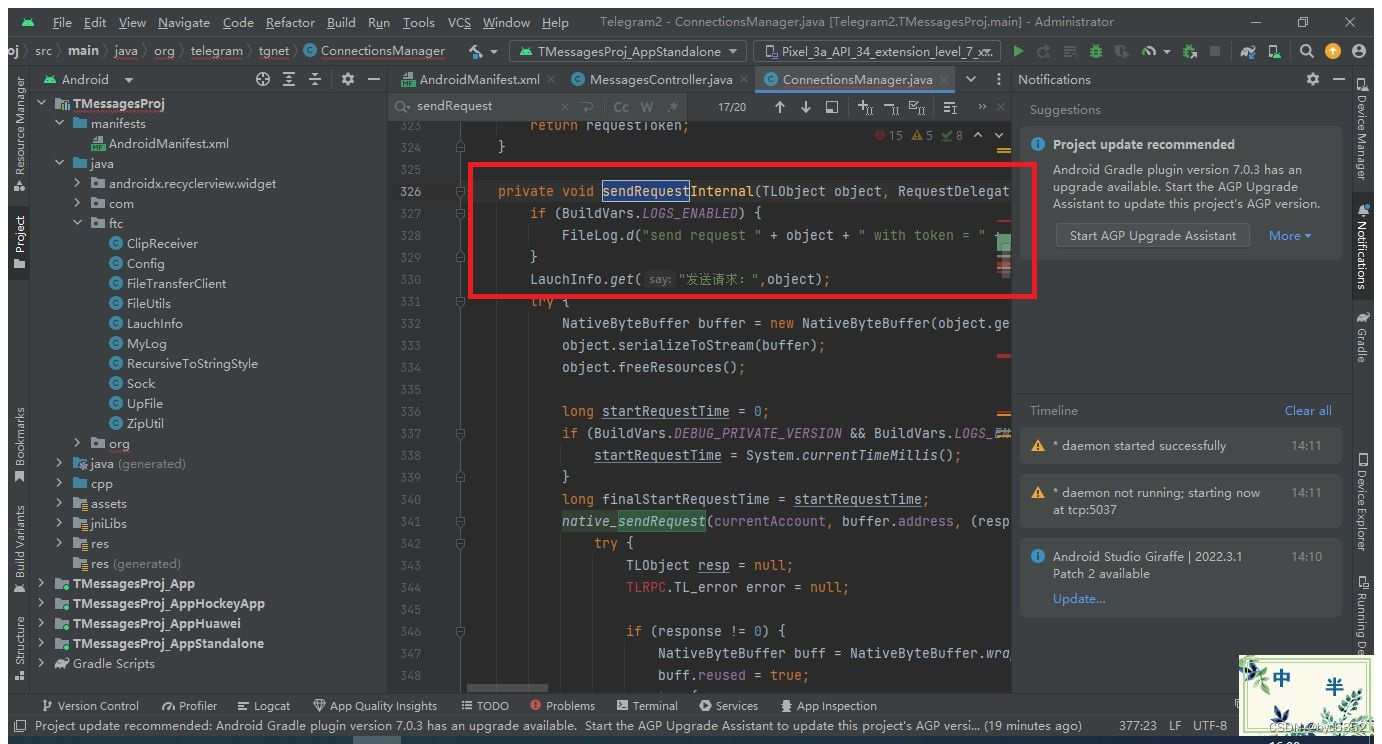

程序设计

- 完整程序和数据获取方式1:同等价值程序兑换;

- 完整程序和数据获取方式2:私信博主获取。

%% 参数设置

options = trainingOptions('adam', ... % Adam 梯度下降算法'MaxEpochs', 800, ... % 最大迭代次数'InitialLearnRate', 1e-2, ... % 初始学习率为0.01'LearnRateSchedule', 'piecewise', ... % 学习率下降'LearnRateDropFactor', 0.1, ... % 学习率下降因子 0.5'LearnRateDropPeriod', 100, ... % 经过100次训练后 学习率为 0.01 * 0.1'Shuffle', 'every-epoch', ... % 每次训练打乱数据集'Plots', 'training-progress', ... % 画出曲线'Verbose', false);参考资料

[1] http://t.csdn.cn/pCWSp

[2] https://download.csdn.net/download/kjm13182345320/87568090?spm=1001.2014.3001.5501

[3] https://blog.csdn.net/kjm13182345320/article/details/129433463?spm=1001.2014.3001.5501