GRU模型

- 1 GRU介绍

- 2 GRU的内部结构图

- 2.1 GRU结构分析

- 2.2 Bi-GRU介绍

- 2.3 使用Pytorch构建GRU模型

- 2.4 GRU优缺点¶

- 3 RNN及其变体

1 GRU介绍

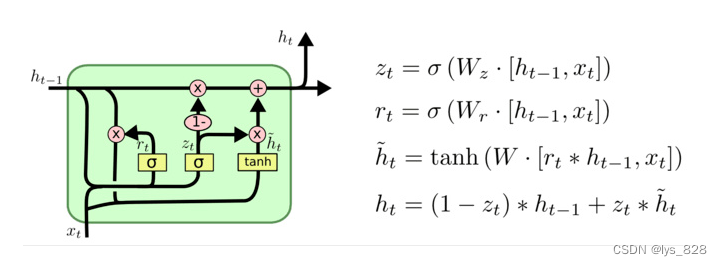

GRU(Gated Recurrent Unit)也称门控循环单元结构, 它也是传统RNN的变体, 同LSTM一样能够有效捕捉长序列之间的语义关联, 缓解梯度消失或爆炸现象. 同时它的结构和计算要比LSTM更简单, 它的核心结构可以分为两个部分去解析:

- 更新门

- 重置门

2 GRU的内部结构图

2.1 GRU结构分析

有了前面RNN和LSTM模型的理解,对于GRU的结构认知理解就简单多了。

当Zt=1,表示完全使用本次隐藏层信息

当Zt=1,表示完全使用本次隐藏层信息

当Zt=0,表示完全使用上一个隐藏层信息

结构解释图:

![[单片机课程设计报告汇总] 单片机设计报告常用硬件元器件描述](https://img-blog.csdnimg.cn/img_convert/b94bcf979e91565fc3dbc20af59a6dc3.jpeg)