在人工智能领域,清华技术成果转化的公司智谱AI启动了支持中英双语的对话机器人ChatGLM内测。ChatGLM是一个初具问答和对话功能的千亿中英语言模型, 并针对中文进行了优化,现已开启邀请制内测,后续还会逐步扩大内测范围。

ChatGLM可以很轻松地部署在本地的硬件上,当时采用的是THUDM/chatglm-6b-int4。(使用的时候,需要安装一些特定的Python包,按提示安装即可。)

为了后续的学习和再训练,我们直接使用完整的ChatGLM存档结构,代码如下:

from transformers import AutoTokenizer, AutoModel

names = ["THUDM/chatglm-6b-int4","THUDM/chatglm-6b"]

tokenizer = AutoTokenizer.from_pretrained("THUDM/chatglm-6b", trust_remote_code=True)

model = AutoModel.from_pretrained("THUDM/chatglm-6b", trust_remote_code=True).half().cuda()

response, history = model.chat(tokenizer, "你好", history=[])

print(response)

print("-----------------------")

response, history = model.chat(tokenizer, "晚上睡不着应该怎么办", history=history)

print(response)

从打印结果来看,此时的展示结果与chatglm-6b-int4没有太大差别。

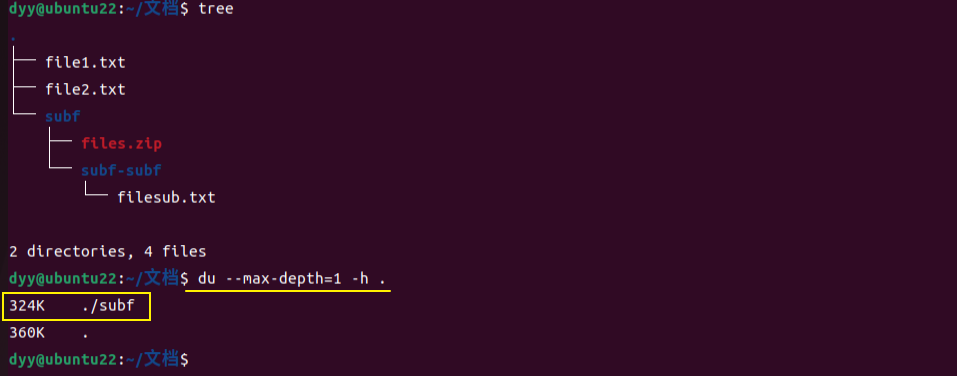

可以直观地看到,此时的下载较烦琐,下载文件被分成了8部分,依次下载,然后将其系统地合并,如图16-4所示。

需要注意的是,对于下载的存档文件还需要进行合并处理,展示如图16-5所示。

图16-5 对下载的存档文件进行合并处理

最终展示的结果如图16-6所示。

图16-6 最终展示的结果

请读者自行打印验证这部分内容。需要注意的是,即使问题是一样的,但是回答也有可能不同,因为我们所使用的ChatGLM是生成式模型,前面的生成直接影响了后面的生成,而这一点也是生成模型不好的地方,前面的结果有了波动,后面就会发生很大的变化,会产生滚雪球效应。

前面简单向读者介绍了ChatGLM的使用,除此之外,ChatGLM还有很多可以胜任的地方,例如进行文本内容的抽取,读者可以尝试如下任务:

content="""ChatGLM-6B 是一个开源的、支持中英双语的对话语言模型,

基于 General Language Model (GLM) 架构,具有 62 亿参数。

手机号 18888888888

结合模型量化技术,用户可以在消费级的显卡上进行本地部署(INT4 量化级别下最低只需 6GB 显存)。

ChatGLM-6B 使用了较 ChatGPT 更为高级的技术,针对中文问答和对话进行了优化。

邮箱 123456789@qq.com

经过约 1T 标识符的中英双语训练,辅以监督微调、反馈自助、人类反馈强化学习等技术的加持,

账号:root 密码:xiaohua123

62 亿参数的 ChatGLM-6B 已经能生成相当符合人类偏好的回答,更多信息请参考我们的博客。

"""

prompt='从上文中,提取"信息"(keyword,content),包括:"手机号"、"邮箱"、"账号"、"密码"等类型的实体,输出json格式内容'

input ='{}\n\n{}'.format(content,prompt)

print(input)

response, history = model.chat(tokenizer, input, history=[])

print(response)

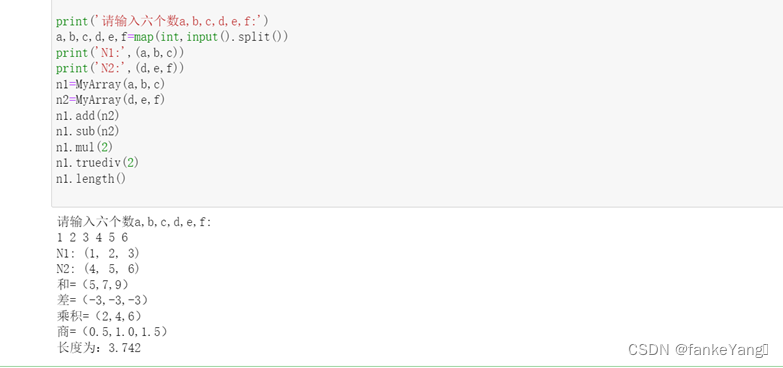

这是一个经典的文本抽取任务,希望通过ChatGLM抽取其中的内容,在这里我们使用了一个Prompt(中文暂时称为“提示”),Prompt是研究者为了下游任务设计出来的一种输入形式或模板,它能够帮助ChatGLM“回忆”起自己在预训练时“学习”到的东西。

Prompt也可以帮助使用者更好地“提示”预训练模型所需要做的任务,在这里我们通过Prompt的方式向ChatGLM传达一个下游任务目标,即需要其对文本进行信息抽取,抽取其中蕴含的手机、邮箱、账号、密码等常用信息。最终显示结果如图16-7所示。

图16-7 对文本进行信息抽取

可以看到,这是一个使用JSON格式表示的抽取结果,其中的内容根据Prompt中的定义提供了相应的键-值对,直接抽取了对应的信息。

本文节选自《从零开始大模型开发与微调:基于PyTorch与ChatGLM》,获出版社和作者授权共享。

![[数据结构进阶 C++] 二叉搜索树(BinarySearchTree)的模拟实现](https://img-blog.csdnimg.cn/direct/efaab4a79d7f41adbb3319c84928eccd.png)