1. 参考博客:1. Ollama完整教程:本地LLM管理、WebUI对话、Python/Java客户端API应用:https://blog.csdn.net/python122_/article/details/1409457202. https://gitee.com/ai-big-model/ollama/tree/main --》REST APIollama 离线安装包 ollama-linux-amd64.tgz 下载地址:https://github.com/ollama/ollama/releases --》v0.3.11 --》ollama-linux-amd64.tgz--》复制链接地址--》https://github.com/ollama/ollama/releases/download/v0.3.11/ollama-linux-amd64.tgz --》迅雷下载( 离线安装请参考:https://blog.csdn.net/meanshe/article/details/142311569 )cd /soft/ollamatar -zxf ollama-linux-amd64.tgz -C /usr/localvim ~/.bashrctodo export OLLAMA_HOST=http://127.0.0.1:11434生成式 API 请求示例:curl http://localhost:11434/api/generate -d '{"model": "llama2","prompt":"Why is the sky blue?"}'聊天式 API 请求示例:curl http://localhost:11434/api/chat -d '{"model": "mistral","messages": [// role = "system" 的 content 应该指的就是 提示词!!!{ "role": "user", "content": "why is the sky blue?" }]}'ollama 学习笔记

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.rhkb.cn/news/23659.html

如若内容造成侵权/违法违规/事实不符,请联系长河编程网进行投诉反馈email:809451989@qq.com,一经查实,立即删除!相关文章

Mesh自组网技术及应用

前言:

Mesh自组网随着无线技术发展,在消费领域最近比较有热度。当然应用的场景不限于普通消费领域,在工业、军事领域被也是越来越重要。 一、什么是无线Mesh技术

1.1 无线自组网概念 无线Mesh是一种智能、自组织、多跳、移动、对等、去中心…

Python游戏编程之赛车游戏6-3

1 “敌人”汽车类的创建

在创建玩家汽车类之后,接下来创建“敌人”汽车类。“敌人”汽车类与玩家类一样,也是包含两个方法,一个是__init__(),另一个是move()。

1.1 __init__()方法

“敌人”汽车类的__init__()方法代码如图1所示…

垂类大模型微调(二):使用LLaMA-Factory

上一篇博文和大家一起安装了LLaMA-Factory工具,并下载了大模型在上面进行了简单的加载和推理,今天尝试通过LoRa技术对大模型进行微调;

一、训练集准备

1.1 介绍训练集结构 这里演示对Qwen2.5-0.5B-Instruct-GPTQ-Int4模型进行LoRA微调, 大家可以根据垂类大模型微调(一)…

什么是MySql的主从复制(主从同步)?

主页还有其他面试题总结,有需要的可以去看一下,喜欢的就留个三连再走吧~

1.什么是MySql的主从复制原理? 主从复制的核心就是二进制binlog(DDL(数据定义语言)语句和DML(数据操纵语言)…

坐标变换及视图变换和透视变换(相机透视模型)

文章目录 2D transformationScaleReflectionShear(切变)Rotation around originTranslationReverse变换顺序复杂变换的分解 齐次坐标(Homogenous Coordinates)3D transformationScale&TranslationRotation Viewing / Camera t…

Unity Shader 学习13:屏幕后处理 - 使用高斯模糊的Bloom辉光效果

目录

一、基本的后处理流程 - 以将画面转化为灰度图为例

1. C#调用shader

2. Shader实现效果

二、Bloom辉光效果

1. 主要变量

2. Shader效果

(1)提取较亮区域 - pass1

(2)高斯模糊 - pass2&3

(3ÿ…

PING命令TTL解析

在 ping 命令中,TTL(Time to Live,生存时间) 是 IP 数据包的核心字段之一,用于控制数据包在网络中的生命周期。以下是针对 TTL 的简明解析:

1. TTL 的核心作用

防循环机制:TTL 是一个计数器&a…

Linux 第三次脚本作业

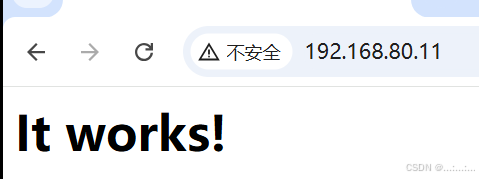

源码编译安装httpd 2.4,提供系统服务管理脚本并测试(建议两种方法实现) 一、第一种方法

1、把 httpd-2.4.63.tar.gz 这个安装包上传到你的试验机上 2、 安装编译工具

(俺之前已经装好了) 3、解压httpd包 4、解压后的httpd包的文…

(七)趣学设计模式 之 适配器模式!

目录 一、 啥是适配器模式?二、 为什么要用适配器模式?三、 适配器模式的实现方式1. 类适配器模式(继承插座 👨👩👧👦)2. 对象适配器模式(插座转换器 🔌…

【NLP】注意力机制

目录

一、认识注意力机制

1.1 常见注意力计算规则

1.2 注意力机制的作用

1.3 注意力机制代码实现

二、注意力机制原理

2.1 attention计算过程

2.2 attention的计算逻辑

2.3 有无attention模型对比

2.3.1 无attention机制的模型

2.3.2 有attention机制的模型

三、Se…

Spring Boot 整合 Druid 并开启监控

文章目录

1. 引言2. 添加依赖3. 配置数据源4. 开启监控功能5. 自定义 Druid 配置(可选)6. 访问监控页面7. 注意事项8. 总结

Druid 是一个由阿里巴巴开源的高性能数据库连接池,它不仅提供了高效的连接管理功能,还自带了强大的监控…

红帽7基于kickstart搭建PXE环境

Kickstart 文件是一种配置文件,用于定义 Linux 系统安装过程中的各种参数,如分区、网络配置、软件包选择等。system-config-kickstart 提供了一个图形界面,方便用户快速生成这些配置文件。

用户可以通过图形界面进行系统安装的详细配置&…

C/C++跳动的爱心

系列文章

序号直达链接1C/C李峋同款跳动的爱心2C/C跳动的爱心3C/C经典爱心4C/C满屏飘字5C/C大雪纷飞6C/C炫酷烟花7C/C黑客帝国同款字母雨8C/C樱花树9C/C奥特曼10C/C精美圣诞树11C/C俄罗斯方块小游戏12C/C贪吃蛇小游戏13C/C孤单又灿烂的神14C/C闪烁的爱心15C/C哆啦A梦16C/C简单…

MongoDB 简介

MongoDB 是一种高性能、开源的 NoSQL 数据库,以其灵活的文档模型和强大的扩展性而闻名。 1.MongoDB 是什么

MongoDB 是一种 NoSQL 数据库,采用 文档模型 存储数据,支持灵活的 JSON 格式文档。它无需预定义表结构,能够动态调整数据…

记录首次安装远古时代所需的运行环境成功npm install --save-dev node-sass

最开始的报错: 最后根据报错一步步 安装所需要的pythong之类的环境,最后终于成功了,得以让我在github上拉的vuehr项目(狗头18年还是20年的远古项目)成功本地运行,最后附上本地运行成功的贴图。如果大家也在…

华为guass在dbever和springboot配置操作

下面记录华为guass在dbever和springboot配置操作,以备忘。

1、安装dbeaver-ce-23.2.0-x86_64-setup.exe和驱动程序 Download | DBeaver Community

2、配置高斯数据库驱动 3、新建数据库连接 4、操作指引 opengauss官方文档

https://docs-opengauss.osinfra.cn/zh…

今日运维之-Mac笔记本python环境问题

1. 问题:MAC升级系统后git报错?

Error: Cant create update lock in /usr/local/var/homebrew/locks!

Fix permissions by running:sudo chown -R $(whoami) /usr/local/var/homebrew

Traceback (most recent call last):11: from /usr/local/Homebrew/…

c3p0、Druid连接池+工具类 Apache-DbUtils (详解!!!)

数据库连接池是在应用程序启动时创建一定数量的数据库连接,并将这些连接存储在池中。当应用程序需要与数据库通信时,它可以向池中请求一个连接,使用完后将连接归还给池,而不是关闭连接。这样可以减少创建和关闭连接的开销…

数仓搭建实操(传统数仓oracle):DWD数据明细层

数据处理思路

DWD层, 数据明细层>>数据清洗转换, 区分事实表,维度表 全是事实表,没有维度表>>不做处理

数据清洗>>数据类型varchar 变成varchar2, 日期格式统一(时间类型变成varchar2); 字符数据去空格 知识补充:

varchar 存储定长字符类型 ; 存储的数据会…

推荐文章

- 鸿蒙Harmony json转对象(1)

- #渗透测试#批量漏洞挖掘#致远互联AnalyticsCloud 分析云 任意文件读取

- (算法竞赛)使用广度优先搜索(BFS)解决迷宫最短路径问题

- [c语言日寄]赋值操作对内存的影响

- [Unity 热更方案] 使用Addressable进行打包管理, 使用AssetBundle进行包的加载管理.70%跟练

- [论文阅读] (36)CS22 MPSAutodetect:基于自编码器的恶意Powershell脚本检测模型

- 《鸿蒙Next应用商店:人工智能开启智能推荐与运营新时代》

- 《运维:技术的基石,服务的保障》

- 【2024年华为OD机试】(C卷,100分)- 攀登者1 (Java JS PythonC/C++)

- 【AIGC】在VSCode中集成 DeepSeek(OPEN AI同理)

- 【AI学习】关于 DeepSeek-R1的几个流程图

- 【C语言】指针(5)