🍅 点击文末小卡片 ,免费获取网络安全全套资料,资料在手,涨薪更快

学习网络安全,对于想要进入IT行业的朋友们来说是一件非常重要的事情。尤其是在当今社会,互联网已经渗透到工作和生活的方方面面,因此网络安全问题也变得越加严重,在此背景下人才需求量也大幅增长,培训机构也越来越多。那么参加网络安全培训需要什么基础?以下是详细内容介绍。

参加网络安全培训需要什么基础?

首先,我想要告诉大家,参加网络安全培训无需任何基础,0基础即可学习,只要你对网络安全感兴趣即可。

因为在网络安全培训机构学习技术,都是从零开始教学的,相对于基础而言,我们更应该重视年龄和学历、学习内容和实战项目,这些在后期找工作的作用比较大。当然了,如果你具有一定的计算机和英语基础会更好,学习起来会容易些。

如果你有英文基础,可以更专注于网络安全技术的学习,而不是在学习的过程中看不懂英文,然后找工具翻译或者背单词,这样很容易分心,影响学习的效果。如果你具备一定的Windows或者Linux基础、网络基础等知识,那么在学习的过程中你会更加得心应手,可以更专注于更深更广的技术学习,上手也会更快一些。

总而言之,无论你有没有基础,都可以学习网络安全,并通过培训获得一份满意的工作。

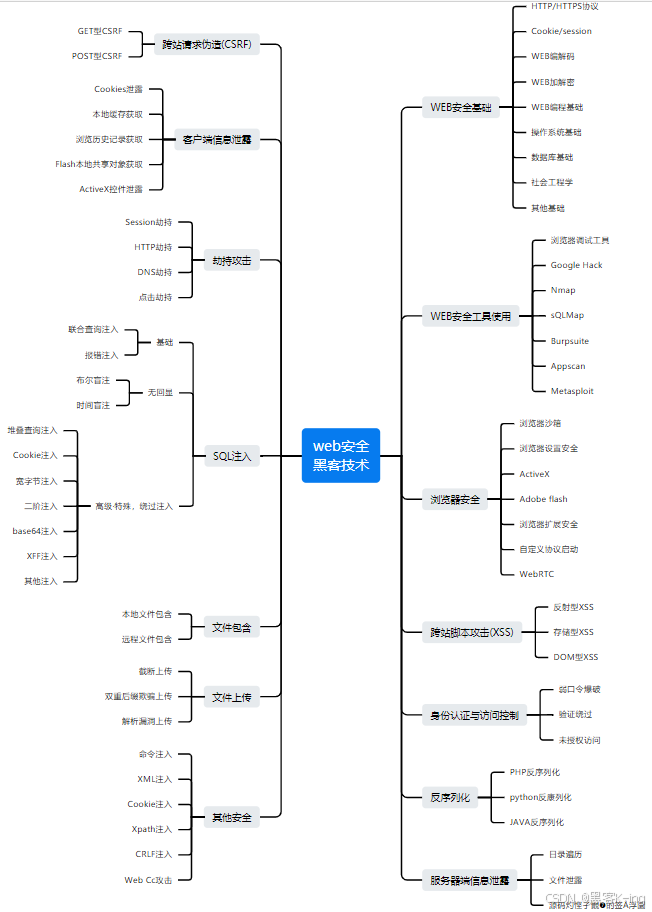

最后感谢每一个认真阅读我文章的人,礼尚往来总是要有的,虽然不是什么很值钱的东西,如果你用得到的话可以直接拿走:

上述所有都有配套的资料,这些资料,对于做【网络安全】的朋友来说应该是最全面最完整的备战仓库,这个仓库也陪伴我走过了最艰难的路程,希望也能帮助到你!凡事要趁早,特别是技术行业,一定要提升技术功底。