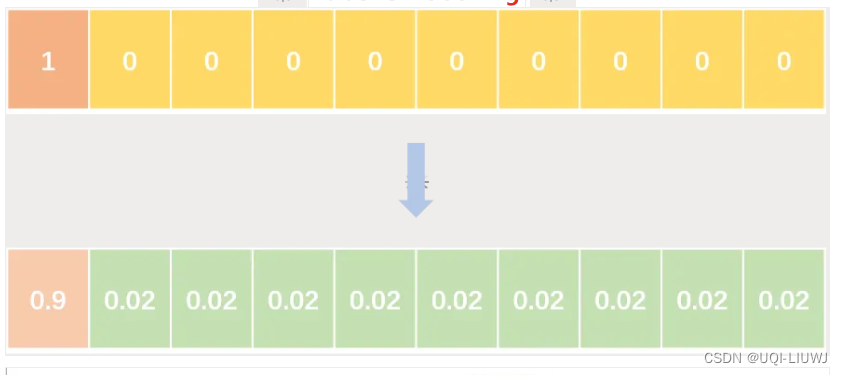

- 在传统的分类任务中,我们通常使用硬标签(hard labels)

- 即如果一个样本属于某个类别,其对应的标签就是一个全0的向量,除了表示这个类别的位置为1。

- 例如,在一个3类分类任务中,某个样本的标签可能是 [0,1,0]

- Label Smoothing 的思想是将这些硬标签替换为软标签(soft labels)。

- 例如,对于上述的三类问题,我们可以将标签 [0,1,0]转换为 [0.1,0.8,0.1]

- 这样做的效果是降低模型对于标签的绝对信任度,鼓励模型学习到更加平滑的概率分布

- ——>通过鼓励模型学习更加不确定的预测,Label Smoothing 可以帮助模型在未见数据上表现得更好

![[AI Omost] 革命性AI图像合成技术,让你的创意几乎一触即发!](https://img-blog.csdnimg.cn/img_convert/d14e184357f67e0865c0dd44974f0ef1.png)