本文来自《老饼讲解-BP神经网络》https://www.bbbdata.com/

目录

- 一、 CNN的基础卷积计算

- 1.1.一个例子了解CNN的卷积计算是什么

- 1.2.卷积层的生物意义

- 二、卷积的拓展:多输入通道与多输出通道

- 2.1.多输入通道卷积

- 2.2.多输出通道卷积

- 三、卷积的实现

- 3.1.pytorch实现卷积计算-例子

- 3.2.Conv2d函数的使用方法

卷积计算是CNN中最基本的计算,它是卷积层最重要的组成部分,

下面讲讲CNN的卷积计算过程是什么样的,包括基础卷积计算、多通道卷积计算以及pytorch中的卷积计算。

一、 CNN的基础卷积计算

卷积层是卷积神经网络中最基础的层,基础卷积的计算就是通过一个卷积核对输入进行卷积计算

1.1.一个例子了解CNN的卷积计算是什么

要了解什么是CNN的卷积基础计算,直接通过一个例子来算一算,就一清二楚。

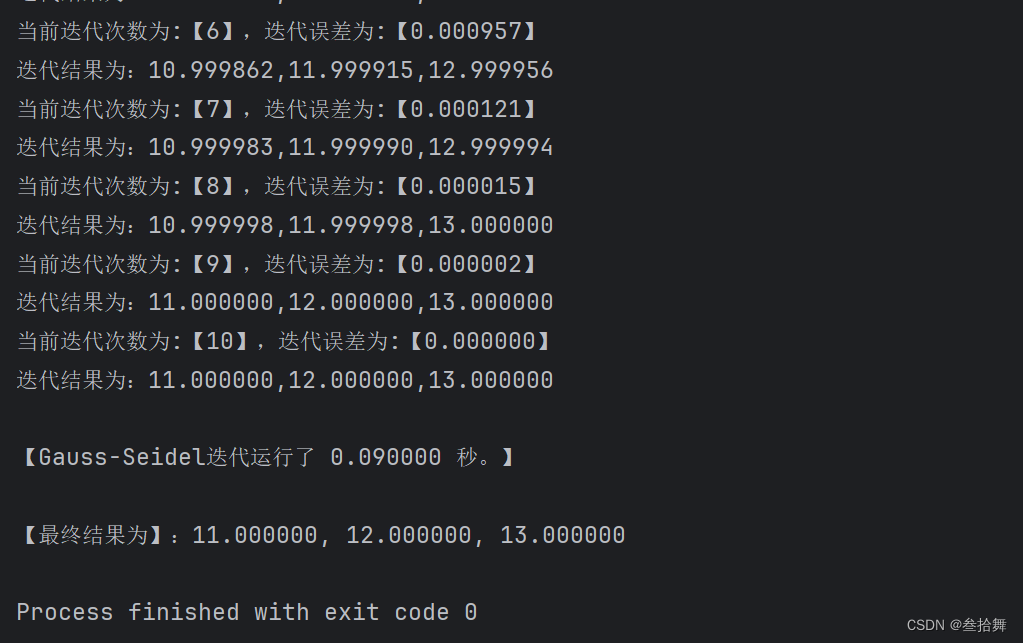

一个卷积计算结果示例如下:

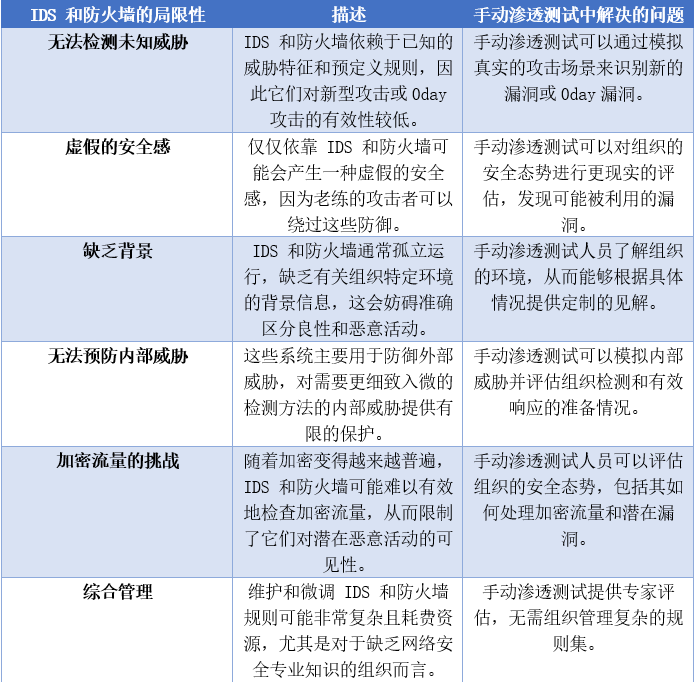

下面详细讲讲上面的卷积结果的具体计算过程:

卷积层中的卷积核就是一个矩阵,直观来看它就是一个窗口,卷积窗口一般为正方形,即长宽一致,

卷积运算通过从左到右,从上往下移动卷积核窗口,将窗口覆盖的每一小块输入进行加权,作为输出

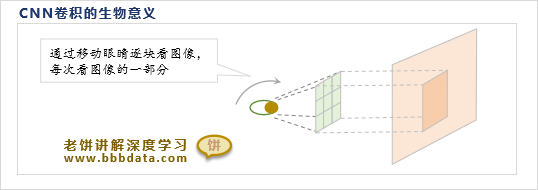

1.2.卷积层的生物意义

卷积核在生物上的意义就相当于动物的眼睛(接受器),

卷积核的大小就相当于眼睛的视野范围(接受野),卷积核的权重就相当于眼睛每一处的接收权重

由于视野有限,所以需要通过逐步移动来查看所有内容,其中眼睛移动的步幅就是卷积的步幅

二、卷积的拓展:多输入通道与多输出通道

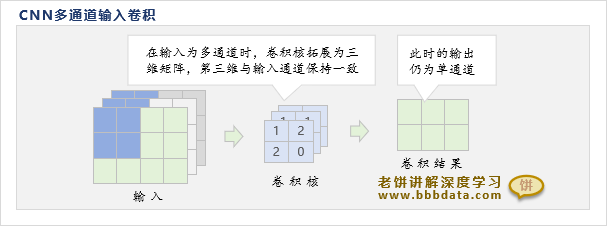

2.1.多输入通道卷积

卷积计算支持多通道的输入,当输入为k个通道的时,卷积核为3维矩阵,第3维与输入通道保持一致

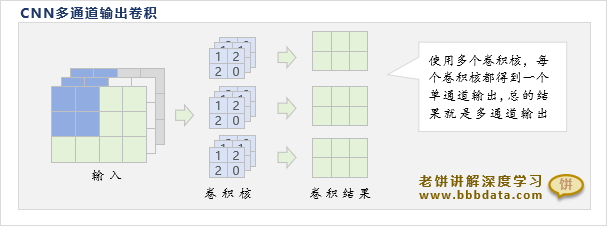

2.2.多输出通道卷积

卷积计算也支持多通道输出,需要输出多少个通道,就使用多少个卷积核就可以了

三、卷积的实现

3.1.pytorch实现卷积计算-例子

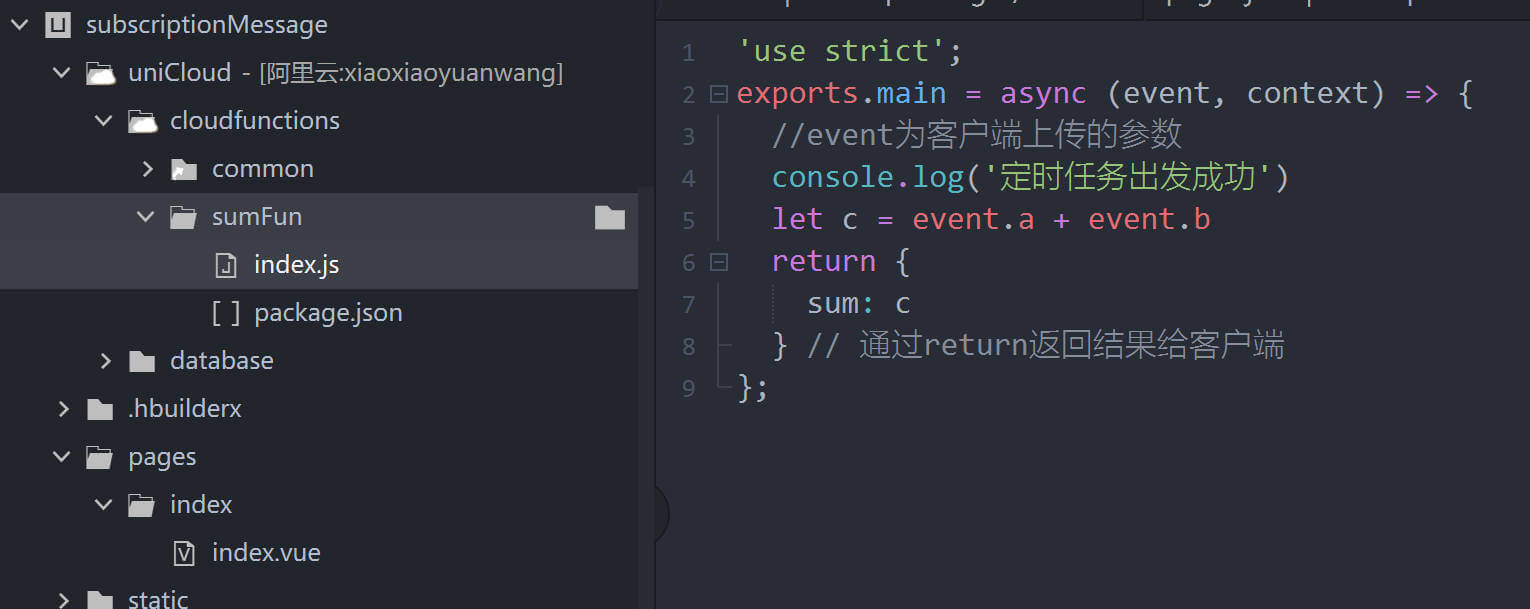

pytorch中使用torch.nn.Conv2d函数来实现卷积的计算

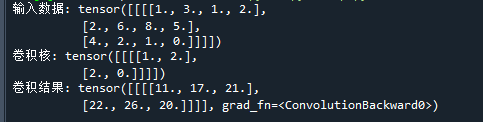

以上述卷积为例,在pytorch中可以如下实现:

import torch

X = torch.tensor([[[[1,3,1,2],[2,6,8,5],[4,2,1,0]]]], dtype=torch.float32) # 输入数据

c = torch.nn.Conv2d(1, 1, kernel_size=(2,2),bias = False) # 初始化卷积类

c.weight.data =torch.tensor([[[[1,2],[2,0]]]], dtype=torch.float32) # 设置权重

out = c(X) # 对输入进行卷积计算

#-------------打印结果-----------------------

print('输入数据:',X)

print('卷积核:',c.weight.data)

print('卷积结果:',out)

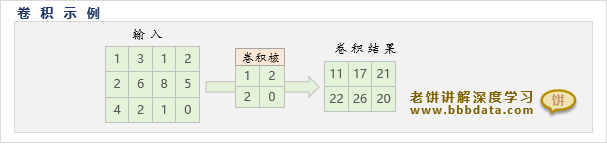

运行结果如下:

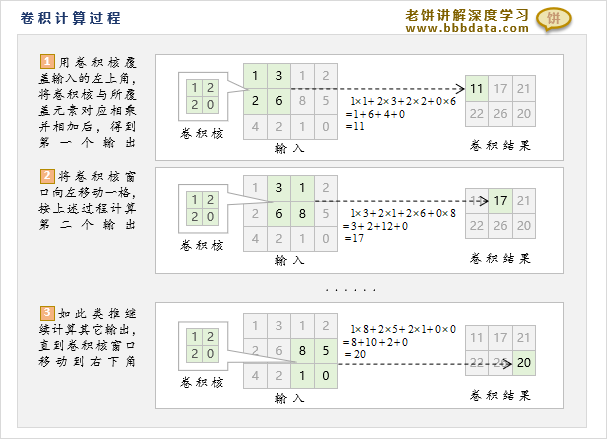

3.2.Conv2d函数的使用方法

Conv2d函数的完整入参如下:

torch.nn.Conv2d(in_channels,out_channels,kernel_size,stride = 1,padding = 0,dilation = 1,groups = 1,bias = True,padding_mode = 'zeros',device = None,dtype = None)

各个参数的解释如下:

in_channels (int) :图象的通道数,也就是决定卷积核的通道数out_channels (int) :卷积输出的通道数,也就是用多少个卷积核kernel_size (int/tuple):卷积核的大小,输入5指5*5的卷积核,输入(3,4)指3*4的卷积核stride (int/tuple):卷积核的步距padding(int/tuple/str):边缘填充的象素数,5指上下左右都补充5个象素,(3,4)代表上下补充3象素,左右补3象素padding_mode (str) :象素填充的方式,可选择项- 'zeros', 'reflect', 'replicate','circular'dilation(int/tuple):"扩张卷积"的专用参数-扩张率,控制kernel各点之间的间隔数量groups(int):Number of blocked connections from input channels to output channels. Default: 1bias(bool):是否对卷积结果添加偏置

*详细可进一步查看 《Conv2d的官方说明》

相关链接:

《老饼讲解-机器学习》:老饼讲解-机器学习教程-通俗易懂

《老饼讲解-神经网络》:老饼讲解-matlab神经网络-通俗易懂

《老饼讲解-神经网络》:老饼讲解-深度学习-通俗易懂