多模态研究如今愈发火热,已成为各大顶级会议的投稿热门。今天,我为大家提供一个多模态的创新思路:迁移学习与多模态融合。

迁移学习+多模态融合方向的优势

1.提升模型性能:综合更多维度优势,跨模态互补

2.快速适应新任务:知识迁移,减少新任务所需的数据量,加速模型训练过程。适应性强,能够更好地应对新环境的变化。

3.更有效的信息融合:最大化不同模态之间的互信息,协同学习。

4.高准确率:实证验证,广泛适用性。

需要的同学添加公众号【沃的顶会】 回复 多模态迁移 即可全部领取

A Multimodal Transfer Learning Approach Using PubMedCLIP for Medical Image Classification

文章解析:

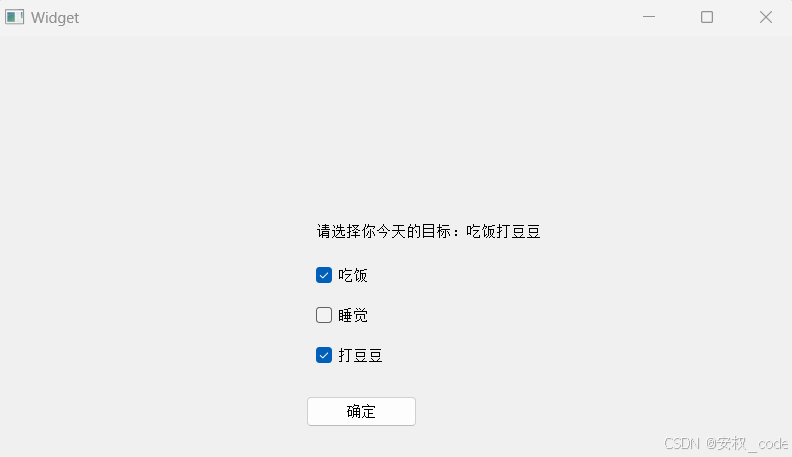

论文提出了一种新的医学图像分类的迁移学习方法,通过结合预训练的PubMedCLIP模型和多模态特征融合,提出了一个多模态学习框架,通过将图片和文本输入进行特征融合,提高了图像分类的准确性,并降低了标注成本。实验证明该方法在不同医学图像数据集上实现了准确率超过90%的优异性能。

创新点:

1.提出了一种有效利用图像标签进行模型训练的方法,通过将文本提示与图像内容相连接,以提高性能。

2.通过逐渐增加提示模板中的上下文信息来改进模型的性能。

3.提出了一种新的特征融合方法,以进一步提高模型的性能。

需要的同学添加公众号【沃的顶会】 回复 多模态迁移 即可全部领取

AdaRank: Disagreement Based Module Rank Prediction for Low-rank Adaptation

文章解析:

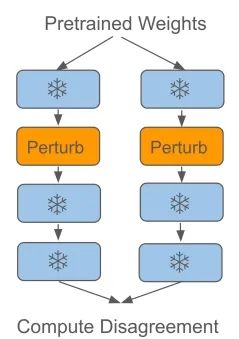

随着语言和多模态模型规模的不断扩大,预训练通用基础模型并将其适应于下游任务已成为普遍做法。由于大模型的规模,适应效率可能成为关键瓶颈,因此高效的微调方法,如LoRA,变得越来越流行。然而,LoRA通常在所有模型层上使用相同的秩,而研究表明,在微调过程中,后层的偏离程度更大。

受特征学习和模块重要性理论的启发,本文开发了一种基于模型不一致性的简单技术,以预测特定模块相对于其他模块的秩。实证结果表明,AdaRank在未见数据上的泛化能力明显优于具有相同参数数量的统一秩模型。与之前的研究相比,AdaRank的独特优势在于保持了预训练和适应阶段的完整性,无需额外的目标或正则化,这可能会影响适应的准确性和性能。

创新点:

1.提出了一种新的技术AdaRank,通过模型不一致性来预测各模块的秩,以适应不同层的微调需求。

2.AdaRank在未见数据上的泛化能力显著优于统一秩模型。

3.AdaRank保留了预训练和适应阶段的完整性,无需额外目标或正则化,从而提升了适应的准确性和性能。

需要的同学添加公众号【沃的顶会】 回复 多模态迁移 即可全部领取

LLaVA-OneVision: Easy Visual Task Transfer

文章解析:

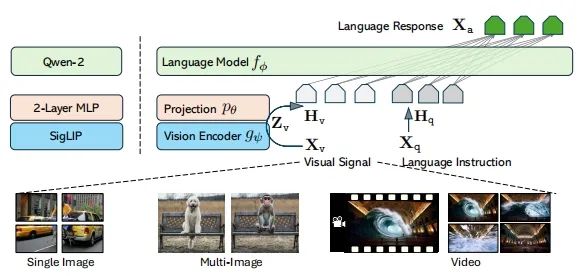

本文介绍了LLaVA-OneVision,这是一个开放的大型多模态模型系列,基于研究团队在LLaVA-NeXT博客系列中的数据、模型和视觉表示的见解。实验结果表明,LLaVA-OneVision是第一个能够在单图像、多图像和视频等三种重要计算机视觉场景中同时推动开放多模态模型性能极限的单一模型。

值得注意的是,LLaVA-OneVision的设计支持不同模态和场景之间的强转移学习,展现出新兴的能力,尤其是在图像到视频的任务转移中,表现出强大的视频理解和跨场景能力。

创新点:

1.大型多模态模型。开发了LLaVA-OneVision,这是一个开放的大型多模态模型系列(LMMs),在单图像、多图像和视频三种重要视觉场景中提升了开放多模态模型的性能界限。

2.新兴能力与任务转移。本文的建模和数据表示设计允许在不同场景之间进行任务转移,提供了一种简单的方法以产生新的新兴能力。特别是,LLaVA-OneVision通过图像到视频的任务转移展现出强大的视频理解能力。

3.开源。为了推动通用视觉助手的构建,向公众发布了以下资源:生成的多模态指令数据、代码库、模型检查点和视觉聊天演示。

需要的同学添加公众号【沃的顶会】 回复 多模态迁移 即可全部领取