二手车交易价格预测——Task2

- EDA-数据探索性分析

- 一、目标

- 二、载入相关库

- 三、载入数据,并做相关分析

- (一)特征集

- (二)数据总览

- (三)判断数据缺失和异常

- (四)了解预测值的分布

- 三、特征分类

- (一)现将要分析的特征单独分离出来

- (二)价格特征分为**数字特征**和**类型特征**

- (三)再分别处理

- 3.1查看unique分布

- 四、 数字特征分析

- (一) 相关性分析

- (二) 查看几个特征的偏度和峰值

- (三) 每个数字特征的分布可视化

- 五、类型特征分析

- (一) unique分布

- (二)类别特征箱形图可视化

- (三) 类别特征的小提琴图可视化

- (四) 类别特征的柱形图可视化

- (五) 类别特征的每个类别频数可视化(count_plot)

- 六、生成数据报告

EDA-数据探索性分析

探索性数据分时是对调查、观测所得到的一些初步的杂乱无章的数据,在尽量少的先验假定下进行处理,通过作图、指标等形式和方程拟合、计算某些特征量等手段,探索数据的结构和规律的一种数据分析方法。

一、目标

1)查看数据分析分布结构和变量之间的关系;

2)用来评估和验证假设,基于这些假设得到未来推论;

3)在提出假说之前,EDA帮助我们先了解数据,提供试验的想法;

4)通过研究数据,确定哪些变量具有最大的预测力,然后选择相应的统计工具,来建立我们的预测模型。

二、载入相关库

#coding:utf-8

#导入warnings包,利用过滤器来实现忽略警告语句

import warnings

warnings.filterwarnings('ignore')import pandas as pd

import numpy as np

import matplotlib.pyplot as plt

import seaborn as sns

import missingno as msno

三、载入数据,并做相关分析

path = './datacsv/'

Train_data = pd.read_csv(path+'used_car_train_20200313.csv', sep=' ')

Test_data = pd.read_csv(path+'used_car_testA_20200313.csv', sep=' ')

(一)特征集

- name - 汽车编码

- regDate - 汽车注册时间

- model - 车型编码

- brand - 品牌

- bodyType - 车身类型

- fuelType - 燃油类型

- gearbox - 变速箱

- power - 汽车功率

- kilometer - 汽车行驶公里

- notRepairedDamage - 汽车有尚未修复的损坏

- regionCode - 看车地区编码

- seller - 销售方

- offerType - 报价类型

- creatDate - 广告发布时间

- price - 汽车价格

- v_0’, ‘v_1’, ‘v_2’, ‘v_3’, ‘v_4’, ‘v_5’, ‘v_6’, ‘v_7’, ‘v_8’, ‘v_9’, ‘v_10’, ‘v_11’, ‘v_12’, ‘v_13’,‘v_14’(根据汽车的评 论、标签等大量信息得到的embedding向量)【匿名特征】

(二)数据总览

Train_data.head().append(Train_data.tail())

Train_data.shape

(150000, 31)

Test_data.head().append(Test_data.tail())

Test_data.describe()

# 熟悉数据类型

Test_data.info()

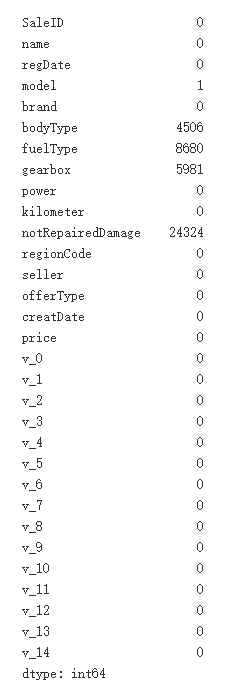

(三)判断数据缺失和异常

1) 查看每列存在NAN的情况

Train_data.isnull().sum()# NAN可视化

missing = Train_data.isnull().sum()

missing = missing[missing > 0]

missing.sort_values(inplace=True)

missing.plot.bar()

# 可视化看缺省值

msno.matrix(Train_data.sample(250))

msno.bar(Train_data.sample(1000))

# 对缺省值进行处理

Train_data['notRepairedDamage'].value_counts()

Train_data['notRepairedDamage'].replace('-', np.nan, inplace=True)

Train_data['notRepairedDamage'].value_counts()

Train_data.isnull().sum()# 每列数值缺失值的情况

Train_data.isnull().sum()

# 对该列[notRepairedDamage]的值进行计数并排序

Test_data['notRepairedDamage'].value_counts()

Test_data['notRepairedDamage'].replace('-', np.nan, inplace=True)Train_data["seller"].value_counts()

Train_data["offerType"].value_counts()

Train_data.head()

del Train_data["seller"]

del Train_data["offerType"]

del Test_data["seller"]

del Test_data["offerType"]

(四)了解预测值的分布

Train_data['price']

Train_data['price'].value_counts()# 1) 总体分布概况(无界约翰逊分布等)

import scipy.stats as st

y = Train_data['price']

plt.figure(1); plt.title('Johnson SU')

sns.distplot(y, kde=False, fit=st.johnsonsu)

plt.figure(2); plt.title('Normal')

sns.distplot(y, kde=False, fit=st.norm)

plt.figure(3); plt.title('Log Normal')

sns.distplot(y, kde=False, fit=st.lognorm)

# 价格不服从正态分布,所以在进行回归之前,它必须进行转换。虽然对数变换做得很好,但佳拟合是无界约翰 逊分布

# 价格不服从正态分布,所以在进行回归之前,它必须进行转换。虽然对数变换做得很好,但佳拟合是无界约翰 逊分布

## 2) 查看skewness(偏度) and kurtosis(峰度)

sns.distplot(Train_data['price']);

print("Skewness: %f" % Train_data['price'].skew())

print("Kurtosis: %f" % Train_data['price'].kurt())

三、特征分类

(一)现将要分析的特征单独分离出来

# 分离label即预测值

Y_train = Train_data['price']

(二)价格特征分为数字特征和类型特征

# 分离label即预测值

# 数字特征

# numeric_features = Train_data.select_dtypes(include=[np.number])

# numeric_features.columns

# # 类型特征

# categorical_features = Train_data.select_dtypes(include=[np.object])

# categorical_features.columns

#即

numeric_features=['power','kilometer','v_0','v_1', 'v_2', 'v_3', 'v_4', 'v_5', 'v_6', 'v_7','v_8', 'v_9', 'v_10', 'v_11', 'v_12', 'v_13','v_14']

categorical_features = ['name','model','brand','bodyType','fuelType','gearbox','power','kilometer','notRepairedDamage','regionCode']

(三)再分别处理

3.1查看unique分布

# 特征nunique分布

for cat_fea in categorical_features:print(cat_fea + "的特征分布如下:")print("{}特征有个{}不同的值".format(cat_fea, Train_data[cat_fea].nunique()))print(Train_data[cat_fea].value_counts())四、 数字特征分析

numeric_features.append('price')

Train_data.head()

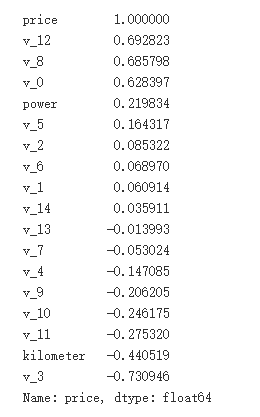

(一) 相关性分析

price_numeric = Train_data[numeric_features]

correlation = price_numeric.corr()

print(correlation['price'].sort_values(ascending = False),'\n')

(二) 查看几个特征的偏度和峰值

del price_numeric['price']

for col in numeric_features: print('{:15}'.format(col), 'Skewness: {:05.2f}'.format(Train_data[col].skew()) , ' ' , 'Kurtosis: {:06.2f}'.format(Train_data[col].kurt()) )

(三) 每个数字特征的分布可视化

f = pd.melt(Train_data, value_vars=numeric_features)

g = sns.FacetGrid(f, col="variable", col_wrap=2, sharex=False, sharey=False)

g = g.map(sns.distplot, "value")

## 4) 数字特征相互之间的关系可视化

sns.set()

columns = ['price', 'v_12', 'v_8' , 'v_0', 'power', 'v_5', 'v_2', 'v_6', 'v_1', 'v_14']

sns.pairplot(Train_data[columns],size = 2 ,kind ='scatter',diag_kind='kde')

plt.show()

五、类型特征分析

(一) unique分布

for fea in categorical_features: print(Train_data[fea].nunique())

(二)类别特征箱形图可视化

# 因为 name和 regionCode的类别太稀疏了,这里我们把不稀疏的几类画一下

categorical_features = ['model','brand','bodyType','fuelType','gearbox','notRepairedDamage']

for c in categorical_features: Train_data[c] = Train_data[c].astype('category') if Train_data[c].isnull().any(): Train_data[c] = Train_data[c].cat.add_categories(['MISSING']) Train_data[c] = Train_data[c].fillna('MISSING')def boxplot(x, y, **kwargs): sns.boxplot(x=x, y=y) x=plt.xticks(rotation=90)

f = pd.melt(Train_data, id_vars=['price'], value_vars=categorical_features)

g = sns.FacetGrid(f, col="variable", col_wrap=2, sharex=False, sharey=False, size=5)

g = g.map(boxplot, "value", "price")

(三) 类别特征的小提琴图可视化

catg_list = categorical_features

target = 'price'

for catg in catg_list : sns.violinplot(x=catg, y=target, data=Train_data) plt.show()

(四) 类别特征的柱形图可视化

def bar_plot(x, y, **kwargs): sns.barplot(x=x, y=y) x=plt.xticks(rotation=90)f = pd.melt(Train_data, id_vars=['price'], value_vars=categorical_features)

g = sns.FacetGrid(f, col="variable", col_wrap=2, sharex=False, sharey=False, size=5)

g = g.map(bar_plot, "value", "price")

(五) 类别特征的每个类别频数可视化(count_plot)

def count_plot(x, **kwargs): sns.countplot(x=x) x=plt.xticks(rotation=90)

f = pd.melt(Train_data, value_vars=categorical_features)

g = sns.FacetGrid(f, col="variable", col_wrap=2, sharex=False, sharey=False, size=5)

g = g.map(count_plot, "value")

六、生成数据报告

import pandas_profiling

pfr = pandas_profiling.ProfileReport(Train_data)

pfr.to_file("./example.html")

在生成报告的时候时间可能比较长(大概是30分钟),可以去干自己的事情。