CORS

- 跨域通讯的问题。解决方案:JSONP、前端代理后端请求、CORS等。

- CORS原理:在服务器的响应报文头中通过access-control-allow-origin告诉浏览器允许跨域访问的域名。

- 在Program.cs的“var app=builder.Build()”这句代码之前注册

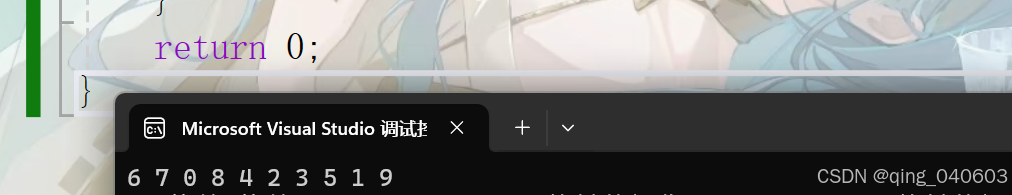

string[] urls = new[] { "http://localhost:3000" }; builder.Services.AddCors(options =>options.AddDefaultPolicy(builder => builder.WithOrigins(urls).AllowAnyMethod().AllowAnyHeader().AllowCredentials())); - Program.cs的app.UseHttpsRedirection()这句代码之前增加

app.UseCors();