一,搭建大数据集群环境

1.2 Hadoop集群搭建

1.2.1 jdk安装

1.下载jdk

(1)在根目录下创建三个子目录以备后用。具体如下:

mkdir -p /export/data

mkdir -p /export/software

mkdir -p /export/servers

(2)下载路径:

1、官网下载地址![]() https://www.oracle.com/java/technologies/javase-downloads.html

https://www.oracle.com/java/technologies/javase-downloads.html

2、百度网盘链接:https://pan.baidu.com/s/1AkJCiEuxdkG_t-PfumbQDQ?pwd=huan

提取码:huan

注意:选择适合自己的JDK,并且注意安装JDK的系统

2.安装jdk

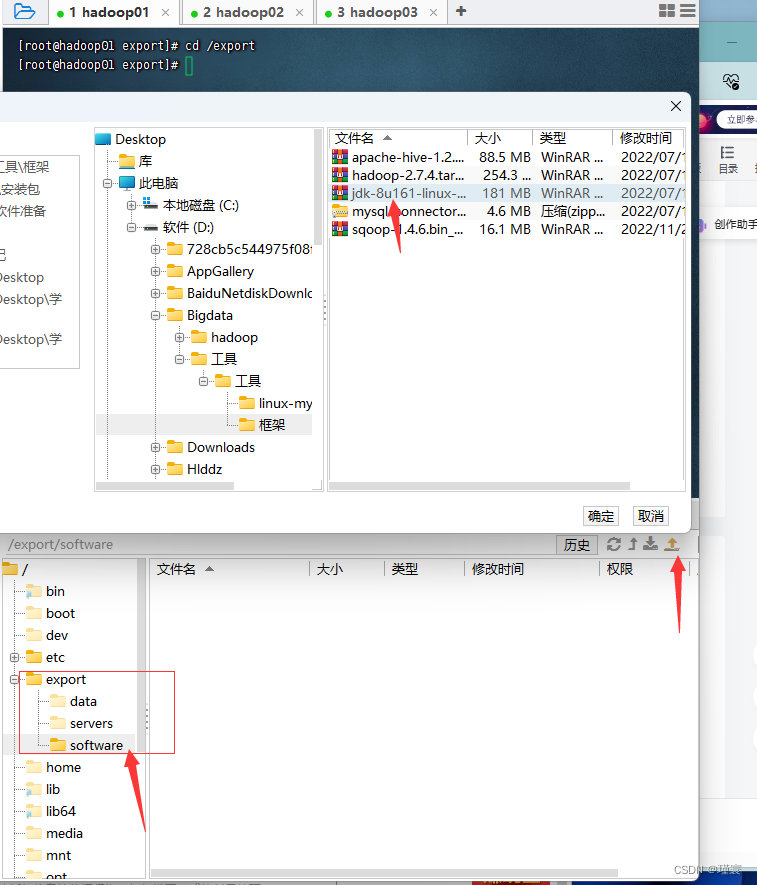

(1)上传jdk安装包至/export/software目录下

(2)查看是否上传成功

(3)解压至 /export/servers目录下

tar -zxvf jdk-8u161-linux-x64.tar.gz -C /export/servers

(注意目录和版本名称)

3.配置jdk环境变量

(1)修改jdk的名称

mv jdk1.8.0_161 jdk (注意jdk的版本名称)

(2)配置环境变量:

vi /etc/profile

![]()

| export JAVA_HOME=/export/servers/jdk export PATH=$PATH:$JAVA_HOME/bin export CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar |

4.jdk环境验证

(1)初始化环境变量

source /etc/profile

(2)验证jdk是否安装成功

java -version

1.2.2 Hadoop安装

1.下载hadoop

(1)下载hadoop的两种方法

①到官网下载《官网》![]() https://hadoop.apache.org/releases.html ②百度网盘链接:https://pan.baidu.com/s/1AkJCiEuxdkG_t-PfumbQDQ?pwd=huan

https://hadoop.apache.org/releases.html ②百度网盘链接:https://pan.baidu.com/s/1AkJCiEuxdkG_t-PfumbQDQ?pwd=huan

提取码:huan

注意:选择适合自己的JDK,并且注意安装JDK的系统

2.安装hadoop

(1)上传hadoop安装包至/export/software目录下

(2)查看是否上传成功

(3)解压至/export/servers目录下

tar -zxvf hadoop-2.7.4.tar.gz -C /export/servers

3.配置hadoop环境变量

(1)修改hadoop的名称

mv hadoop-2.7.4 hadoop

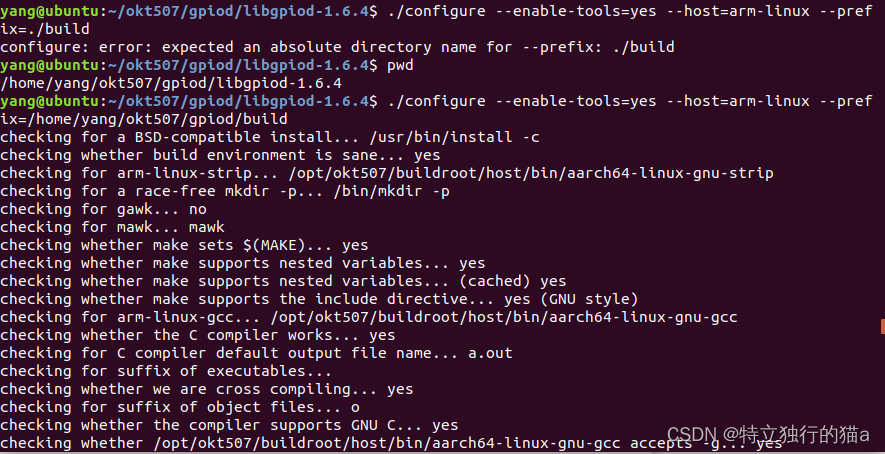

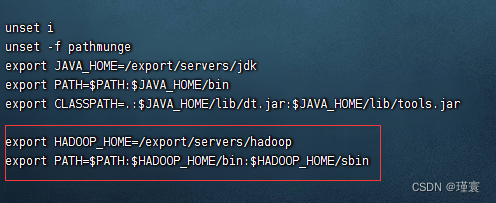

(2)配置环境变量

vi /etc/porfile

![]()

| export HADOOP_HOME=/export/servers/hadoop export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin |

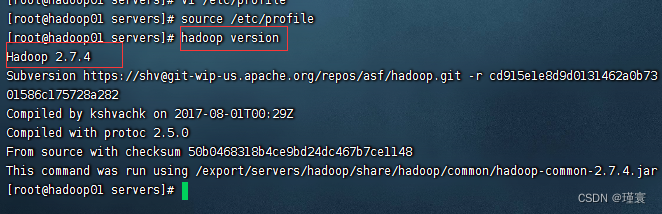

4.hadoop环境验证

(1)初始化环境变量

source /etc/profile

(2)检验hadoop是否安装成功

hadoop version

1.2.3 hadoop集群配置

1.配置hadoop-env.sh

(1)进入hadoop

cd /export/servers/hadoop/etc/hadoop

(2)修改hadoop-env.sh配置文件

vi hadoop-env.sh

2.修改core-site.xml

vi core-site.xml (自己手敲吧,注意别错了哈)

3.修改hdfs-site.xml

vi hdfs-site.xml (自己手敲吧,注意别错了哈)

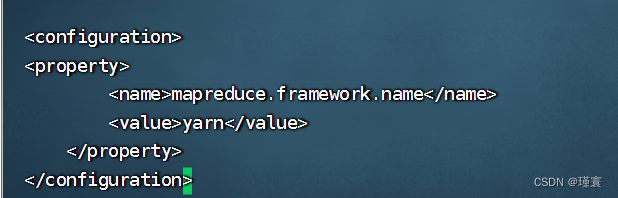

4.修改mapred-sile.xml文件

(1)复制模板并重命名

cp mapred-site.xml.template mapred-site.xml ![]()

(2)编辑文本

vi mapred-site.xml

5.修改yarn-site.xml;

vi yarn-site.xml

6.修改slaves

vi slaves

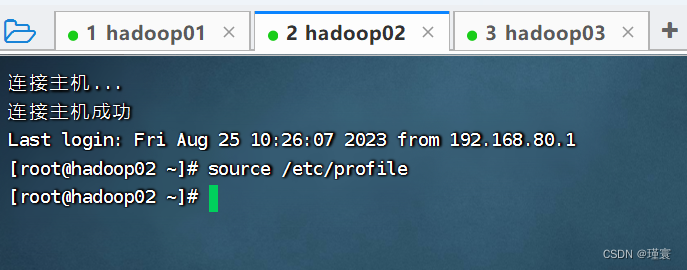

7.将集群主节点的配置文件分发到其他子节点

(1)将安装内容分发给Hadoop02和Hadoop03。(需要提前在hadoop02和hadoop03上创建/export/servers/目录)

scp /etc/profile hadoop02:/etc/profile

scp /etc/profile hadoop03:/etc/profile

scp -r /export/servers/ hadoop02:/export/

scp -r /export/servers/ hadoop03:/export/

![]()

(2)分发完成之后刷新配置文件(三台都需要)

source /etc/profile

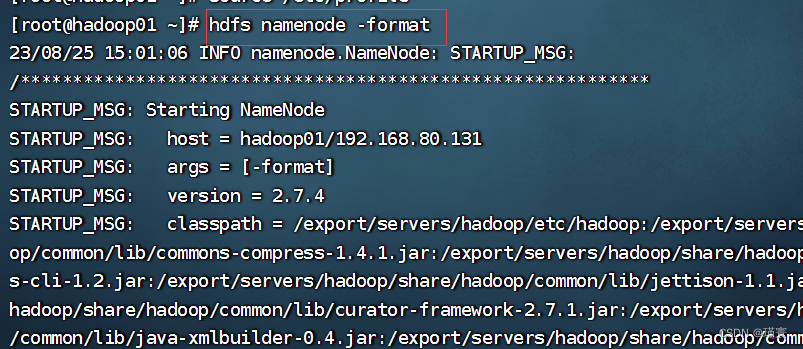

1.2.4hadoop集群测试

1.格式化文件系统(只在hadoop01里面输入,注意先检查是否配置正确,格式化次数过多后面会出问题)

hdfs namenode -format

2.启动hadoop集群

(1)一键启动(只在hadoop01里面输入):start-all.sh

(2)修改本地主机hosts文件

路径:C:\Windows\System32\drivers\etc\hosts

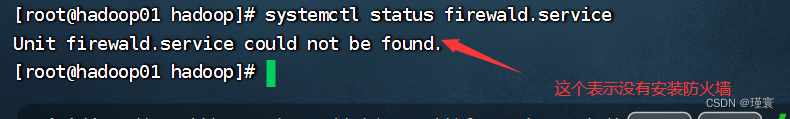

(3)关闭所有节点防火墙并设置禁用。

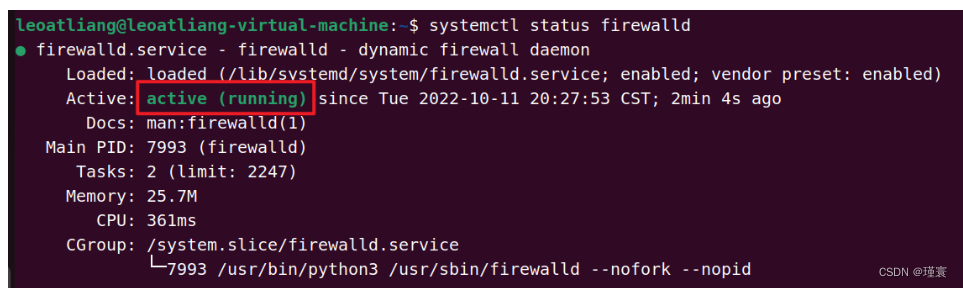

查看防火墙状态:systemctl status firewalld

安装防火墙:yum install firewalld firewall-config

安装了防火墙,查看防火墙显示的是这个页面

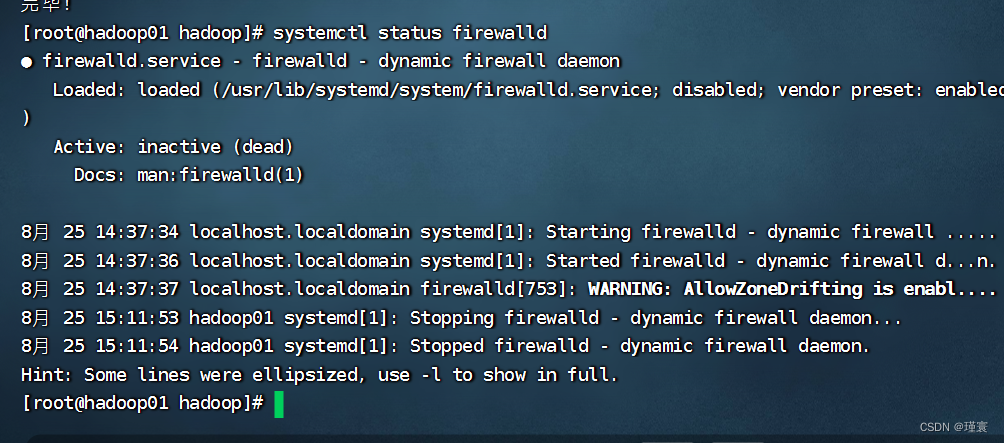

关闭防火墙(暂时的系统重新启动后,防火墙将重新打开):systemctl stop firewalld

关闭防火墙(永久),系统重新启动后,防火墙将依然关闭:systemctl disable firewalld

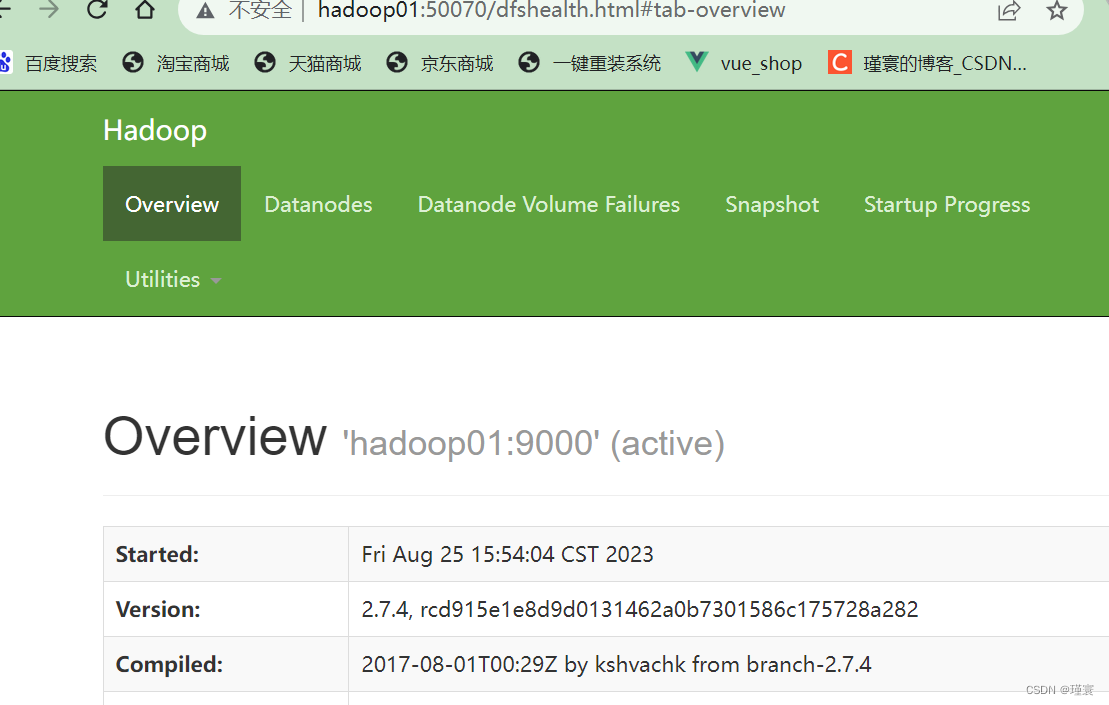

1.2.5通过UI界面查看Hadoop运行状态

打开浏览器中输入:

http://hadoop01:50070

http://hadoop01:8088