在 SQL Server 中,查询的执行并不是按照我们编写的 SQL 语句的顺序进行的。相反,SQL Server 有自己的一套逻辑处理顺序,这个顺序决定了查询的执行方式和结果集的生成。了解这些处理阶段和顺序对于优化查询性能和调试复杂查询非常重要。

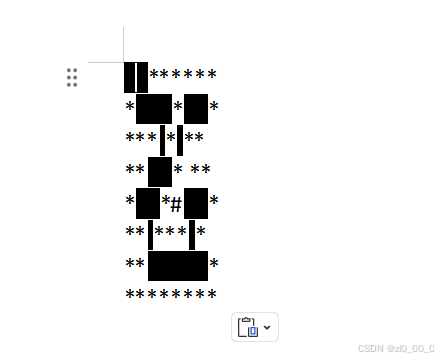

SQL Server 查询处理的逻辑顺序

SQL Server 在执行查询时,会按照特定的逻辑顺序处理不同的子句。以下是 SQL Server 逻辑查询处理的典型顺序:

- FROM:确定数据源,包括表、视图和子查询。

- ON:用于连接操作中的条件过滤。

- JOIN:执行连接操作,合并来自多个数据源的数据。

- WHERE:过滤行数据,保留满足条件的行。

- GROUP BY:将数据分组,以便对每组数据进行聚合操作。

- HAVING:对分组后的数据进行过滤,仅保留满足条件的组。

- SELECT:选择所需的列,并计算表达式。

- DISTINCT:去除结果集中重复的行。

- ORDER BY:对结果集进行排序。

- TOP:返回结果集的前 N 行。

Image Source: ITPro Today

详细解析各个阶段

1. FROM 子句

查询处理的第一步是确定数据源。SQL Server 会解析 FROM 子句中的表、视图和子查询,并构建一个初始的结果集。

SELECT *

FROM Employees

2. ON 子句

在连接操作中,ON 子句用于指定连接条件。在 JOIN 操作之前应用,用于过滤连接的行。

SELECT *

FROM Employees

JOIN Departments ON Employees.DepartmentID = Departments.DepartmentID

3. JOIN 子句

JOIN 子句用于将来自多个数据源的数据合并在一起。常见的连接类型包括 INNER JOIN、LEFT JOIN、RIGHT JOIN 和 FULL JOIN。

SELECT Employees.EmployeeID, Employees.FirstName, Departments.DepartmentName

FROM Employees

JOIN Departments ON Employees.DepartmentID = Departments.DepartmentID

4. WHERE 子句

在确定了数据源并进行了连接操作之后,SQL Server 会应用 WHERE 子句中的条件来过滤行数据。只有满足条件的行才会进入下一阶段。

SELECT *

FROM Employees

WHERE Salary > 50000

5. GROUP BY 子句

如果查询包含 GROUP BY 子句,SQL Server 会将数据分组。分组是基于指定的列进行的,以便对每组数据进行聚合操作。

SELECT DepartmentID, COUNT(*) AS EmployeeCount

FROM Employees

GROUP BY DepartmentID

6. HAVING 子句

HAVING 子句用于过滤分组后的数据。作用类似于 WHERE 子句,但 HAVING 是在分组之后应用的。

SELECT DepartmentID, COUNT(*) AS EmployeeCount

FROM Employees

GROUP BY DepartmentID

HAVING COUNT(*) > 10

7. SELECT 子句

在过滤和分组之后,SQL Server 会处理 SELECT 子句,选择所需的列,并计算表达式。这一步决定了最终结果集中包含哪些列。

SELECT EmployeeID, FirstName, LastName, Salary

FROM Employees

8. DISTINCT 子句

如果查询包含 DISTINCT 关键字,SQL Server 会在 SELECT 子句处理之后去除结果集中重复的行。

SELECT DISTINCT DepartmentID

FROM Employees

9. ORDER BY 子句

ORDER BY 子句用于对结果集进行排序。排序操作是在所有其他处理完成之后进行的。

SELECT FirstName, LastName, Salary

FROM Employees

ORDER BY Salary DESC

10. TOP 子句

最后,如果查询包含 TOP 子句,SQL Server 会返回结果集的前 N 行。这一步是在排序之后进行的。

SELECT TOP 10 FirstName, LastName, Salary

FROM Employees

ORDER BY Salary DESC

总结

理解 SQL Server 逻辑查询处理的顺序对于编写高效的 SQL 查询至关重要。通过掌握这些处理阶段和顺序,可以更好地优化查询性能,确保查询返回正确的结果。

参考资料

- Logical Query Processing: What It Is And What It Means to You

Ending

![[学习笔记] Kotlin Compose-Multiplatform](https://img-home.csdnimg.cn/images/20230724024159.png?origin_url=compose.assets%2Ftooltips.gif&pos_id=img-JR8Vi11g-1738845957167)