BP神经网络的训练集需要大样本吗?一般样本个数为多少?

BP神经网络的训练集需要大样本吗?一般样本个数为多少?

BP神经网络样本数有什么影响学习神经网络这段时间,有一个疑问,BP神经网络中训练的次数指的网络的迭代次数,如果有a个样本,每个样本训练次数n,则网络一共迭代an次,在n>>a 情况下 , 网络在不停的调整权值,减小误差,跟样本数似乎关系不大。

而且,a大了的话训练时间必然会变长。换一种说法,将你的数据集看成一个固定值, 那么样本集与测试集 也可以按照某种规格确定下来如7:3 所以如何看待 样本集的多少与训练结果呢?

或者说怎么使你的网络更加稳定,更加符合你的所需 。

我尝试从之前的一个例子中看下区别如何用70行Java代码实现深度神经网络算法作者其实是实现了一个BP神经网络 ,不多说,看最后的例子一个运用神经网络的例子最后我们找个简单例子来看看神经网络神奇的效果。

为了方便观察数据分布,我们选用一个二维坐标的数据,下面共有4个数据,方块代表数据的类型为1,三角代表数据的类型为0,可以看到属于方块类型的数据有(1,2)和(2,1),属于三角类型的数据有(1,1),(2,2),现在问题是需要在平面上将4个数据分成1和0两类,并以此来预测新的数据的类型。

图片描述我们可以运用逻辑回归算法来解决上面的分类问题,但是逻辑回归得到一个线性的直线做为分界线,可以看到上面的红线无论怎么摆放,总是有一个样本被错误地划分到不同类型中,所以对于上面的数据,仅仅一条直线不能很正确地划分他们的分类,如果我们运用神经网络算法,可以得到下图的分类效果,相当于多条直线求并集来划分空间,这样准确性更高。

图片描述简单粗暴,用作者的代码运行后 训练5000次 。

根据训练结果来预测一条新数据的分类(3,1)预测值 (3,1)的结果跟(1,2)(2,1)属于一类 属于正方形这时如果我们去掉 2个样本,则样本输入变成如下//设置样本数据,对应上面的4个二维坐标数据 double[][] data = new double[][]{{1,2},{2,2}}; //设置目标数据,对应4个坐标数据的分类 double[][] target = new double[][]{{1,0},{0,1}};12341234则(3,1)结果变成了三角形,如果你选前两个点 你会发现直接一条中间线就可以区分 这时候的你的结果跟之前4个点时有区别 so 你得增加样本 直到这些样本按照你所想要的方式分类 ,所以样本的多少 重要性体现在,样本得能反映所有的特征值(也就是输入值) ,样本多少或者特征(本例子指点的位置特征)决定的你的网络的训练结果,!

!!这是 我们反推出来的结果 。这里距离深度学习好像近了一步。另外,这个70行代码的神经网络没有保存你训练的网络 ,所以你每次运行都是重新训练的网络。

其实,在你训练过后 权值已经确定了下来,我们确定网络也就是根据权值,so只要把训练后的权值保存下来,将需要分类的数据按照这种权值带入网络,即可得到输出值,也就是一旦网络确定, 权值也就确定,一个输入对应一个固定的输出,不会再次改变!

个人见解。

最后附上作者的源码,作者的文章见开头链接下面的实现程序可以直接拿去使用,import .Random;public class BpDeep{ public double[][] layer;//神经网络各层节点 public double[][] layerErr;//神经网络各节点误差 public double[][][] layer_weight;//各层节点权重 public double[][][] layer_weight_delta;//各层节点权重动量 public double mobp;//动量系数 public double rate;//学习系数 public BpDeep(int[] layernum, double rate, double mobp){ = mobp; = rate; layer = new double[layernum.length][]; layerErr = new double[layernum.length][]; layer_weight = new double[layernum.length][][]; layer_weight_delta = new double[layernum.length][][]; Random random = new Random(); for(int l=0;l。

谷歌人工智能写作项目:神经网络伪原创

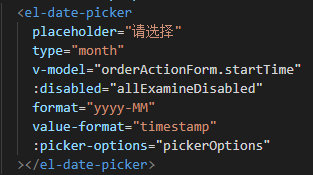

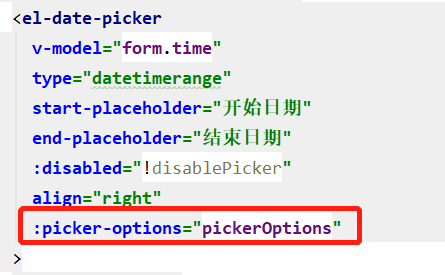

BP神经网络中的训练函数如何选取

神经网络不同的网络有这不同的训练函数,BP神经网络有两种训练函数,trainbp(),利用BP算法训练前向神经网络写作猫。

trainbpx(),利用快速BP算法训练前向神经网络,即采用了动量或自适应学习,可减少训练时间,tansig函数是神经元的传递函数,与训练函数无关,在trainbp()函数中含有要训练神经元的函数。

BP网络中的trainlm训练函数,需要设置的参数?

以输出层权值更新的算法做说明: 新w(i,j)=旧w(i,j)+a*E(i)O(j)+b*oldw(i,j), 其中,新w(i,j)为计算一步以后的权,旧w(i,j)为初始权,E(i)为输出层第i个神经元的输出误差,O(j)为隐含层第j个神经元的输出数据,a学习系数,b惯性系数。

其实b就是优化设计中梯度下降法的步长,训练函数和梯度下降法是一个样子的,都是通过初始点,选定负梯度方向,计算步长,然后得到下一点,如此循环,神经网络把梯度下降法简化了,直接选定步长,不再计算步长了,

还是那个问题 ~ BP神经网络里训练函数

训练用的数据是用来给神经网络学习和测试的,让神经网络学习到这样的输入能有怎样的输出。

训练数据一般分为两组,一组用于神经网络学习(一般情况这组数据占总数据量的3/4左右,也可能更多,依情况而定),另一组是用于测试神经网络学习效果的,将测试的输出结果和输入数据应有的输出结果做比较(以均方和误差作标准),从而验证神经网络训练是否成功。

bp神经网络对输入数据和输出数据有什么要求

p神经网络的输入数据越多越好,输出数据需要反映网络的联想记忆和预测能力。BP网络能学习和存贮大量的输入-输出模式映射关系,而无需事前揭示描述这种映射关系的数学方程。

它的学习规则是使用最速下降法,通过反向传播来不断调整网络的权值和阈值,使网络的误差平方和最小。

BP神经网络模型拓扑结构包括输入层(input)、隐层(hide layer)和输出层(output layer)。

BP网络具有高度非线性和较强的泛化能力,但也存在收敛速度慢、迭代步数多、易于陷入局部极小和全局搜索能力差等缺点。

扩展资料:BP算法主要思想是:输入学习样本,使用反向传播算法对网络的权值和偏差进行反复的调整训练,使输出的向量与期望向量尽可能地接近,当网络输出层的误差平方和小于指定的误差时训练完成,保存网络的权值和偏差。

1、初始化,随机给定各连接权及阀值。

2、由给定的输入输出模式对计算隐层、输出层各单元输出3、计算新的连接权及阀值,计算公式如下:4、选取下一个输入模式对返回第2步反复训练直到网络设输出误差达到要求结束训练。

参考资料来源:百度百科-BP神经网络。

能不能介绍一下,BP神经网络中权系数初始值、学习率(步长)、学习步数、学习目标最小误差等参数

权值第一次是被随机给定的较小的值,步长一般设为较小的正值(防止越过最小值),学习步数是由权值和步长决定的,误差一般采用最小均方误差。详细的介绍可以百度一下很多课件或者课本的。

若不想找我可以发给你,给我邮箱。

BP神经网络模型各个参数的选取问题

样本变量不需要那么多,因为神经网络的信息存储能力有限,过多的样本会造成一些有用的信息被丢弃。如果样本数量过多,应增加隐层节点数或隐层数目,才能增强学习能力。

一、隐层数 一般认为,增加隐层数可以降低网络误差(也有文献认为不一定能BP神经网络模型各个参数的选取问题。

BP神经网络的mu参数是学习率么?训练结果val fail中的validation check=6什么意思

神经网络的样本若输入网络,默认情况下会将样本随即分为3类:训练样本,确认样本和测试样本。确认检查值默认是6,它的意思是指随着网络利用训练样本进行训练的过程中,确认样本的误差曲线连续6次迭代不在下降。

这时训练终止(这只是训练终止条件之一,满足任一终止条件,训练过程都将终止)深层含义你可以这样理解,如果随着网络的训练,确认样本的误差已经基本不在减小,甚至增大,那么就没有必要再去训练网络了,因为继续训练下去的话,在利用测试样本进行测试网络的话,测试样本的误差将同样不会有所改善,甚至会出现过度拟合的现象。

validation checks已经达到设置的值了,所以停止训练了,如果网络在连续max_fail epochs后不能提高网络性能,就停止训练。

有三种方法解决这个问题:1 提高validation checks的数值,比如设置net.trainParam.max_fail = 200;其实这等于自己糊弄自己严重不推荐,出现停止训练,就是因为被训练的网络已经过拟合,停下来是应该的。

但6的确有点小,建议改成10到20之间的数2 修改被训练的网络,比如说再加一个隐藏层试试3 如果是数据太相近的问题,试试选择用divideind。