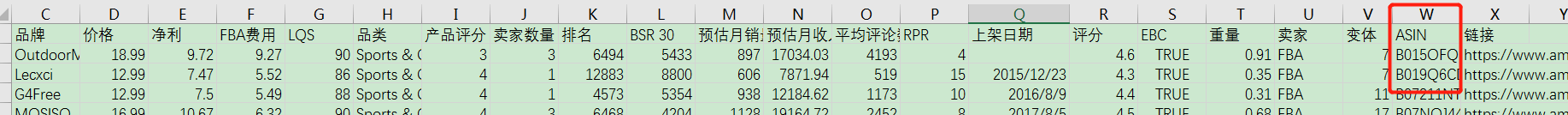

1.使用AMZSscount获取的产品信息的,将这一列复制一下,构造详情页的链接到redis数据库中,进行分布式抓取。

2.打开excel,先运行这个代码。

import redis

import xlwings as xw

conn = redis.Redis(host='192.168.31.104', port=6379, )

#app = xw.App(visible=True, add_book=False)

wb = xw.Book('./吴银琳要求吊带包采集数据 sling bag.xlsx')

sht=wb.sheets['Sheet1']

print(sht.range('B2').value)

ASIN_LIST=sht.range('B2').expand('down').value

print(ASIN_LIST)for each in ASIN_LIST:each='https://www.amazon.com/dp/'+eachprint(each)conn.lpush('USA_Detail:start_urls',each)print(len(ASIN_LIST))

然后redis数据库中就有url

3.再运行这个代码。

运行效果如下:

3.这里我开的是一个线程,使用的是本地的IP,由于使用了自动爬取速度,

在

settings中设置:

RANDOMIZE_DOWNLOAD_DELAY = True

'''

https://www.cnblogs.com/xueli/p/7250537.html 对setting的解释

'''# from scrapy.contrib.throttle import AutoThrottle

AUTOTHROTTLE_ENABLED = True

#起始的延迟

AUTOTHROTTLE_START_DELAY = 3

# #最小延迟

DOWNLOAD_DELAY = random.randint(3,5)

# #最大延迟

AUTOTHROTTLE_MAX_DELAY = 15

#每秒并发请求数的平均值,不能高于 CONCURRENT_REQUESTS_PER_DOMAIN或CONCURRENT_REQUESTS_PER_IP,调高了则吞吐量增大强奸目标站点,调低了则对目标站点更加”礼貌“

#每个特定的时间点,scrapy并发请求的数目都可能高于或低于该值,这是爬虫视图达到的建议值而不是硬限制

AUTOTHROTTLE_TARGET_CONCURRENCY = 5 # 平均每秒并发数 原先值为16

#调试

AUTOTHROTTLE_DEBUG = True

CONCURRENT_REQUESTS_PER_DOMAIN = 5 #单个域名的请求数,,原先值为16

CONCURRENT_REQUESTS_PER_IP =5 # 单个IP的并发请求数,原先值为16# Configure maximum concurrent requests performed by Scrapy (default: 16)

# 配置Scrapy执行的最大并发请求(默认值:16)

CONCURRENT_REQUESTS = 1#类似于线程数量。。默认是16,一下子提交16个强求。。

在中间件中我设置了cookie的一部分,防止页面的重定向跳转,,

cookie的使用有两种方式

3.1你可以将页面的cookies全部复制过来,转换为字典的格式。这里不详细说了,你可以下载爬取日本站的代码看一下,里面注释的有。日本站有防火墙,要使用国外的IP代理,我用的是TOR

3.2使用selenium获取cookie的方式保存为txt文件,这里我以前就是使用这个方式的,这里保留了写法,并没有使用。

4.我在中间件中也设置了使用阿布云的IP代理,不过注释掉了。

5.将保存到redis数据的数据保存到本地的MongoDB数据库。

# -*- coding: utf-8 -*-

# @Time : 2020/4/15 10:45

# @Author : 结尾!!

# @FileName: 1将数据保存到MongoDB.py

# @Software: PyCharm#从redis数据保存到MongoDBimport redis

import pymongo

import json

import time

def process_item():# 创建redis数据库连接rediscli = redis.Redis(host = "127.0.0.1", port = 6379, db = "0")# 创建MongoDB数据库连接mongocli = pymongo.MongoClient(host = "127.0.0.1", port = 27017)# 创建mongodb数据库名称dbname = mongocli["amazon_us"]# 创建mongodb数据库youyuan的表名称sheetname = dbname["Asin_Body_0415"]offset = 0while True:# redis 数据表名 和 数据source, data = rediscli.blpop("USA_Detail:items")offset += 1# 将json对象转换为Python对象data = json.loads(data)print(data)# 将数据插入到sheetname表里sheetname.insert(data)print (offset)time.sleep(0)if __name__ == "__main__":process_item()代码我放在这里了

https://github.com/jevy146/spider_amazon_python/

欢迎下载