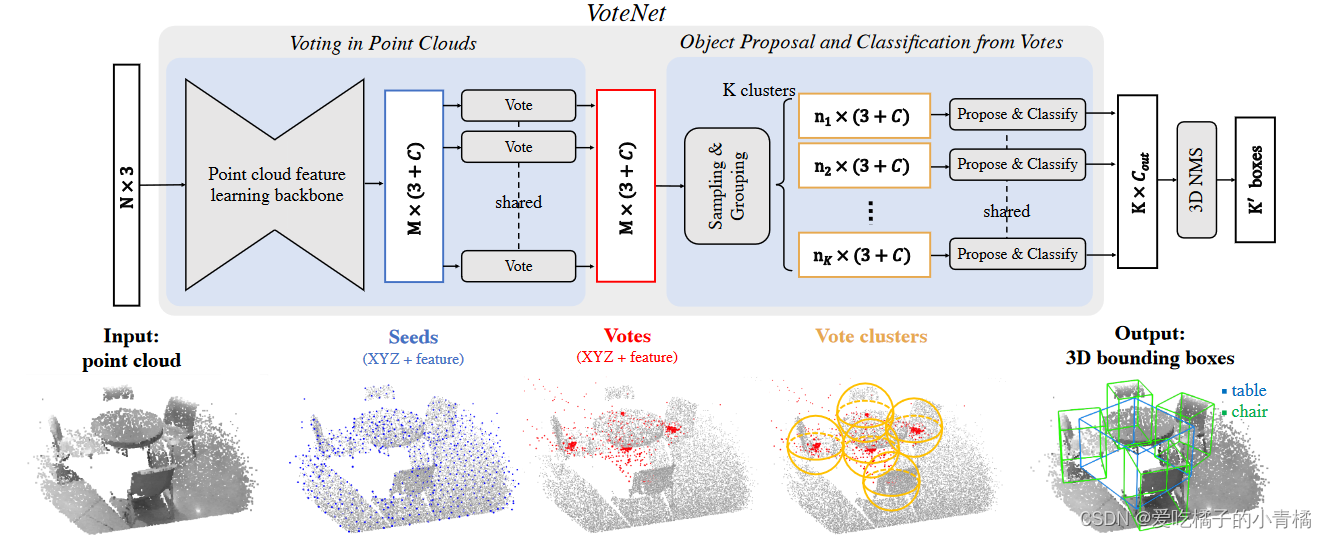

Votenet是一种用于3D对象检测的深度学习网络,其网络结构主要由两个部分组成:Vote网络和Objectness网络。

Vote网络被设计用于从点云数据中生成候选3D边界框。它由三个主要的模块组成:1)共享MLP层,用于提取点云中每个点的特征表示;2)基于特征的滑动窗口投票层,用于将每个点分配到可能的候选框中;3)几何特征编码层,用于生成3D边界框。共享MLP层将点云数据作为输入,并逐层通过一系列的全连接层,提取点云中每个点的特征表示。接下来,基于特征的滑动窗口投票层将每个点分配到可能的边界框中,这是通过在3D空间中滑动固定大小的框,并根据每个点距离框中心的距离将其分配到最接近的框中。最后,几何特征编码层将每个生成的候选框的几何特征编码为固定长度的向量,以便后续的对象性判断。

Objectness网络则负责通过学习来判断每个候选框是否包含一个真实的3D对象。该网络由两个主要的模块组成:1)共享MLP层,用于提取每个候选框的特征表示;2)分类头,用于通过全连接层将特征表示映射到类别概率分布。共享MLP层将每个候选框的几何特征作为输入,并逐层通过一系列的全连接层,提取候选框的特征表示。接下来,分类头将特征表示映射到一个类别概率分布,以判断每个候选框是否包含一个真实的3D对象。

整个Votenet网络结构的训练过程是端到端的,即Vote网络和Objectness网络共同训练。在训练过程中,使用交叉熵损失函数来优化两个网络的参数,以最小化预测结果与真实标签之间的差异。

总的来说,Votenet网络结构通过Vote网络生成候选边界框,并通过Objectness网络判断每个候选框是否包含真实的3D对象。这种结构可以有效地对点云数据进行3D对象检测,并在各种应用中表现出良好的性能。