超级计算机作为用于执行普通电脑无法处理的资料为主的设备,虽然与普通电脑在构造方面基本一致,但是在性能与规模上却有很大的差异。据悉超级计算机主要拥有超大的数据存储容量、快速处理数据的能力,而美国是全球最早拥有超级计算机的国家。根据记载1976年美国率先研发出全球首台超级计算机,这台计算机拥有2.5亿次的计算能力。为此也让全球国家拉开研发超级计算机的序幕,毕竟这一设备在物理学、密码破译等领域有着极为重要的作用。

根据了解我国在2009年成功研发天河一号超级计算机,每秒可进行1200万亿次的计算。为此也让中国一举拥有全球一流的超级计算机,并且还对天河一号进行全面升级。升级之后每秒计算能力达到4700万亿次,因此我国成为继美国之后,第二个拥有千万亿次超级计算机的国家。此外天河一号问世之后,在我国的石油勘探、装备研制、生物医药、工程设计等领域,均有着十分重要的作用。

据悉在2013年我国再度亮相了天河二号超级计算机,凭借每秒3.39京次的双 精度浮点成为当时全球最快的超级计算机。此外在2014年的全球超级计算机500强榜单中,我国的天河二号更是一举击败美国泰坦,成为连续四次获得冠军的超级计算机。此后在2016年我国推出太湖之光超级计算机,成为天河二号的替代者。拥有每秒12.54京次的计算能力,同时我国在2020年首次在太湖之光计算机上实现千万核心并行的第一性原理模拟试验,因此也奠定我国超级计算机在全球领先的地位。

为了扭转这一局面,美国在2018年全球500强超级计算机的比赛上,推出一款名为顶点的超级计算机。该计算机拥有每秒14.86亿亿次浮点运算能力,成为当时全球运算速度最快的超级计算机。为此美国认为在这一领域终于再回到领先全球的地位,没有想到的是,紧随其后我国再度推出天河三号E级原型机。并且搭载自主研发的麒麟操作系统,使用飞腾CPU,浮点计算能力达到10的18次方,存储量是天河一号的100倍。

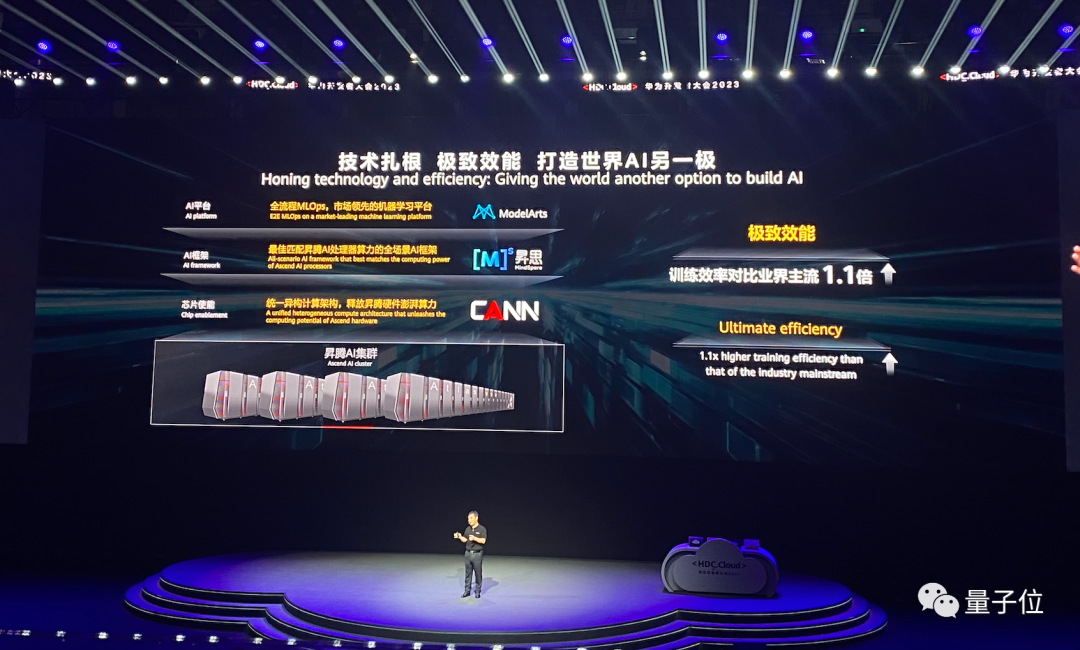

同时天河三号的计算能力相当于13亿人上万年的工作量,因此这款计算机的问世,有望超越美国的顶点,跻身全球一流序列之中。可以说我国接连推出新型超级计算机之后,不断超越美国,最终达到领先全球的水平,背后必定有着强大的实力作为支撑。也能够看出,如今的中国在芯片领域也拥有了属于自己的成就。