来自Transformers的双向编码器表示(BERT)

BERT(Bidirectional Encoder Representations from Transformers)是一种预训练的自然语言处理模型,由Google于2018年提出。它是基于Transformer模型架构的深度双向(双向指同时考虑上下文信息)表示学习模型。

BERT的目标是通过在大规模文本语料上进行自监督学习来学习通用的语言表示。在预训练阶段,BERT使用了两个主要任务:掩码语言模型(Masked Language Model,MLM)和下一句预测(Next Sentence Prediction,NSP)。

在掩码语言模型任务中,BERT会在输入句子中随机掩盖一些词,并尝试预测这些掩盖的词。这个任务使得模型能够通过上下文来理解词语之间的关系,同时也能够学习到句子级别的表示。

在下一句预测任务中,BERT会输入两个句子,并预测这两个句子是否是连续的。这个任务有助于模型学习到句子之间的关联性和推理能力。

通过这两个任务的预训练,BERT能够学习到丰富的句子级别和词级别的语义表示。在实际应用中,BERT的预训练模型可以用来进行下游任务的微调,比如文本分类、命名实体识别、句子相似度等。

BERT的主要特点包括以下几点:

-

双向性:BERT通过使用Transformer的编码器结构,能够同时考虑上下文信息,使模型能够更好地理解句子中的每个词的语义。

-

预训练-微调架构:BERT先在大规模文本语料上进行预训练,然后通过微调在具体任务上进行优化。这种架构使得模型能够在不同的任务上灵活应用,并且不需要从零开始训练。

-

多层表示:BERT模型由多个Transformer编码器层组成,每个层都生成了丰富的句子和词级别的表示,使得模型能够处理不同层次的语义信息。

-

预训练规模:BERT的预训练使用了大规模的文本语料,其中包括了互联网上的大量文本数据,这使得模型能够学习到更通用的语言表示。

我们已经介绍了几种用于自然语言理解的词嵌入模型。在预训练之后,输出可以被认为是一个矩阵,其中每一行都是一个表示预定义词表中词的向量。事实上,这些词嵌入模型都是与上下文无关的。让我们先来说明这个性质。

文章内容来自李沐大神的《动手学深度学习》并加以我的理解,感兴趣可以去https://zh-v2.d2l.ai/查看完整书籍

文章目录

- 来自Transformers的双向编码器表示(BERT)

- 用于预训练BERT的数据集

- 为预训练任务定义辅助函数

- 生成下一句预测任务的数据

- 生成遮蔽语言模型任务的数据

- 将文本转换为预训练数据集

- 预训练BERT

- 预训练BERT

- 用BERT表示文本

用于预训练BERT的数据集

为了预训练上一节中实现的BERT模型,我们需要以理想的格式生成数据集,以便于两个预训练任务:遮蔽语言模型和下一句预测。一方面,最初的BERT模型是在两个庞大的图书语料库和英语维基百科的合集上预训练的,但它很难吸引这本书的大多数读者。另一方面,现成的预训练BERT模型可能不适合医学等特定领域的应用。因此,在定制的数据集上对BERT进行预训练变得越来越流行。为了方便BERT预训练的演示,我们使用了较小的语料库WikiText-2 (Merity et al., 2016)。

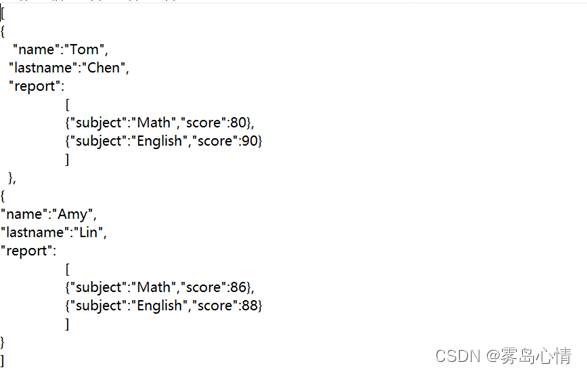

在WikiText-2数据集中,每行代表一个段落,其中在任意标点符号及其前面的词元之间插入空格。保留至少有两句话的段落。为了简单起见,我们仅使用句号作为分隔符来拆分句子。

import os

import random

import torch

from d2l import torch as d2l#@save

d2l.DATA_HUB['wikitext-2'] = ('https://s3.amazonaws.com/research.metamind.io/wikitext/''wikitext-2-v1.zip', '3c914d17d80b1459be871a5039ac23e752a53cbe')#@save

def _read_wiki(data_dir):file_name = os.path.join(data_dir, 'wiki.train.tokens')with open(file_name, 'r') as f:lines = f.readlines()# 大写字母转换为小写字母paragraphs = [line.strip().lower().split(' . ')for line in lines if len(line.split(' . ')) >= 2]random.shuffle(paragraphs)return paragraphs

这是一个用于读取维基百科数据的函数 _read_wiki。它假设数据存储在指定的目录 data_dir 中的 wiki.train.tokens 文件中。

函数的主要步骤如下:

- 构建文件路径:使用

os.path.join函数将data_dir和文件名'wiki.train.tokens'连接起来,得到完整的文件路径。 - 打开文件:使用

open函数以只读模式打开文件,并使用f.readlines()读取文件中的所有行,将其存储在变量lines中。 - 处理段落:遍历

lines中的每一行,首先使用line.strip()去除行首尾的空白字符,然后使用lower()方法将大写字母转换为小写字母,最后使用split(' . ')方法将每一行按句号加空格分割成多个句子,并将这些句子组成的列表存储在paragraphs中。这样,paragraphs就成为了一个三重列表的嵌套结构,其中每个元素表示一个段落,每个段落由多个句子组成。 - 随机打乱段落:使用

random.shuffle函数对paragraphs列表进行随机打乱,以增加数据的随机性。 - 返回结果:将打乱后的

paragraphs返回。

为预训练任务定义辅助函数

在下文中,我们首先为BERT的两个预训练任务实现辅助函数。这些辅助函数将在稍后将原始文本语料库转换为理想格式的数据集时调用,以预训练BERT。

生成下一句预测任务的数据

_get_next_sentence函数生成二分类任务的训练样本。

#@save

def _get_next_sentence(sentence, next_sentence, paragraphs):if random.random() < 0.5:is_next = Trueelse:# paragraphs是三重列表的嵌套next_sentence = random.choice(random.choice(paragraphs))is_next = Falsereturn sentence, next_sentence, is_next

函数 _get_next_sentence 用于生成一个句子及其下一个句子,并返回它们以及一个布尔值 is_next,表示这两个句子是否是连续的。

函数中的逻辑如下:

- 以50%的概率,将

is_next设置为True,表示给定的sentence和next_sentence是连续的。 - 如果上述概率条件不满足,则从给定的

paragraphs(三重列表的嵌套结构)中随机选择一个段落,再从选中的段落中随机选择一个句子作为next_sentence。 - 将

sentence、next_sentence和is_next返回。

下面的函数通过调用_get_next_sentence函数从输入paragraph生成用于下一句预测的训练样本。这里paragraph是句子列表,其中每个句子都是词元列表。自变量max_len指定预训练期间的BERT输入序列的最大长度。

#@save

def _get_nsp_data_from_paragraph(paragraph, paragraphs, vocab, max_len):nsp_data_from_paragraph = []for i in range(len(paragraph) - 1):tokens_a, tokens_b, is_next = _get_next_sentence(paragraph[i], paragraph[i + 1], paragraphs)# 考虑1个'<cls>'词元和2个'<sep>'词元if len(tokens_a) + len(tokens_b) + 3 > max_len:continuetokens, segments = get_tokens_and_segments(tokens_a, tokens_b)nsp_data_from_paragraph.append((tokens, segments, is_next))return nsp_data_from_paragraph

函数 _get_nsp_data_from_paragraph,用于从给定的段落中生成用于预测句子关系(Next Sentence Prediction)任务的数据。

函数的参数包括:

paragraph:一个段落,由多个句子组成。paragraphs:包含多个段落的列表。vocab:词汇表。max_len:最大长度限制。

函数的主要步骤如下:

- 创建一个空列表

nsp_data_from_paragraph用于存储生成的数据。 - 遍历段落中的每个句子,从第一个句子到倒数第二个句子。

- 对于每对相邻的句子

paragraph[i]和paragraph[i+1],调用_get_next_sentence函数获取两个句子和它们的连续性标签。 - 判断两个句子的长度是否超过

max_len,如果超过则跳过当前句子对。 - 使用

get_tokens_and_segments函数将两个句子转换为词元列表和句子分割标记列表。 - 将转换后的数据以元组

(tokens, segments, is_next)的形式添加到nsp_data_from_paragraph列表中。 - 遍历完所有句子对后,返回生成的

nsp_data_from_paragraph列表。

生成遮蔽语言模型任务的数据

为了从BERT输入序列生成遮蔽语言模型的训练样本,我们定义了以下_replace_mlm_tokens函数。在其输入中,tokens是表示BERT输入序列的词元的列表,candidate_pred_positions是不包括特殊词元的BERT输入序列的词元索引的列表(特殊词元在遮蔽语言模型任务中不被预测),以及num_mlm_preds指示预测的数量(选择15%要预测的随机词元)。在每个预测位置,输入可以由特殊的“掩码”词元或随机词元替换,或者保持不变。最后,该函数返回可能替换后的输入词元、发生预测的词元索引和这些预测的标签。

#@save

def _replace_mlm_tokens(tokens, candidate_pred_positions, num_mlm_preds,vocab):# 为遮蔽语言模型的输入创建新的词元副本,其中输入可能包含替换的“<mask>”或随机词元mlm_input_tokens = [token for token in tokens]pred_positions_and_labels = []# 打乱后用于在遮蔽语言模型任务中获取15%的随机词元进行预测random.shuffle(candidate_pred_positions)for mlm_pred_position in candidate_pred_positions:if len(pred_positions_and_labels) >= num_mlm_preds:breakmasked_token = None# 80%的时间:将词替换为“<mask>”词元if random.random() < 0.8:masked_token = '<mask>'else:# 10%的时间:保持词不变if random.random() < 0.5:masked_token = tokens[mlm_pred_position]# 10%的时间:用随机词替换该词else:masked_token = random.choice(vocab.idx_to_token)mlm_input_tokens[mlm_pred_position] = masked_tokenpred_positions_and_labels.append((mlm_pred_position, tokens[mlm_pred_position]))return mlm_input_tokens, pred_positions_and_labels

这个函数用于为遮蔽语言模型(Masked Language Model, MLM)的输入创建新的词元副本,其中输入可能包含替换的 “” 或随机词元。

函数的输入参数如下:

tokens:包含输入文本的词元列表。candidate_pred_positions:候选的预测位置列表,表示哪些位置可以进行遮蔽语言模型的预测。num_mlm_preds:需要进行遮蔽语言模型预测的个数。vocab:词汇表对象,用于获取随机词元。

函数的输出为一个元组,包含两个元素:

mlm_input_tokens:包含遮蔽语言模型输入的词元列表,其中可能包含 “” 或随机词元。pred_positions_and_labels:包含预测位置和对应原始词元的元组列表。

在函数内部,首先创建一个副本 mlm_input_tokens,内容与输入的 tokens 相同。然后,通过打乱 candidate_pred_positions 列表的顺序,随机选择一些位置进行遮蔽语言模型的预测。根据一定的概率分布,将选中位置的词元替换为 “” 或随机词元,并将预测位置和对应原始词元添加到 pred_positions_and_labels 列表中。

最后,函数返回 mlm_input_tokens 和 pred_positions_and_labels。

通过调用前述的_replace_mlm_tokens函数,以下函数将BERT输入序列(tokens)作为输入,并返回输入词元的索引、发生预测的词元索引以及这些预测的标签索引。

#@save

def _get_mlm_data_from_tokens(tokens, vocab):candidate_pred_positions = []# tokens是一个字符串列表for i, token in enumerate(tokens):# 在遮蔽语言模型任务中不会预测特殊词元if token in ['<cls>', '<sep>']:continuecandidate_pred_positions.append(i)# 遮蔽语言模型任务中预测15%的随机词元num_mlm_preds = max(1, round(len(tokens) * 0.15))mlm_input_tokens, pred_positions_and_labels = _replace_mlm_tokens(tokens, candidate_pred_positions, num_mlm_preds, vocab)pred_positions_and_labels = sorted(pred_positions_and_labels,key=lambda x: x[0])pred_positions = [v[0] for v in pred_positions_and_labels]mlm_pred_labels = [v[1] for v in pred_positions_and_labels]return vocab[mlm_input_tokens], pred_positions, vocab[mlm_pred_labels]

该函数用于从词元列表中获取遮蔽语言模型(Masked Language Model, MLM)的数据。

函数的输入参数如下:

tokens:包含输入文本的词元列表。vocab:词汇表对象,用于将词元转换为对应的索引。

函数的输出为一个元组,包含三个元素:

mlm_input_tokens:经过遮蔽语言模型处理后的输入词元列表。pred_positions:预测位置的列表,表示哪些位置需要进行遮蔽语言模型的预测。mlm_pred_labels:预测位置对应的原始词元列表。

在函数内部,首先创建一个空列表 candidate_pred_positions,用于存储可以进行遮蔽语言模型预测的位置。然后遍历输入的词元列表 tokens,将非特殊词元(如 “” 和 “”)的索引添加到 candidate_pred_positions 列表中。

接下来,通过计算需要预测的词元数量,将该数量设置为 num_mlm_preds,这里采用的策略是将需要预测的词元数量设置为整个文本长度的 15%。然后调用 _replace_mlm_tokens 函数,传入 tokens、candidate_pred_positions、num_mlm_preds 和 vocab,获取经过遮蔽语言模型处理后的词元列表 mlm_input_tokens 和预测位置及对应原始词元的元组列表 pred_positions_and_labels。

最后,对 pred_positions_and_labels 进行排序,根据预测位置的索引进行升序排序,并分别将预测位置和对应原始词元提取到两个列表 pred_positions 和 mlm_pred_labels 中。

函数返回经过词汇表转换后的 mlm_input_tokens、pred_positions 和 mlm_pred_labels。

将文本转换为预训练数据集

现在我们几乎准备好为BERT预训练定制一个Dataset类。在此之前,我们仍然需要定义辅助函数_pad_bert_inputs来将特殊的“”词元附加到输入。它的参数examples包含来自两个预训练任务的辅助函数_get_nsp_data_from_paragraph和_get_mlm_data_from_tokens的输出。

#@save

def _pad_bert_inputs(examples, max_len, vocab):max_num_mlm_preds = round(max_len * 0.15)all_token_ids, all_segments, valid_lens, = [], [], []all_pred_positions, all_mlm_weights, all_mlm_labels = [], [], []nsp_labels = []for (token_ids, pred_positions, mlm_pred_label_ids, segments,is_next) in examples:all_token_ids.append(torch.tensor(token_ids + [vocab['<pad>']] * (max_len - len(token_ids)), dtype=torch.long))all_segments.append(torch.tensor(segments + [0] * (max_len - len(segments)), dtype=torch.long))# valid_lens不包括'<pad>'的计数valid_lens.append(torch.tensor(len(token_ids), dtype=torch.float32))all_pred_positions.append(torch.tensor(pred_positions + [0] * (max_num_mlm_preds - len(pred_positions)), dtype=torch.long))# 填充词元的预测将通过乘以0权重在损失中过滤掉all_mlm_weights.append(torch.tensor([1.0] * len(mlm_pred_label_ids) + [0.0] * (max_num_mlm_preds - len(pred_positions)),dtype=torch.float32))all_mlm_labels.append(torch.tensor(mlm_pred_label_ids + [0] * (max_num_mlm_preds - len(mlm_pred_label_ids)), dtype=torch.long))nsp_labels.append(torch.tensor(is_next, dtype=torch.long))return (all_token_ids, all_segments, valid_lens, all_pred_positions,all_mlm_weights, all_mlm_labels, nsp_labels)

定义了一个名为 _pad_bert_inputs 的函数,用于对BERT模型的输入示例进行填充和组织。以下是函数的功能解释:

-

函数接受以下输入:

examples:一个输入示例的列表。每个示例是一个元组,包含以下内容:token_ids:表示输入标记的标记ID列表。pred_positions:表示掩码(待预测)标记位置的列表。mlm_pred_label_ids:表示掩码标记的标签的标记ID列表。segments:用于区分输入中不同片段的片段ID列表。is_next:表示下一个句子是否是当前句子的续句的标签。

max_len:填充后的输入序列的最大长度。vocab:词汇表字典。

-

函数初始化空列表,用于存储填充后的输入和标签。

-

函数根据最大序列长度(

max_len)计算允许的最大掩码语言模型(MLM)预测数,并将其设置为max_num_mlm_preds。 -

函数遍历每个输入示例,并执行以下步骤:

a. 将

token_ids用’'标记的ID进行填充,使其与max_len匹配,并将其转换为PyTorch张量。b. 将

segments列表用零进行填充,使其与max_len匹配,并将其转换为PyTorch张量。c. 计算原始

token_ids的长度(不包括’'标记),并将其转换为PyTorch张量。d. 将

pred_positions用零进行填充,使其与max_num_mlm_preds匹配,并将其转换为PyTorch张量。e. 创建MLM权重的张量,其中原始

mlm_pred_label_ids的权重设为1.0,填充预测的权重设为0.0,并将其转换为PyTorch张量。f. 将

mlm_pred_label_ids用零进行填充,使其与max_num_mlm_preds匹配,并将其转换为PyTorch张量。g. 将

is_next标签转换为PyTorch张量。h. 将所有张量附加到各自的列表中。

-

最后,函数返回一个包含所有填充张量的元组:

(all_token_ids, all_segments, valid_lens, all_pred_positions, all_mlm_weights, all_mlm_labels, nsp_labels)。

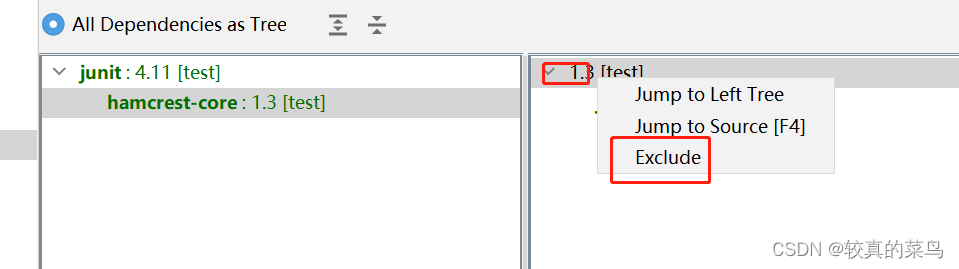

将用于生成两个预训练任务的训练样本的辅助函数和用于填充输入的辅助函数放在一起,我们定义以下_WikiTextDataset类为用于预训练BERT的WikiText-2数据集。通过实现__getitem__函数,我们可以任意访问WikiText-2语料库的一对句子生成的预训练样本(遮蔽语言模型和下一句预测)样本。

最初的BERT模型使用词表大小为30000的WordPiece嵌入 (Wu et al., 2016)。WordPiece的词元化方法是对 14.6.2节中原有的字节对编码算法稍作修改。为简单起见,我们使用d2l.tokenize函数进行词元化。出现次数少于5次的不频繁词元将被过滤掉。

#@save

class _WikiTextDataset(torch.utils.data.Dataset):def __init__(self, paragraphs, max_len):# 输入paragraphs[i]是代表段落的句子字符串列表;# 而输出paragraphs[i]是代表段落的句子列表,其中每个句子都是词元列表paragraphs = [d2l.tokenize(paragraph, token='word') for paragraph in paragraphs]sentences = [sentence for paragraph in paragraphsfor sentence in paragraph]self.vocab = d2l.Vocab(sentences, min_freq=5, reserved_tokens=['<pad>', '<mask>', '<cls>', '<sep>'])# 获取下一句子预测任务的数据examples = []for paragraph in paragraphs:examples.extend(_get_nsp_data_from_paragraph(paragraph, paragraphs, self.vocab, max_len))# 获取遮蔽语言模型任务的数据examples = [(_get_mlm_data_from_tokens(tokens, self.vocab)+ (segments, is_next))for tokens, segments, is_next in examples]# 填充输入(self.all_token_ids, self.all_segments, self.valid_lens,self.all_pred_positions, self.all_mlm_weights,self.all_mlm_labels, self.nsp_labels) = _pad_bert_inputs(examples, max_len, self.vocab)def __getitem__(self, idx):return (self.all_token_ids[idx], self.all_segments[idx],self.valid_lens[idx], self.all_pred_positions[idx],self.all_mlm_weights[idx], self.all_mlm_labels[idx],self.nsp_labels[idx])def __len__(self):return len(self.all_token_ids)

通过使用_read_wiki函数和_WikiTextDataset类,我们定义了下面的load_data_wiki来下载并生成WikiText-2数据集,并从中生成预训练样本。

#@save

def load_data_wiki(batch_size, max_len):"""加载WikiText-2数据集"""num_workers = d2l.get_dataloader_workers()data_dir = d2l.download_extract('wikitext-2', 'wikitext-2')paragraphs = _read_wiki(data_dir)train_set = _WikiTextDataset(paragraphs, max_len)train_iter = torch.utils.data.DataLoader(train_set, batch_size,shuffle=True, num_workers=num_workers)return train_iter, train_set.vocab

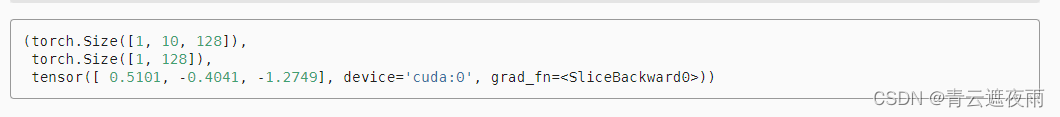

将批量大小设置为512,将BERT输入序列的最大长度设置为64,我们打印出小批量的BERT预训练样本的形状。注意,在每个BERT输入序列中,为遮蔽语言模型任务预测 10 10 10( 64 × 0.15 64\times 0.15 64×0.15)个位置。

batch_size, max_len = 512, 64

train_iter, vocab = load_data_wiki(batch_size, max_len)for (tokens_X, segments_X, valid_lens_x, pred_positions_X, mlm_weights_X,mlm_Y, nsp_y) in train_iter:print(tokens_X.shape, segments_X.shape, valid_lens_x.shape,pred_positions_X.shape, mlm_weights_X.shape, mlm_Y.shape,nsp_y.shape)break

最后,我们来看一下词量。即使在过滤掉不频繁的词元之后,它仍然比PTB数据集的大两倍以上。

len(vocab)

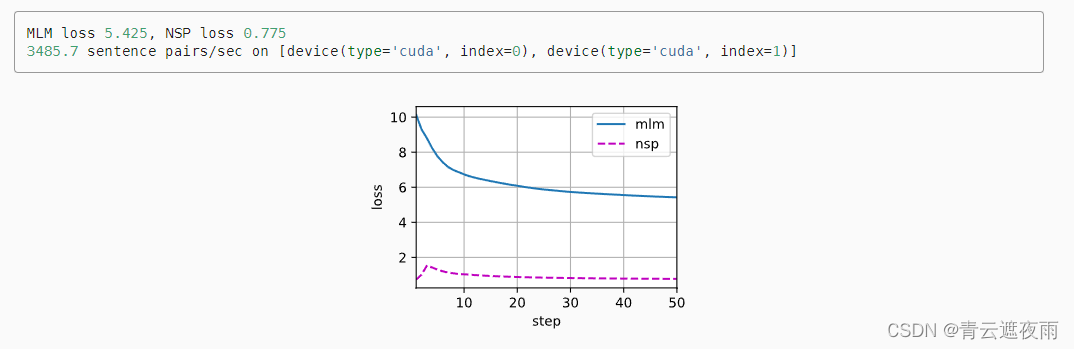

预训练BERT

首先,我们加载WikiText-2数据集作为小批量的预训练样本,用于遮蔽语言模型和下一句预测。批量大小是512,BERT输入序列的最大长度是64。注意,在原始BERT模型中,最大长度是512。

batch_size, max_len = 512, 64

train_iter, vocab = d2l.load_data_wiki(batch_size, max_len)

预训练BERT

原始BERT (Devlin et al., 2018)有两个不同模型尺寸的版本。基本模型( B A S E B A S E BASE_{BASE} BASEBASE)使用12层(Transformer编码器块),768个隐藏单元(隐藏大小)和12个自注意头。大模型( B A S E L A R G E BASE_{LARGE} BASELARGE)使用24层,1024个隐藏单元和16个自注意头。值得注意的是,前者有1.1亿个参数,后者有3.4亿个参数。为了便于演示,我们定义了一个小的BERT,使用了2层、128个隐藏单元和2个自注意头。

net = d2l.BERTModel(len(vocab), num_hiddens=128, norm_shape=[128],ffn_num_input=128, ffn_num_hiddens=256, num_heads=2,num_layers=2, dropout=0.2, key_size=128, query_size=128,value_size=128, hid_in_features=128, mlm_in_features=128,nsp_in_features=128)

devices = d2l.try_all_gpus()

loss = nn.CrossEntropyLoss()

在定义训练代码实现之前,我们定义了一个辅助函数_get_batch_loss_bert。给定训练样本,该函数计算遮蔽语言模型和下一句子预测任务的损失。请注意,BERT预训练的最终损失是遮蔽语言模型损失和下一句预测损失的和。

#@save

def _get_batch_loss_bert(net, loss, vocab_size, tokens_X,segments_X, valid_lens_x,pred_positions_X, mlm_weights_X,mlm_Y, nsp_y):# 前向传播_, mlm_Y_hat, nsp_Y_hat = net(tokens_X, segments_X,valid_lens_x.reshape(-1),pred_positions_X)# 计算遮蔽语言模型损失mlm_l = loss(mlm_Y_hat.reshape(-1, vocab_size), mlm_Y.reshape(-1)) *\mlm_weights_X.reshape(-1, 1)mlm_l = mlm_l.sum() / (mlm_weights_X.sum() + 1e-8)# 计算下一句子预测任务的损失nsp_l = loss(nsp_Y_hat, nsp_y)l = mlm_l + nsp_lreturn mlm_l, nsp_l, l

通过调用上述两个辅助函数,下面的train_bert函数定义了在WikiText-2(train_iter)数据集上预训练BERT(net)的过程。训练BERT可能需要很长时间。以下函数的输入num_steps指定了训练的迭代步数,而不是像train_ch13函数那样指定训练的轮数。

def train_bert(train_iter, net, loss, vocab_size, devices, num_steps):net = nn.DataParallel(net, device_ids=devices).to(devices[0])trainer = torch.optim.Adam(net.parameters(), lr=0.01)step, timer = 0, d2l.Timer()animator = d2l.Animator(xlabel='step', ylabel='loss',xlim=[1, num_steps], legend=['mlm', 'nsp'])# 遮蔽语言模型损失的和,下一句预测任务损失的和,句子对的数量,计数metric = d2l.Accumulator(4)num_steps_reached = Falsewhile step < num_steps and not num_steps_reached:for tokens_X, segments_X, valid_lens_x, pred_positions_X,\mlm_weights_X, mlm_Y, nsp_y in train_iter:tokens_X = tokens_X.to(devices[0])segments_X = segments_X.to(devices[0])valid_lens_x = valid_lens_x.to(devices[0])pred_positions_X = pred_positions_X.to(devices[0])mlm_weights_X = mlm_weights_X.to(devices[0])mlm_Y, nsp_y = mlm_Y.to(devices[0]), nsp_y.to(devices[0])trainer.zero_grad()timer.start()mlm_l, nsp_l, l = _get_batch_loss_bert(net, loss, vocab_size, tokens_X, segments_X, valid_lens_x,pred_positions_X, mlm_weights_X, mlm_Y, nsp_y)l.backward()trainer.step()metric.add(mlm_l, nsp_l, tokens_X.shape[0], 1)timer.stop()animator.add(step + 1,(metric[0] / metric[3], metric[1] / metric[3]))step += 1if step == num_steps:num_steps_reached = Truebreakprint(f'MLM loss {metric[0] / metric[3]:.3f}, 'f'NSP loss {metric[1] / metric[3]:.3f}')print(f'{metric[2] / timer.sum():.1f} sentence pairs/sec on 'f'{str(devices)}')

用BERT表示文本

在预训练BERT之后,我们可以用它来表示单个文本、文本对或其中的任何词元。下面的函数返回tokens_a和tokens_b中所有词元的BERT(net)表示。

def get_bert_encoding(net, tokens_a, tokens_b=None):tokens, segments = d2l.get_tokens_and_segments(tokens_a, tokens_b)token_ids = torch.tensor(vocab[tokens], device=devices[0]).unsqueeze(0)segments = torch.tensor(segments, device=devices[0]).unsqueeze(0)valid_len = torch.tensor(len(tokens), device=devices[0]).unsqueeze(0)encoded_X, _, _ = net(token_ids, segments, valid_len)return encoded_X

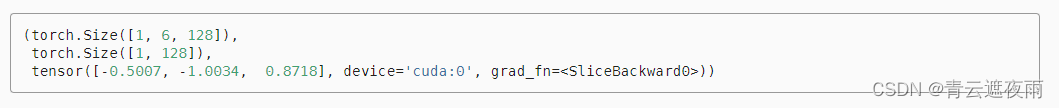

考虑“a crane is flying”这句话。插入特殊标记“”(用于分类)和“”(用于分隔)后,BERT输入序列的长度为6。因为零是“”词元,encoded_text[:, 0, :]是整个输入语句的BERT表示。为了评估一词多义词元“crane”,我们还打印出了该词元的BERT表示的前三个元素。

tokens_a = ['a', 'crane', 'is', 'flying']

encoded_text = get_bert_encoding(net, tokens_a)

# 词元:'<cls>','a','crane','is','flying','<sep>'

encoded_text_cls = encoded_text[:, 0, :]

encoded_text_crane = encoded_text[:, 2, :]

encoded_text.shape, encoded_text_cls.shape, encoded_text_crane[0][:3]

现在考虑一个句子“a crane driver came”和“he just left”。类似地,encoded_pair[:, 0, :]是来自预训练BERT的整个句子对的编码结果。注意,多义词元“crane”的前三个元素与上下文不同时的元素不同。这支持了BERT表示是上下文敏感的。

tokens_a, tokens_b = ['a', 'crane', 'driver', 'came'], ['he', 'just', 'left']

encoded_pair = get_bert_encoding(net, tokens_a, tokens_b)

# 词元:'<cls>','a','crane','driver','came','<sep>','he','just',

# 'left','<sep>'

encoded_pair_cls = encoded_pair[:, 0, :]

encoded_pair_crane = encoded_pair[:, 2, :]

encoded_pair.shape, encoded_pair_cls.shape, encoded_pair_crane[0][:3]