多元线性回归分析

回归分析就是,通过研究自变量X和因变量Y的相关关系,来解释Y的形成机制,从而达到通过X去预测Y的目的。

所以回归分析需要完成三个使命,首先是识别重要变量,其次是判断正负相关,最后是估计权重,也就是计算回归系数。

常见的回归分析有五类,本篇文章主要学习线性回归。

数据的分类

1. 横截面数据

在某一时点手机的不同对象的数据。

例如:全国各省份2023年GDP的数据,大二学生今年体测得到的数据。

2. 时间序列数据

对同一对象在不同时间连续观察所取得的数据。

例如:广东省2023年从1月到12月的GDP数据,在某地方每隔一小时测得的温度数据。

3. 面板数据

横截面数据与时间序列数据综合起来的一种数据资源。

例如:2013 - 2023年,我国各省份GDP数据。

不同数据类型的处理方法

一元线性回归

由上可知,回归和拟合的原理其实一样。

但是线性回归,并不代表模型中的变量都严格满足线性关系,自变量与因变量都可以通过变量替换而转化为线性模型,下面的式子都是如此:

回归系数的解释

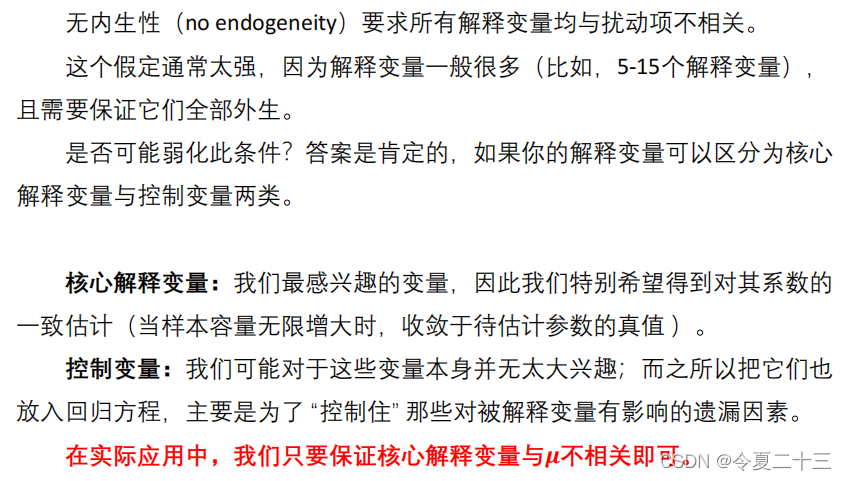

由上面的例子可以看到,引入新变量对回归系数的影响非常大,这是因为遗漏变量导致的内生性。

内生性和外生性

四类模型的回归系数

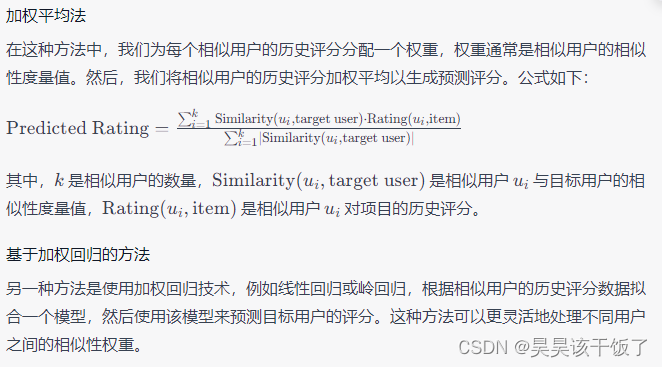

下面的笔记参考多元线性回归模型

lasso回归可以用于筛选变量,防止变量多重共线性。