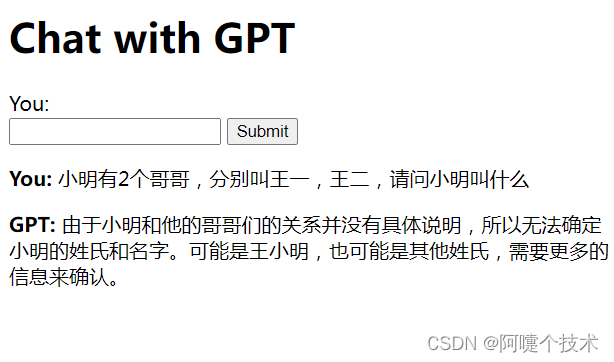

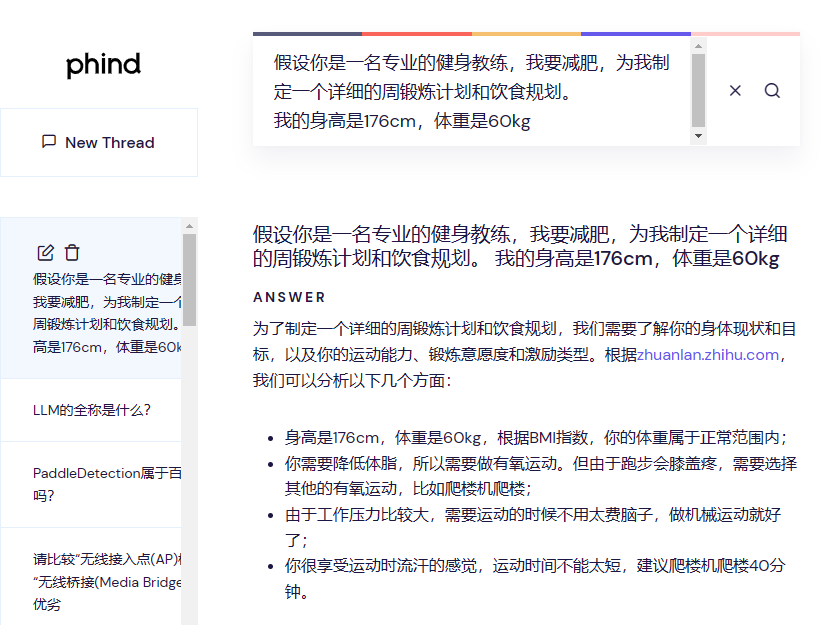

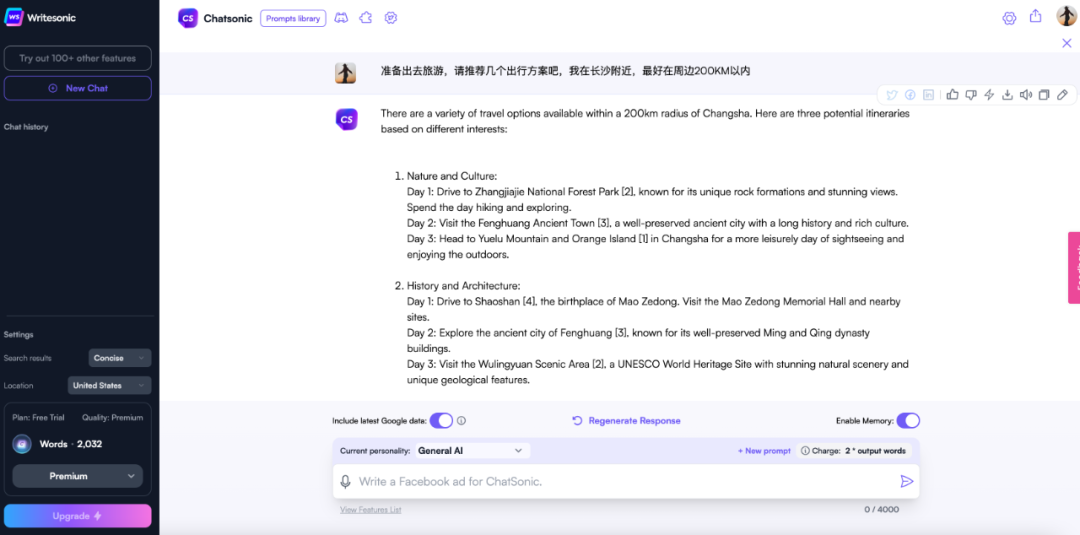

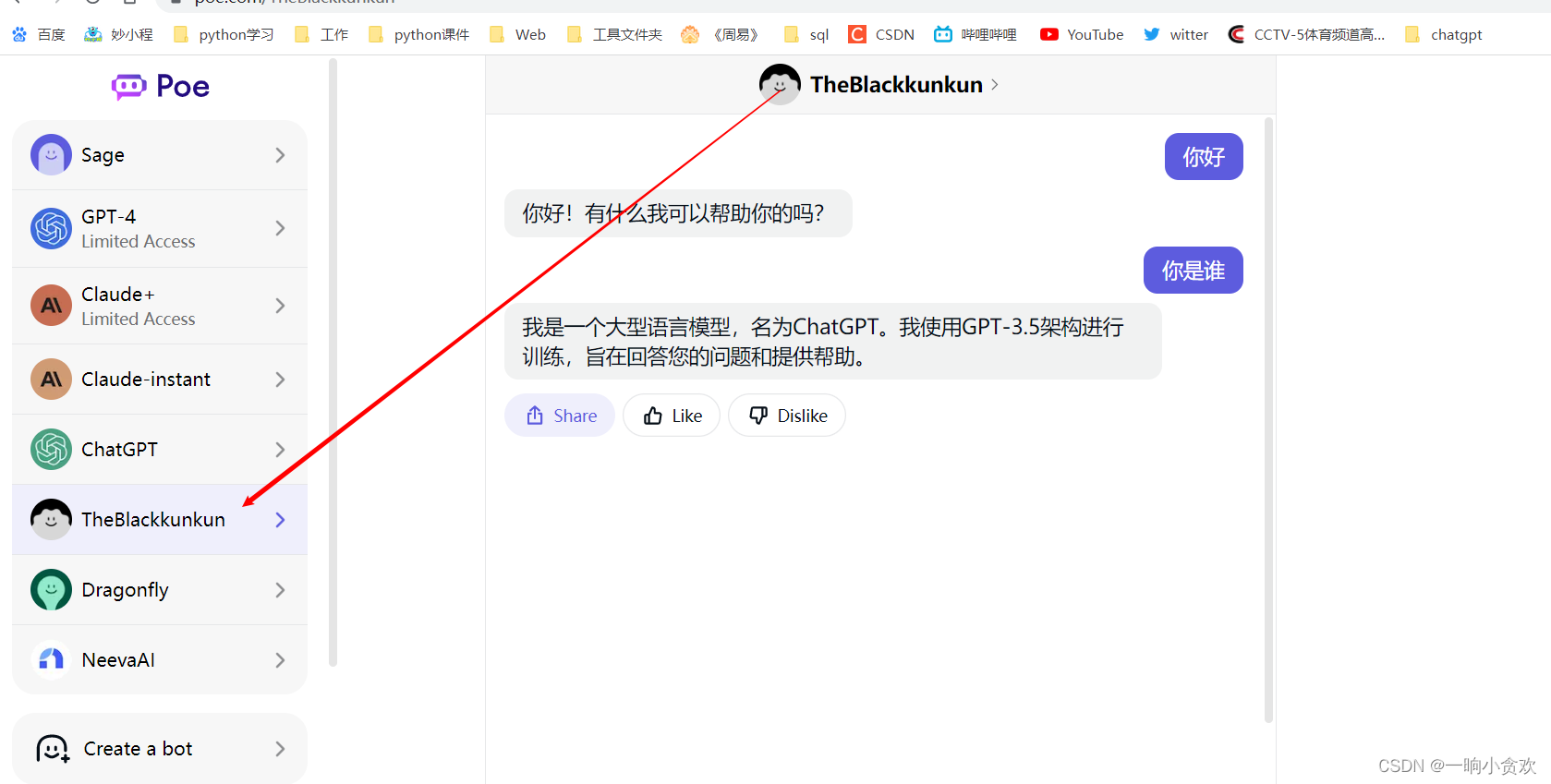

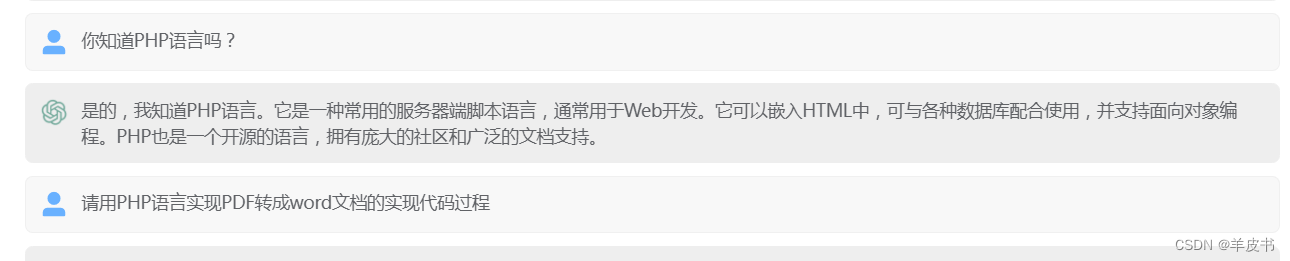

最近ChatGPT(https://chat.openai.com)特别火,笔者也借此机会尝鲜了一波。ChatGPT是一个一个大型语言模型,它的功能是回答用户提出的问题。它可以回答很多种类的问题,包括历史、科学、技术、文化和其他话题的问题。它还可以帮助我们进行语言学习,例如提供单词和短语的释义,或者给出有关语法和语言用法的建议(包括代码)。ChatGPT根据用户输入的内容,去搜索相关的内容,然后再进行回复。笔者试了一下,在网络不出现问题的情况下,ChatGPT给出的建议具有很高的可靠性。(更多内容欢迎关注微信公众号:顾拉得皮蛋)

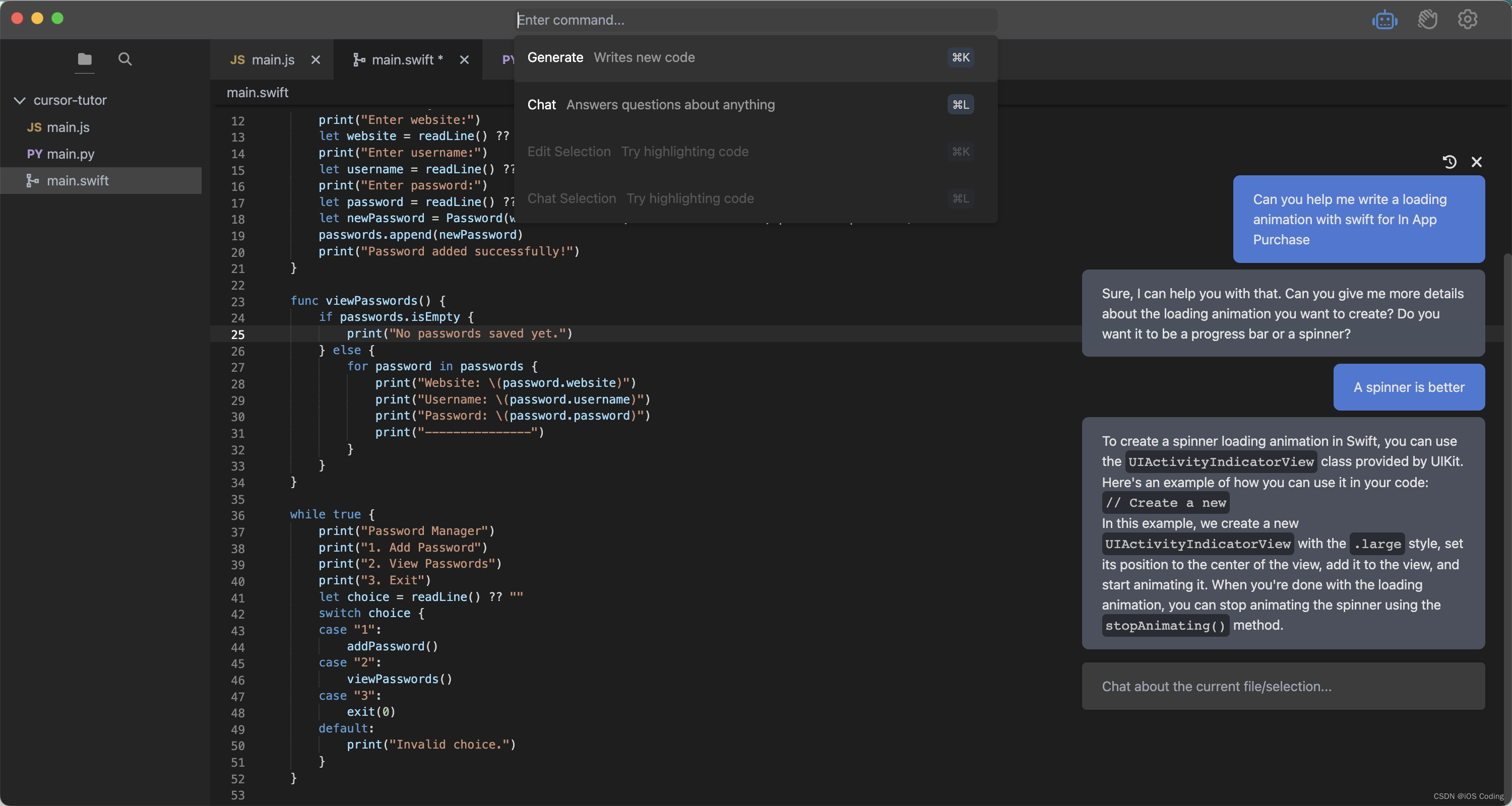

下面的这篇文章,笔者相当于做了一个提纲,针对每一个点在ChatGPT中输入问题,ChatGPT会自动回复。ChatGPT回复内容来基本都非常有条理和逻辑。个人觉得,无论是ChatGPT还是6月份上线的Copilot,它们都很大的程度上加快了我们学习和工作的效率。目前,ChatGPT还处在内测阶段,还没有对我们国家开放,我们可能还要再等等,估计正式开放的时候,我们也许会有更多的惊喜。下面是面向ChatGPT写作的文章,让我们来看看它的表现,希望对大家有所帮助。

机器学习和人工智能,深度学习的关系

机器学习和人工智能是广义的概念,而深度学习是一种机器学习的方法。可以这样来理解:机器学习是指让计算机通过经验学习来提高它的能力,不断地通过训练和学习来改善自己的表现。

人工智能是指利用计算机模拟人类的智能行为,让计算机具备人类智能的能力,如语言处理、规划、推理等。

深度学习是一种机器学习的方法,它通过构建多层非线性模型来学习数据的特征表示。深度学习可以用来处理非常复杂的数据,如图像、语音和文本,在这些领域中取得了很多成功。

不难看出,机器学习和人工智能是相互关联的领域,它们都研究如何让计算机具有智能行为的方法。机器学习是人工智能的一个子领域,专注于通过给计算机提供大量数据,让其通过学习来改善其自身的表现。深度学习是一种机器学习方法,它通过使用神经网络来处理数据,并逐层地学习处理数据的细节,从而实现更深层次的学习。因此,深度学习是机器学习的一个子领域,也是人工智能的一个子领域。

机器学习的分类

按学习方法:监督学习模型,非监督学习模型,半监督学习模型等

1. 监督学习

- 监督学习是指在训练数据中,给定输入和对应的正确输出,然后让模型学习这种输入输出对应关系,以预测新数据的输出。例如,我们可以使用监督学习来预测图像中的物体类别。

2. 非监督学习

- 无监督学习是指在训练数据中,只给定输入,而没有正确的输出,让模型自己学习数据之间的关系。例如,我们可以使用无监督学习来发现数据中的聚类。

3. 半监督学习

- 半监督学习是指在训练数据集中包含有标签的数据和未标记的数据的情况下进行学习。在半监督学习中,模型会尝试从未标记的数据中提取信息来改进它的预测能力,同时也会使用已标记的数据来验证它的预测结果。这种方法对于那些标签数据不足的问题特别有用,因为它可以充分利用可用的数据,提高模型的性能

按应用方向:分类,聚类,回归,排序,序列标注

1. 分类算法

- 分类算法用于对数据进行分类。分类算法的输入是一些已经被标记过的数据,输出是对新数据的分类。分类算法的常用方法有:朴素贝叶斯分类、决策树分类、K近邻分类、支持向量机分类、神经网络分类等。

2. 聚类算法

- 聚类算法用于将数据分成若干组,每组数据都具有相似的特征。聚类算法的输入是一组无标记数据,输出是对数据的分组结果。聚类算法通常用于对数据进行探索性分析,例如找出一组数据中的相似点。常用的聚类算法有:K-means聚类、层次聚类、DBSCAN聚类、EM算法、孪生神经网络聚类等。

3. 回归算法

- 回归算法用于预测连续值的输出,例如预测物价的价格、预测股票的价格波动或预测汇率的变化。常见的回归算法包括线性回归、逻辑回归、多项式回归和岭回归等。这些算法都有一些共同的特点,例如都需要训练数据来建立模型,并且都需要一定的方法来评估模型的性能

4. 排序算法

- 排序算法用于将一个数据集中的元素按照指定的顺序进行排列。常见的排序算法包括快速排序、冒泡排序、插入排序、选择排序和归并排序等。排序算法的时间复杂度不同,因此在不同的情况下,选择哪种排序算法可能会有所不同。

5. 序列标注算法

- 序列标注算法用于给序列中的每个元素打上标签。序列标注通常用于自然语言处理,例如将句子中的每个单词打上词性标签或将文本中的每个字打上实体标签。常用的序列标注算法包括频率基础的方法、条件随机场(CRF)、结构感知机(SSM)和循环神经网络(RNN)等。不同的算法在处理序列标注任务时各有优劣,通常需要根据实际情况选择合适的算法来实现序列标注。。这些算法都具有一定的共同特点,例如都需要大量的标注数据来训练模型,并且都需要一定的方法来评估模型的性能。

常用的机器学习算法简介

目前,最常用的机器学习算法众多,本文仅介绍常见的部分算法。

1. 线性回归

-

线性回归是一种经典的回归分析方法,它可以用来预测一个连续型变量与一个或多个自变量之间的关系。线性回归可以用来预测房价、股票价格、销售额等,也可以用来评估医疗治疗的效果。它是一种广泛应用的工具,能够帮助我们更好地理解和分析数据。以预测股票价格为例,它可以据股票的历史价格、交易量、行业发展趋势等特征来预测股票的未来价格波动。

-

线性回归的优点:

- 简单易懂:线性回归的原理很容易理解,并且它的计算也很容易。

- 易于解释:线性回归模型提供了一个简单的方法来理解变量间的关系,并且可以通过回归系数来量化这种关系。

- 计算时间短:由于线性回归模型的简单性,计算时间通常很短。

-

线性回归的缺点:

- 假设变量之间存在线性关系,但实际情况可能并非如此。如果变量之间的关系不是线性的,那么线性回归的预测结果就会不准确。

- 它假设输入特征之间是独立的,但在实际情况中,这种独立性往往不成立。因此,线性回归可能无法准确地捕捉特征之间的相互作用,这可能会导致模型的预测准确度不高。

2. 逻辑回归

-

逻辑回归:用于预测离散型数据的变化趋势。逻辑回归是一种广泛用于二分类问题的机器学习模型,它能够预测一个样本属于某个类别的概率。它的应用场景包括垃圾邮件过滤、医学诊断、金融风险模型等。例如,在垃圾邮件过滤中,逻辑回归模型可以用来预测一封邮件是否是垃圾邮件;在医学诊断中,逻辑回归模型可以用来预测患者是否患有某种疾病;在金融风险模型中,逻辑回归模型可以用来预测一个客户是否会违约。

-

逻辑回归的优点

- 它是一种简单易用的模型,它不需要太多的调参就可以得到良好的结果。

- 以输出类别预测的概率值,这有助于我们更好地理解模型的预测结果。

- 逻辑回归可以轻松地处理多分类问题,并且在处理非线性特征时表现良好。

-

逻辑回归的缺点:

- 它假设输入特征之间是独立的,但这种假设在实际情况中往往是不成立的。

- 逻辑回归模型对于极端值非常敏感,因此在处理数据时需要进行规范化处理。

- 逻辑回归模型的计算复杂度比较高,因此在处理大型数据集时可能不太适用。

3. 决策树

-

决策树:用来解决分类和回归问题。决策树通过构建一棵树来表示决策过程,其中每个内部节点代表一个属性,每个叶子节点代表一个决策结果。决策树可以用来预测客户是否会逾期还贷款,预测患者是否患有某种疾病,以及预测某种事物是否属于某一个类别等。它具有良好的可解释性,广泛应用于数据挖掘和机器学习领域

-

决策树的优点:

- 决策树具有很好的可解释性,能够清晰地表示决策过程,便于人们理解和解释。

- 决策树能够处理包含离散和连续属性的数据,并能够处理缺失数据。

- 决策树算法的计算复杂度较低,能够快速地对数据进行建模和预测。

- 决策树算法可以通过剪枝来提高模型的泛化能力,降低过拟合的风险。

-

决策树的缺点:

- 决策树容易过拟合,也就是在训练数据集上表现良好,但在测试数据集上表现不佳。这是因为决策树很容易捕捉到训练数据集中的噪声,从而导致决策树拟合的模型不够稳定。可以通过剪枝、设置每一个叶节点的最小样本数、设置树的最大深度来减小模型的复杂度,从而避免过拟合现象。

- 决策树很难处理连续性的数据。因为决策树算法是通过基于特征的划分来进行决策的,如果数据是连续的,那么决策树就不太好处理。

- 决策树不能很好地处理非线性关系。如果数据中存在非线性关系,那么决策树就不太好处理。

- 决策树的计算结果为局部最优,而非全局最优。可以通过使用集成算法(随机森林、XGBoost)来解决这个问题。

4. 支持向量机

-

支持向量机:可以用于解决分类和回归问题。SVM通常用于解决二分类问题,但也可以扩展到多分类问题。SVM常见的应用场景包括:文本和自然语言处理中的文本分类、图像处理中的手写数字识别、生物信息学中的分类和预测、金融数据分析中的风险模型构建等。总的来说,SVM通常用于高维数据集,特别是数据点数目远大于维度的情况。

-

支持向量机的优点:

- 支持向量机可以解决非线性问题,通过使用核技巧可以将数据映射到高维空间,从而使得线性不可分的数据点变得线性可分。

- 支持向量机能够有效地处理高维数据,并且不用像神经网络那样需要大量的训练数据。

- 支持向量机具有较强的泛化能力,即它在训练数据集上表现良好的同时,在新数据上的表现也很好。

- 支持向量机具有稳定性较高,即在数据噪声较大的情况下仍然能够较好地工作。

- 支持向量机具有可解释性较好,用户可以很容易理解模型的内部工作原理。

-

支持向量机的缺点:

- 支持向量机对于大型数据集来说可能不太适用,它的训练时间可能会很长。

- 它也有一定的难度,需要调整多个超参数来获得最佳性能。

- 支持向量机对数据的线性可分性要求较高,因此在处理非线性数据时效果不佳。

5. 神经网络算法

-

神经网络算法:常见的神经网络算法包括多层感知机(MLP)、卷积神经网络(CNN)、循环神经网络(RNN)、递归神经网络(RecNN)和自编码器等。不同的神经网络算法在实现原理、架构和应用领域上有所差异,通常需要根据实际情况选择合适的算法来实现神经网络模型。在神经网络分类中,输入数据通过一系列的计算步骤(称为神经元或节点)来进行分类。神经网络分类可以用于解决各种分类问题,包括语音识别、图像识别、文本分类等。

-

神经网络的优点:

- 神经网络算法有许多优点。其中一个优点是它们可以处理大量的数据,并且可以在大型数据集上快速运行。这使得它们特别适用于处理大规模的实时数据。

- 神经网络算法还具有良好的非线性能力,可以处理非线性关系。这使得它们可以捕捉数据中的复杂模式和规律,并且可以对未知数据进行准确预测。

- 神经网络具有很强的泛化能力,能够对未见过的数据进行准确预测。

-

神经网络的缺点:

- 神经网络的模型参数非常多,需要大量的数据进行训练,这意味着对于规模较小的数据集,神经网络可能表现不佳。

- 神经网络的决策较为黑箱,很难理解它是如何做出决策的。

- 神经网络的性能往往是数据相关的,如果数据发生变化,模型的性能也会相应变化。

- 神经网络容易出现过拟合问题,即在训练数据上表现良好,但在测试数据上表现不佳。

- 神经网络往往需要大量的计算资源,这限制了它们的实际应用。

上述内容大多源于ChatGPT自动答复,笔者专业水平有限,可能有表述不准确的地方,还请看官担待,一点微薄的归纳总结工作希望对自己对大家都有所帮助。(更多内容欢迎关注微信公众号:顾拉得皮蛋)

参考材料

ChatGPT-https://chat.openai.com/

知乎博主 Serendipity 部分观点

![[ChatGPT 勘误] 关于 CL_WB_PGEDITOR 的用途](https://img-blog.csdnimg.cn/img_convert/31da257d21af46d22f2d058c9aa3f378.png)