文章目录

- 一、为什么进行性别预测

- 二、特征数据选取

- 三、算法选择

- 四、代码示例

- 1、使用朴素贝叶斯,进行建模

- 2、使用支持向量机

- 3、使用逻辑斯蒂回归

一、为什么进行性别预测

- 用户注册时,所填写的性别,存在大概率的随意性;

- 不能完全作为用户画像的性别参考;

- 因此在无法通过直接手段获得用户真实性别的情况下,需要通过用户的各种行为特征,来对用户的性别进行预测。

二、特征数据选取

(1)比如选取以下的用户特征数据:

category1: 30天内买得最多的品类

category2: 30天内买得第二多的品类

category3: 30天内买得第三多的品类

brand1: 30天内买得最多的品牌

brand2: 30天内买得第二多的品牌

brand3: 30天内买得第三多的品牌

day30_buy_cnts: 30天内的购买单数

day30_buy_amt: 30天内的消费总金额

还可以加: 30天兴趣关键词中的top10个等等…

(2)经验样本数据

import pandas as pd

columns = 'category1,category2,category3,brand1,brand2,brand3,day30_buy_cnts,day30_buy_amt,label'.split(',')

data = [[105.0,106.0,102.0,1101.0,1108.0,1109.0,20.0,100.0,1],

[105,107,102,1101,1108,1105,25,80,1],

[106,104,102,1102,1108,1109,20,100,1],

[106,107,105,1103,1108,1105,30,90,1],

[112,107,105,2103,1108,1105,38,60,1],

[112,116,112,2101,2107,2109,10,3000,0],

[115,117,112,2103,2107,2105,9,1800,0],

[112,118,113,2102,2108,2109,10,1009,0],

[116,113,118,2103,2106,2105,5,2000,0],

[115,117,102,2101,2108,2105,8,800,0]]

data = pd.DataFrame(data,columns = columns)

X_train = data.iloc[:,:-1]

y_train = data.iloc[:,-1]

(3)待测试数据

data = [[105.0,106.0,102.0,1101.0,1108.0,1109.0,5.0,320.0,1],

[105,116,102,102,2107,1105,35,180,1],

[112,116,112,2101,1108,2109,10,3000,0],

[115,117,106,2103,2107,2105,9,1800,0]]

data = pd.DataFrame(data,columns = columns)

X_test = data.iloc[:,:-1]

y_test = data.iloc[:,-1]#测试数据的真实类别

三、算法选择

-

因为我们选择的品牌、品类不是具体的数值,代表的而是分类(是离散的),所以不能用逻辑回归(LR的数据都是连续的特征),而选择用朴素贝叶斯算法。

-

其他算法也是可以的。如果我们对于算法,区别,不是特别清楚,可以多试几个算法,寻找最优算法。

-

问题是,使用朴素贝叶斯算法,特征值要都是很明确的,不是随机变化性的。但是我们选取的最后两个特征:单数和总金额,是会产生很多很多可能性的值,在同类中是变化不明确的,特征值是很多的。那该怎么办呢?

-

将最后面的两个特征值的区间化(离散化),把连续变化的特征值, 转成只有有限的若干几种取值。

四、代码示例

1、使用朴素贝叶斯,进行建模

from sklearn.naive_bayes import MultinomialNB,BernoulliNB,GaussianNB

# 离散化区间化

# 训练数据离散化

X_train['day30_buy_cnts'] = pd.cut(X_train['day30_buy_cnts'],bins = [0,10,20,30,40,50],labels=[1,2,3,4,5])

X_train['day30_buy_amt'] = pd.cut(X_train['day30_buy_amt'],bins = [0,100,200,500,1000,2000,5000,100000],labels=[1,2,3,4,5,6,7])# 测试数据离散化

X_test['day30_buy_cnts'] = pd.cut(X_test['day30_buy_cnts'],bins = [0,10,20,30,40,50],labels=[1,2,3,4,5])

X_test['day30_buy_amt'] = pd.cut(X_test['day30_buy_amt'],bins = [0,100,200,500,1000,2000,5000,100000],labels=[1,2,3,4,5,6,7])# 声明模型进行训练和预测

mNB = MultinomialNB()

mNB.fit(X_train,y_train)

y_pred = mNB.predict(X_test)

display(y_pred)

bNB = BernoulliNB()

bNB.fit(X_train,y_train)

y_pred = bNB.predict(X_test)

display(y_pred)

gNB = GaussianNB()

gNB.fit(X_train,y_train)

y_pred = gNB.predict(X_test)

display(y_pred)

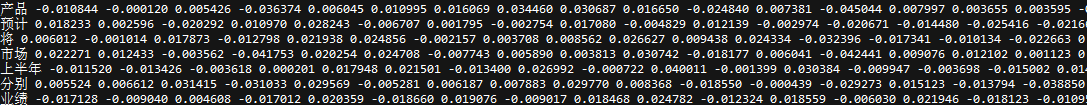

结果如下:

真实结果是:1,1,0,0

array([1, 0, 1, 0], dtype=int64)

array([0, 0, 0, 0], dtype=int64)

array([1, 0, 1, 0], dtype=int64)

2、使用支持向量机

from sklearn.svm import SVC

svc = SVC()

svc.fit(X_train,y_train)

svc.predict(X_test)

结果如下:

array([1, 1, 0, 0], dtype=int64)

虽然这四个数据,支持向量机,全部预测准确了,但是现在还不能说,SVM就比朴素贝叶斯好。因为这个数据太少了,只是小案例。如果要比较,唯一标准,就是市场检验!将算法,上线,经过大量数据,验证,看最终效果。

3、使用逻辑斯蒂回归

from sklearn.linear_model import LogisticRegression

lr = LogisticRegression()

lr.fit(X_train,y_train)

lr.predict(X_test)

预测结果如下:

array([1, 0, 1, 0], dtype=int64)

欢迎大家一起学习,进步!

参考